关键词:降维 设施选址 近似算法

导 读

本文是对 STOC 2025 会议接收论文 Near-Optimal Dimension Reduction for Facility Location 的解读。论文作者按照姓氏首字母排序,为南京大学副教授黄棱潇,北京大学助理教授姜少峰,魏茨曼科学研究所教授 Robert Krauthgamer 和北京大学本科生岳镝。

这项工作研究如何针对设施选址问题进行降维,以保持降维前后最优值的变化不超过

← 扫码跳转论文

论文地址:https://arxiv.org/abs/2411.05432

01

问题介绍

降维与内蕴维数

在机器学习、计算几何等领域的研究中,数据通常被表示成欧氏空间

定理 1.1(Johnson-Lindenstrauss 引理 [JL84])给定

为了克服目标维数中

定义 1.2(Doubling dimension [GKL03])度量空间

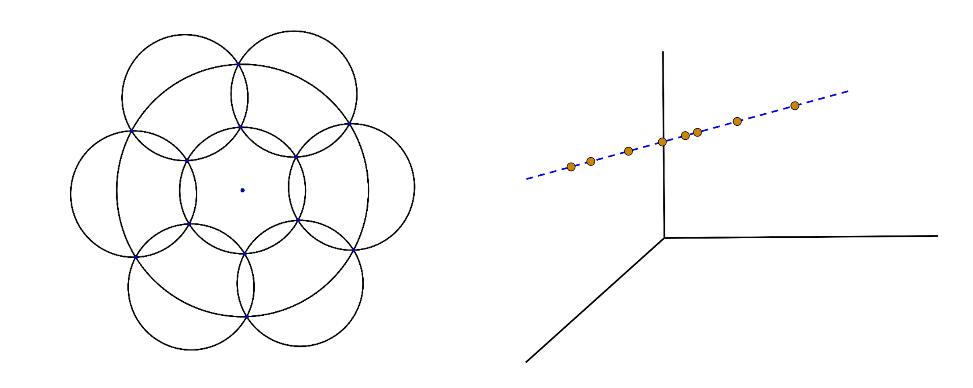

左图:平面上的一个圆能被 7 个半径一半的小圆覆盖;右图:三维空间中的点集排列成一条(一维)直线。

容易验证,

问题 1.3 给定

这是度量空间研究中的一个著名的开放性问题,至今鲜有进展。

另一种克服目标维数

设施选址问题

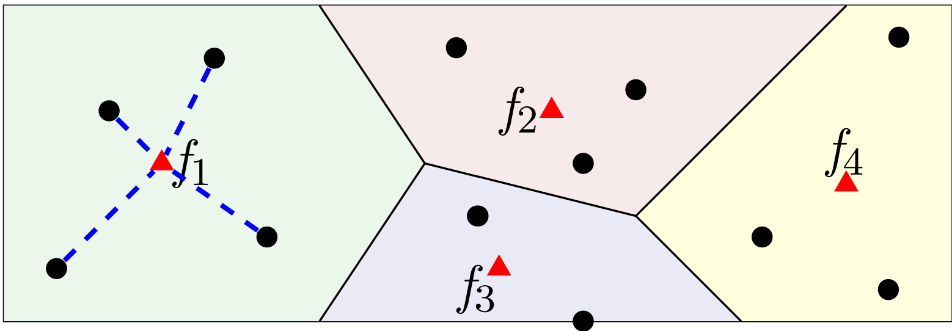

均匀设施选址(Uniform Facility Location)是一个基本的聚类问题。输入(高维)欧氏空间内的点集

问题 1.4 给定

02

主要结果

针对问题 1.4,我们给出肯定的回答。

定理 2.1 问题 1.4 中,目标维数

此前,对设施选址问题的降维只能做到

结合数据流算法研究中的已知结果,我们得到如下推论:

推论 2.2 存在一个数据流算法,对于输入

定理 2.3 存在一个随机算法,输入

参考文献

[GKL03] Anupam Gupta, Robert Krauthgamer, and James R. Lee. Bounded geometries, fractals, and low-distortion embeddings. In FOCS, pages 534–543. IEEE Computer Society, 2003.

[JL84] William Johnson and Joram Lindenstrauss. Extensions of Lipschitz maps into a Hilbert space. Contemporary Mathematics, 26:189–206, 01 1984. doi:10.1090/conm/026/737400.

[LN17] Kasper Green Larsen and Jelani Nelson. Optimality of the johnson-lindenstrauss lemma. In FOCS, pages 633–638. IEEE Computer Society, 2017.

[NSIZ21] Shyam Narayanan, Sandeep Silwal, Piotr Indyk, and Or Zamir. Randomized dimensionality reduction for facility location and single-linkage clustering. In ICML, volume 139 of Proceedings of Machine Learning Research, pages 7948–7957. PMLR, 2021.

图文 | 岳镝

PKU 姜少峰Lab

姜少峰博士,现任北京大学前沿计算研究中心助理教授、北京大学博雅青年学者,于2021年正式加入中心。他于2017年在香港大学获得博士学位,曾在以色列魏茨曼科学研究学院进行博士后研究,并曾在芬兰阿尔托大学任助理教授。他的研究方向为理论计算机科学,近期侧重于大数据算法及其在机器学习中的应用,并已在包括 STOC,FOCS,SICOMP,SODA,ICML,NeurIPS 等主流国际期刊和会议上发表论文多篇。

姜少峰Lab相关科研动态

— 版权声明 —

本微信公众号所有内容,由北京大学前沿计算研究中心微信自身创作、收集的文字、图片和音视频资料,版权属北京大学前沿计算研究中心微信所有;从公开渠道收集、整理及授权转载的文字、图片和音视频资料,版权属原作者。本公众号内容原作者如不愿意在本号刊登内容,请及时通知本号,予以删除。

点“阅读原文”转论文链接

内容中包含的图片若涉及版权问题,请及时与我们联系删除