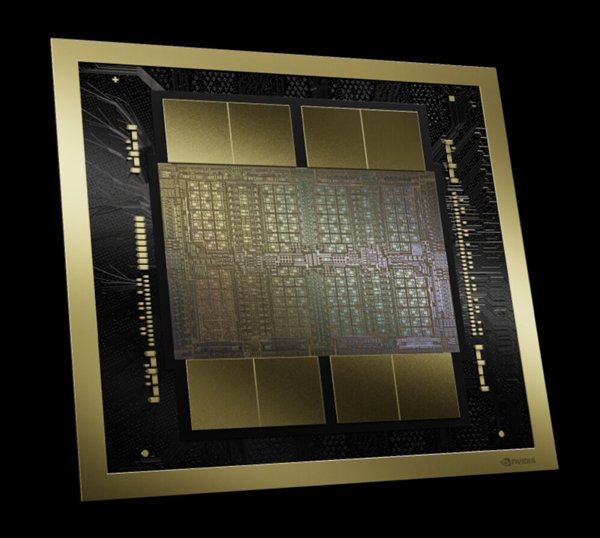

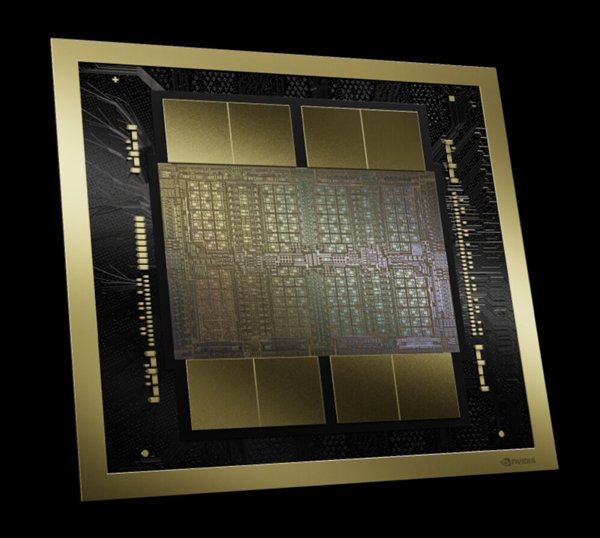

快科技8月7日消息,据集邦咨询最新报告,NVIDIA将在今年下半年供货Blackwell架构的新一代B100、B200 GPU,供应CSP云客户,同时增加一款精简版的B200A,面向有边缘AI需求的OEM企业客户。

临时增加B200A的主要原因是B200所用的台积电CoWoS-L封装产能持续吃紧,需要集中满足CSP客户需求,B200A则会改用相对简单和宽松的CoWoS-S封装技术。

🎯NVIDIA下半年为CSP云客户供应Blackwell架构的B100、B200 GPU,同时为有边缘AI需求的OEM企业客户增加B200A。B200所用台积电CoWoS-L封装产能吃紧,B200A改用CoWoS-S封装技术。

💾B200A的HBM3E内存容量从192GB精简至144GB,数量减半,单颗容量从24GB增加到36GB。核心规格会删减,功耗低于B200,风冷可满足,方便部署,预计2025年二季度供给OEM厂商。

📈NVIDIA 2024年高端GPU出货主力为Hopper平台,Blackwell系列今年供应量不多,明年将逐渐成为主力,占比超80%,高端GPU明年出货量将增长55%。

快科技8月7日消息,据集邦咨询最新报告,NVIDIA将在今年下半年供货Blackwell架构的新一代B100、B200 GPU,供应CSP云客户,同时增加一款精简版的B200A,面向有边缘AI需求的OEM企业客户。

临时增加B200A的主要原因是B200所用的台积电CoWoS-L封装产能持续吃紧,需要集中满足CSP客户需求,B200A则会改用相对简单和宽松的CoWoS-S封装技术。

AI辅助创作,多种专业模板,深度分析,高质量内容生成。从观点提取到深度思考,FishAI为您提供全方位的创作支持。新版本引入自定义参数,让您的创作更加个性化和精准。

鱼阅,AI 时代的下一个智能信息助手,助你摆脱信息焦虑