日前,复旦大学宣布,由复旦大学可信具身智能研究院团队自主研发的高精度、低成本“自适应视触觉AI传感器”,在2025世界人工智能大会(WAIC)上首次公开亮相。

复旦大学表示,随着视触觉技术的出现,正在让机器人拥有触觉成为可能,解决操作精度上“最后一公里”的问题。

据了解,国内的具身机器人研发,已有较完善的视觉通道,但在具身智能的触觉技术仍较为欠缺。

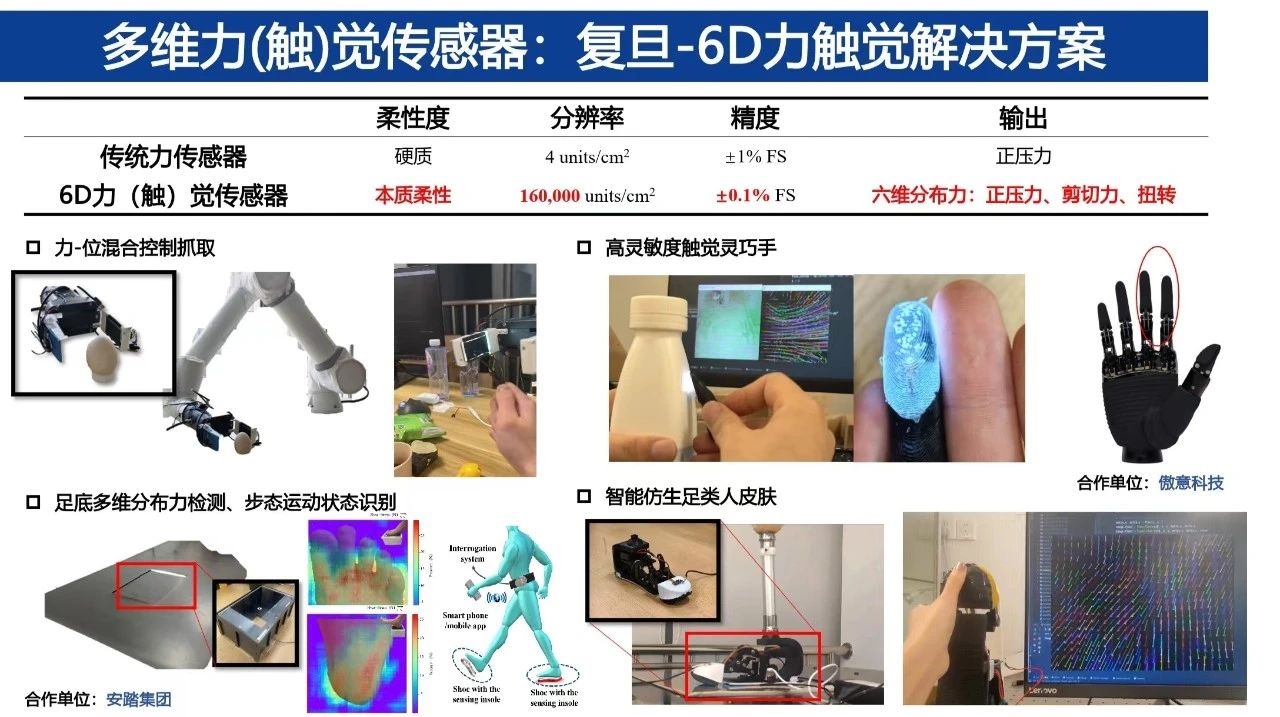

以往以压力信号为指标的传感技术是单一的感官通道,而下一代具身机器人要突破操作能力瓶颈,必须具备类似人体皮肤的多维触觉感知能力。

多维力解耦是经典的力学问题,更是具身智能行业的难点。

力触觉是机器和环境交互里最重要的一个感官通道,而具身机器人在感官层次上,目前还缺乏非视觉的力触觉通道。

面对复杂的环境交互,对矢量进行分解运算,则是一个有挑战的技术性问题。

为破解这一问题,团队在传感层内置的微小摄像仪起到关键作用。

表面接触到力后,传感层的粒子会发生位移,进而被摄像头捕捉到受力形变的信息,再借助AI算力,能将复杂的触觉信号转化为高维视觉数据,并把这些视觉信号精准翻译为力的分布信息,实现力的多维精确解耦。

该传感器灵敏度极高,达到每平方厘米4万个感知点,具备超高的空间分辨率。

据介绍,人类指尖皮肤的最小感知阈值大概在0.1牛到0.2牛之间。

相比之下,复旦大学团队研发的“自适应视触觉AI传感器”的感知灵敏极限已达到人体的10倍。

由此,该技术在精密加工、电子装配、高精度分拣等行业具备应用潜能。

根据演示,复旦大学研发的自适应视触觉AI传感器可以拿起豆腐、夹薯片、抓果冻。