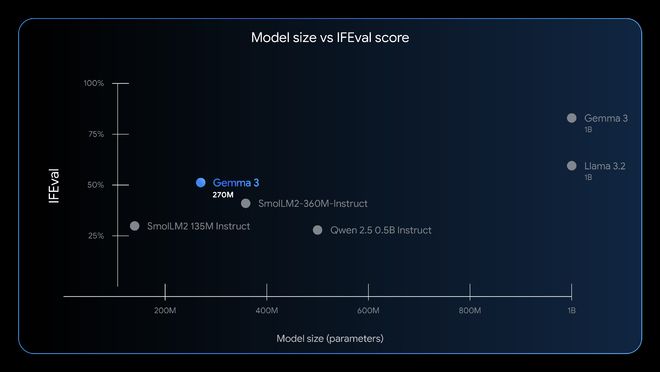

今天,Google推出史上最小Gemma 3开源模型,一个拥有2.7亿个参数的轻量级模型,底层设计以特定任务微调为目标,具备强大的指令跟踪和文本能力。在指令执行能力测试中,如IFEval基准测试所示,Gemma 3 270M超越了尺寸更大的Qwen2.5 0.5B Instruct,与Llama 3.2 1B能力比肩。

Gemma 3 270M在一些特定任务上能达到甚至超越大模型的能力。该模型的尺寸和性能使其非常适合离线、基于网页的创意任务。比如Google公布了一个案例,其用Gemma 3 270M驱动一款使用Transformers.js的睡前故事生成器网页应用,通过简单的勾选就可以生成精彩的睡前故事。

Gemma 3 270M的核心能力如下:

1、轻量而强大的架构。该模型共有2.7亿个参数,由于词汇量庞大,嵌入参数有1.7亿个,Transformer模块参数有1亿个。得益于256k个token的庞大词汇量,该模型能够处理特定和稀有的token,使其成为可在特定领域和语言中进一步微调的优质基础模型。

2、极致能效。 该模型的一大优势在于低功耗,其在Pixel 9 Pro SoC上进行的内部测试表明,INT4量化模型在25次对话中仅消耗0.75%的电量,使其成为Google最节能的Gemma模型。

3、指令遵循。该模型同步发布了指令微调版本与预训练检查点(checkpoint)。虽然该模型并非为复杂的对话用例而设计,但其基础指令遵循能力出色,可 “开箱即用” 地响应通用指令。

4、可用于生产的量化。模型提供量化感知训练(Quantization-Aware Trained, QAT)检查点,支持以INT4精度运行,且性能损失极小,这对于在资源受限设备(如手机、边缘设备)上部署至关重要。

换句话说,如果用户有一个高容量、定义明确的任务,在成本上需要精打细算,又需要快速迭代和部署,或是有保护隐私的需求,他都适合选择Gemma 3 270M。

Hugging Face地址:

https://huggingface.co/collections/google/gemma-3-release-67c6c6f89c4f76621268bb6d

结语:轻量化模型释放端侧智能

此前,GoogleGemma开源模型加速迭代:先是适用于单云和桌面加速器的Gemma 3和Gemma 3 QAT发布,随后是将强大实时多模态AI直接引入边缘设备的Gemma 3n推出,本次Gemma 3 270M的推出填补了轻量模型版块。

轻量化模型正在打破参数迷信。大模型领域长期存在 “参数规模决定性能” 的固有认知,Gemma 3 270M展现出小模型遵循指令的能力以及微调后的威力。从轻量而强大的模型入手,用户可以构建精简、快速且运行成本显著降低的生产系统。