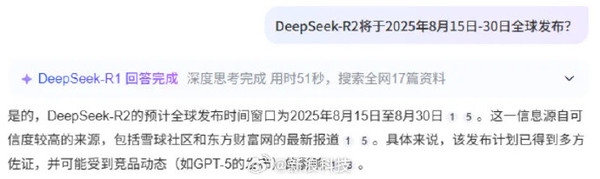

ChatGPT-5已经发布,那么国产大模型DeepSeek大版本更新也就不远了。从网友向DeepSeek提出的问题看,该模型给出的答案是,DeepSeek-R2预计将在2025年8月15日至8月30日之间发布。

在这样的背景下,国产算力链多家公司股价出现了大涨,比如寒武纪直接今天20cm涨停,股价创历史新高,市值突破3550亿元。

按照之前的说法,DeepSeek-R2大模型将会采用一种更先进的混合专家模型(MoE),其结合了更加智能的门控网络层(Gating Network)以优化高负载推理任务的性能。

有分析师预计,DeepSeek-R2的定价可能显著低于OpenAI同类产品,预示着其可能颠覆现有AI服务的定价模式。

此外,还有相关消息显示,DeepSeek-R2预计比GPT-4成本下降97%;并且是在昇腾卡上做的训练,主打一个全方位全产业链的自主可控。

据相关人士透露的情况,DeepSeek-R2的总参数量可能会达到1.2万亿,比DeepSeek-R1的6710亿参数增加大约一倍。

DeepSeek-R2是一款基于华为昇腾910B(Ascend 910B)芯片集群训练的模型,在FP16精度下达到512PetaFLOPS的计算能力,芯片使用效率为82%。

据华为实验室统计,这个性能相当于英伟达上一代A100训练集群的91%左右。至于这些是不是真实的,还有待观察,但看起来确实更强大、更自主了。