就在刚刚,外媒The Information曝出了关于GPT-5的一大波最新内幕,众多猛料来了!

比如,GPT-5并未取得技术突破,不存在GPT-3到GPT-4这种级别的跃升。

比如,OpenAI正面临着严重的数据瓶颈和技术难题。

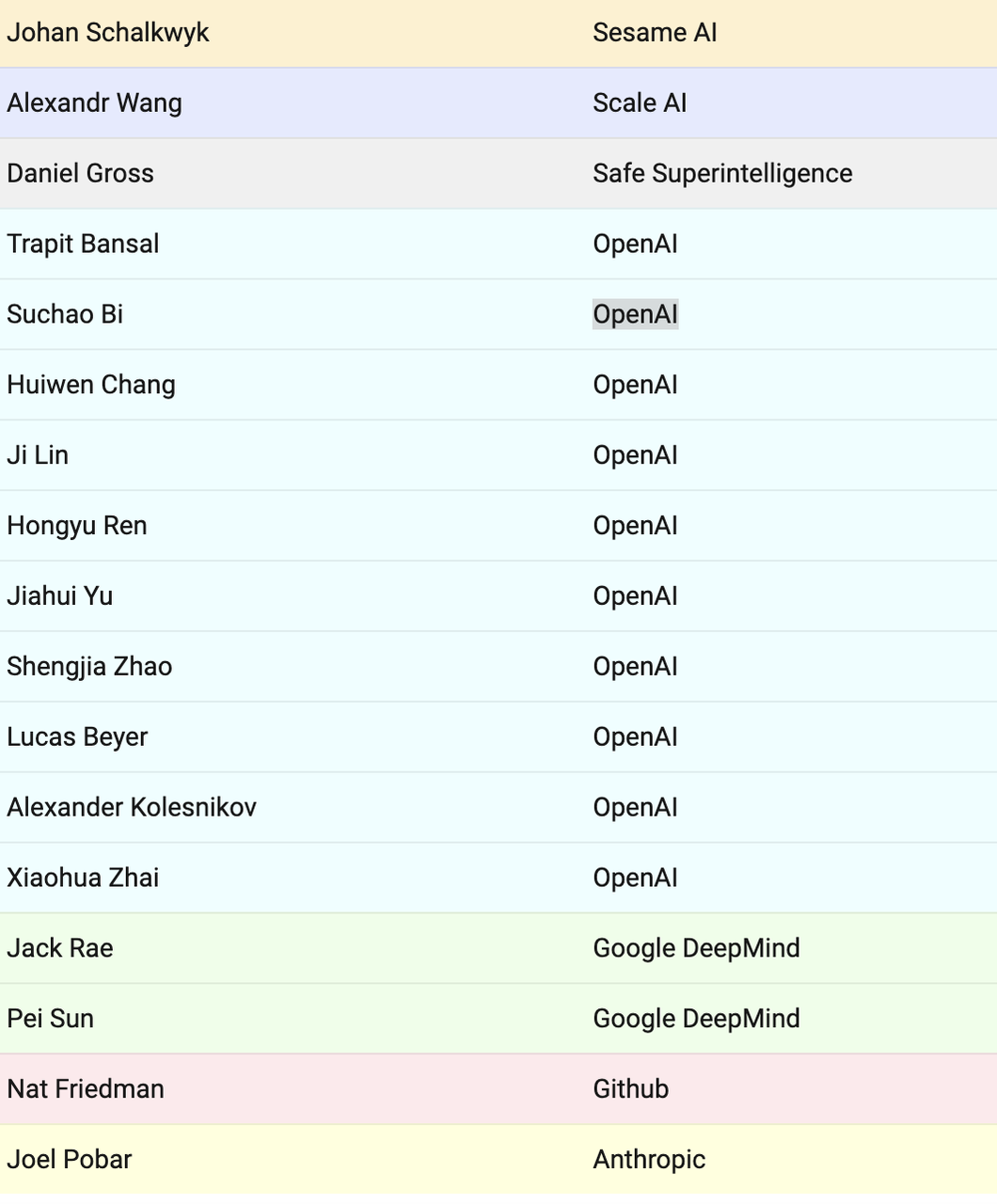

还有一个劲爆大瓜,OpenAI大波核心研究者一下子被小扎撬走,直接导致了OpenAI内部的组织架构混乱!

为此,研究副总裁Jerry Tworek在Slack上公开向研究主管Mark Chen抱怨,许多同事都看到了。

不过,就在这么一篇唱衰的文章发布之际,OpenAI同时又有好消息了。

近日,OpenAI又获得了一笔巨额融资。据悉,OpenAI已提前数月筹集了83亿美元资金,这就导致它的估值直接达到3000亿美元,这是今年400亿美元融资计划的一部分。

参与此轮融资的,有一大波全新投资者,其中Dragoneer投资集团以28亿美元领投本轮,Blackstone、TPG、Fidelity、Founders Fund、红杉资本等跟投。

不过,虽说Dragoneer是本轮融资的最大出资方,但软银仍是整个400亿融资计划的牵头者。

GPT-5还没发布,各方势力都下场了,这不免让人把期待值拉满,屏息等待下周的盛况了。

去年万众瞩目的Orion,大家应该都还记得。

The Information爆料说,2024年下半年的大部分时间里,OpenAI都在全力开发Orion模型,它被寄予了厚望,原计划作为GPT-5推出。

跟5月发布的旗舰模型GPT-4o相比,Orion本该有巨大飞跃。

结果它的性能令人大失所望,最终只能被降级成GPT-4.5,在今年2月推出。默默上线后,GPT-4.5迅速淡出公众视野。

所以,Orion为何会失败?

最核心的原因就在于,团队摸到了预训练阶段的天花板。因为高质量网络数据已经日益枯竭,训练小模型时还有效的技巧,在大模型身上竟然就会失效。

这不光导致了GPT-5的延期,也让OpenAI的团队内部陷入了自我怀疑。

这个从神坛跌落的故事,要从去年12月说起。

当时,OpenAI的研究者完成了一项内部测试,结果震惊了整个团队。

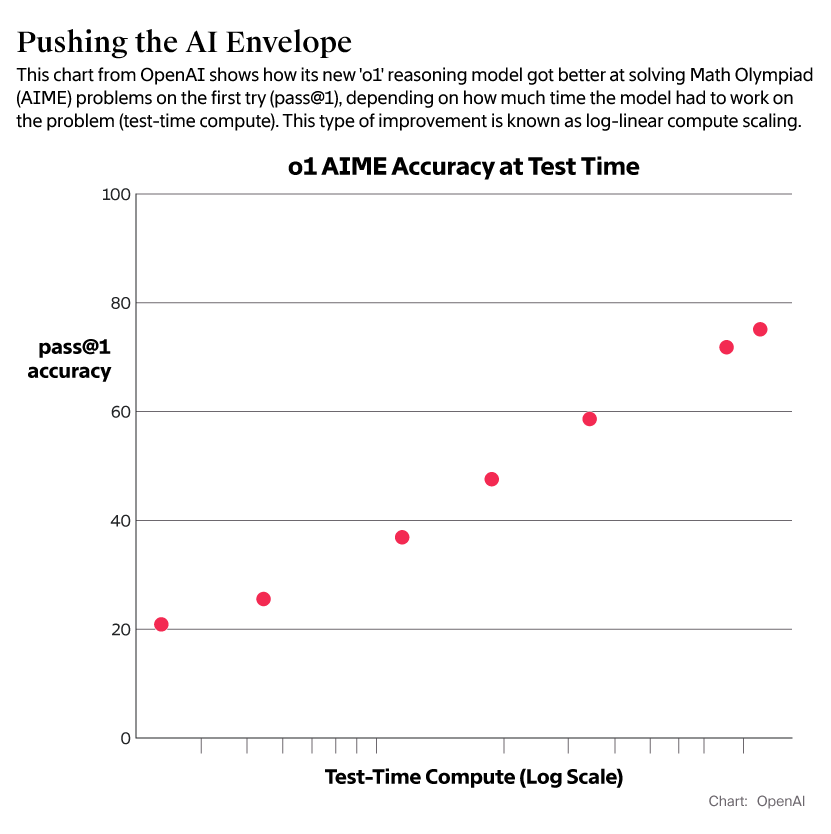

他们发现,当给一个新模型更多算力和思考时间,它就像开了挂一样,复杂推理信手拈来,执行任务出色到惊人。

然而,激动的工程师们很快发现,这份兴奋只是暂时的。

当他们把这个新模型转化为o3聊天版本时,那种惊人的性能提升消失了。

可以说,这次事件,正是OpenAI在今年大部分时间里所面临技术挑战的一个缩影。这让OpenAI不仅内部技术进展缓慢,大获成功的ChatGPT业务也受到波及。

比如,它的编程和数学能力又有了显著提升。另外,它在驱动AI智能体方面也优于前代模型,只需要极少人工监督,就能处理复杂任务。

它能遵循极其复杂的指令,比如支持智能体何时应批准退款的规则。而在以往,模型需要学习多个棘手的「边缘案例」,才能处理此类退款。

但总的来说,这些改进根本无法与2020年GPT-3到2023年的GPT-4之间的性能飞跃相提并论。

也就是说,我们需要做好对GPT-5失望的准备。

不过,OpenAI模型的任何改进,即便是渐进式的,也能刺激客户需求,以及给投资者信心。这样才能支持OpenAI未来三年半烧掉450亿的计划,毕竟租用服务器实在是太昂贵了。

最近曾有OpenAI高管向投资者透露:沿着目前架构,他们相信模型有朝一日会达到GPT-8的水平。

CEO奥特曼也表示过,利用现有技术,OpenAI有望创造出AGI。

是什么给了他们这样的信念?

一位了解内情的微软员工透露了玄机:测试GPT-5后,他们发现它在不消耗更多算力的情况下,就能生成更高质量的代码和文本。

部分原因在于,它学会了精准判断出不同任务所需的计算资源量。

不过OpenAI内部,可并非一片和谐。

比如一些高级研究者,非常抵触将自己的成果交给微软,尽管这位最大股东拥有的合同权利截至到2030年。

虽然两家公司财务紧密,但在具体合作条款上,却始终争执不休。最新信息是,OpenAI重组营利性部门后,微软很可能在其中获得33%的股份。

而小扎以天价薪酬挖走的团队,也让OpenAI内部陷入了更大的混乱。

走了这么多人,只能紧急进行组织架构调整。

上周,OpenAI的研究副总裁Jerry Tworek在Slack上向上司、研究主管Mark Chen抱怨团队变动的事,许多同事都看到了这条信息。

当时,Tworek表示需要休假一周来重新思考,但最终并未休假。

总之,直到今年6月,情况依然很严峻:OpenAI开发的模型中,没有一个能顶得住GPT-5的名号。

好在,「推理模型」成了他们的全新突破口。

23年末一项名为Q*的技术突破,能解决前所未见的数学问题,在OpenAI研究者中引发了巨大震动。

基于Q*,OpenAI开发了许多推理模型,在获得更多算力时,它们就会表现更佳——看起来,预训练的性能增长瓶颈,就要被克服了。

去年秋天,第一个推理模型正式推出,它就是o1。24年底,OpenAI利用与o1基础相同的GPT-4o,又推出了推理模型o3。

据说,虽然师出同门,但o3的教师模型在理解科学知识方面,比o1的教师模型进步大得多。

背后原因,就是OpenAI用了更多英伟达芯片来开发o3的教师模型,这就让它理解复杂概念时能力更强。

还有一个原因,就是它被赋予了搜索网络,以及从代码库中提取信息的能力。

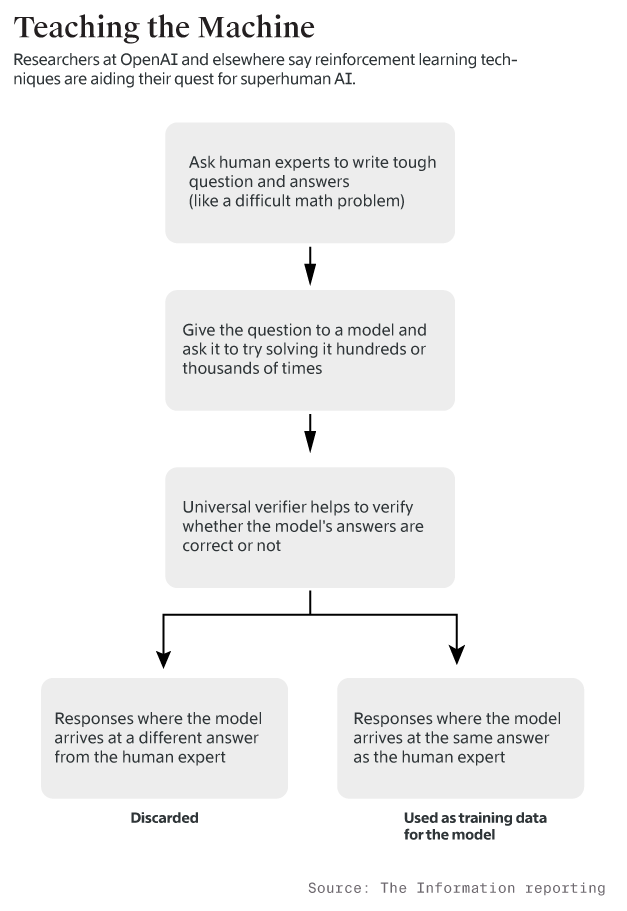

并且,它也同样受益于强化学习。此过程中,人类专家在生物学、软件工程和医学上提出刁钻的问题和答案,然后让模型针对这些问题生成数千个自己的回答。

随后,OpenAI会利用那些与人类专家得出相同答案的AI生成回答(也即「合成数据」)来训练模型。

o3模型发布后,一度成为全球头条,引发病毒式讨论,然而现实很快给了当头一棒。

当o3的教师模型转换为学生模型,变成一个可以让人们提问的聊天版本时,它的性能显著下降,甚至跟o1相比没有任何区别。

同样,创建让企业通过API购买的版本时,同样的问题也出现了。

有知情人分析,原因是这样的:o3理解概念的方式很独特,跟人类的交流方式大相径庭。

因此,如果创建一个聊天版本,其实就拉低了这个原始天才级模型的智能水平,因为它被迫用人类语言,而非自己的语言去交流。这种情况下,它的推理链条就会被迫压缩、扭曲。

甚至有开发者在调试时,偶尔能看到模型输出「乱码」般的中间语言——那可能就是它「思考」的原始形态,也就是这个天才原本的样子。

还有人认为,OpenAI没有投入足够精力来训练模型在聊天场景中与人类进行有效沟通。

总之,o系列模型让ChatGPT的用户非常困惑,因此公司决定重新回归GPT的命名体系。

好在,OpenAI还有办法。

据悉,内部正在开发一种「通用验证器」,可以自动化地确保模型在RL过程中产生高质量的答案。

本质上,这个过程是让一个LLM承担起检查和评估另一个模型答案的任务,并利用各种信息源来对答案进行研究核实。

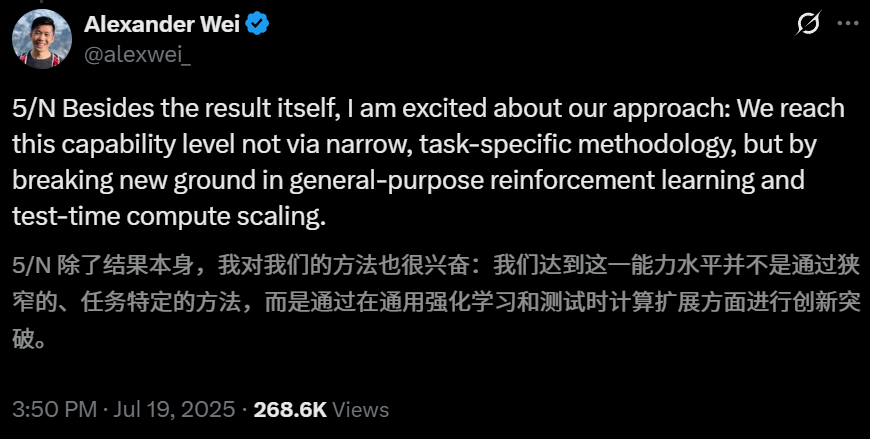

前一阵OpenAI的模型在数学竞赛中拿了金牌后,高级研究员Alexander Wei在X上表示,他们所使用的强化学习方法是「通用」的。

也就是说,这个模型不仅能检查编程这种标准答案清晰的内容,甚至还能判断写作这种主观性很强的内容质量。

这就对GPT-5助力极大!

OpenAI强化学习团队负责人Tworek最近也公开表示,自己认同这个观点:OpenAI模型背后的强化学习系统,其实已经具备了通往AGI的潜力。

目前,包括xAI和谷歌在内的AI大厂都已加倍押注强化学习。

上周,Altman在播客节目中,描述GPT-5的能力说,它轻松解决了一个他根本看不懂的问题,直接让他坐到椅子上,感到晕眩。

这就进一步点燃了我们对GPT-5的狂热期待。

「在几乎所有方面,GPT-5都比我们更聪明。」

究竟什么样的模型,才配叫作GPT-5?好在,我们要等的时间不多了。

内容中包含的图片若涉及版权问题,请及时与我们联系删除