打拳、跳舞、跑马拉松……“不务正业”的机器人终于能帮人洗衣服了!

刚刚,Figure公司创始人Brett Adcock发布了一段Figure.02机器人在家中洗衣服的演示视频。

视频里,机器人半蹲,双手协作,左手拿着衣篓,右手一件件将衣服放进洗衣机,中途还不时调整衣物的位置。

据Adcock表示,这套动作已经在办公室里连续测试了一个月,而这次是机器人首次在真实家庭环境中完成这一任务!

从之前的宝马车间到分拣流水线,再到家里的洗衣房,行业标杆Figure终于“登堂入室”,实现了真正的工业和家用场景操作。

那么,Figure到底做了什么?

洗衣服这件“小事”

对于机器人来说,洗衣服这项任务可以分为两个层面:

就像开头Adcock提到的,搭载Helix的Figure.02在办公环境跑了一个月后才在家庭环境中落地,这就体现出任务场景(task environment)之于机器人这类智能体的重要性。

在工业场景下,机器人面对的是结构化、重复、确定的任务。像装配零件、搬动物体这样的任务,都具备清晰、可控的操作流程。

同时,工业场景中物体和设备的位置都相对固定、透明、标准化,接近一个“地图全开”的封闭空间,机器人基本上不会受到外界的干扰。

与工业场景相比,家庭场景则充满不确定性和不透明性。例如,不同的家庭内部布置具有多样性,物体摆放通常没有标准,家庭场景下任务目标比较模糊。

同时,家庭环境还涉及与人类和其他设备的长期、多轮交互。机器人既需要保持稳定性还要确保对人类的安全性。

在“洗衣服”任务中,机器人不仅要面对不同种类、数量、重量和材质的衣服,还要针对不同的家庭布置采取相应的行动(视频中的半蹲)。

因此,当Figure.02开始“洗衣服”,就意味着机器人正从受控的工业空间,逐步走进不可预测的人类生活。

那接下来,问题就变成了:机器人,该如何洗衣服?

对人类来说,洗衣流程并不复杂,但对机器人而言,则需要抓握控制、动态视觉、物体识别、力反馈、任务规划等多种能力协同。

与此同时,衣服作为柔性物体,相较于杯子、瓶子这类刚性物体,没有稳定的外形(其形状会随着外力的施加而变化)和清晰的affordance(可供性),这使得感知、规划与操作都更加困难。

于是,在面对像衣服这样的柔性物体时,机器人如何学习并泛化出稳定的动作策略,就成了技术突破的关键。

为此,Figure.02上搭载的端到端双系统VLA——Helix,成为了一种潜在的解决方案。

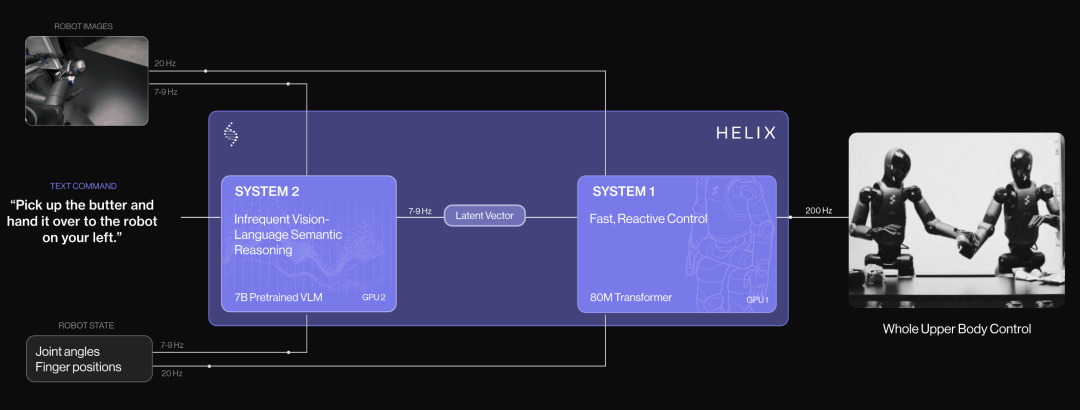

Helix是第一个双系统VLA模型,用于对整个人形上身进行高速、灵巧的控制。

其中,System 2是一个7B视觉语言模型,以每秒7–9Hz对图像和语言指令进行高层语义推理。

System 1则是一个8000万参数的Transformer模型,以200Hz的频率将前者输出的潜在向量实时转化为精确的身体控制信号,实现对人形机器人上半身(包括关节和手指)的完整动作控制,整个系统结合语言、图像、机器人状态信息协同工作,具备高度泛化与响应能力。

在将衣服放入洗衣机的过程中,Helix的System 2通过视觉与语言理解,识别洗衣机入口和衣物位置,并生成高层语义表示。System 1则以高速将其转化为连续控制信号,协调机器人调整位姿、稳定下肢、操作手臂,实现精准投放。

此外,在之前的技术推文中,Helix主打的是上半身控制(Whole Upper Body Control),但如果我们仔细观察最新的洗衣demo,就不难发现,这一动作过程其实更像是有腿部参与的全身控制(Whole Body Control)。

在操作过程中,机器人需要弯曲膝盖、调整自身位姿(pose),从而准确地找到洗衣机的入口,把脏衣服放进去。同时,在手臂和手指操作的过程中,下半身还要保持稳定。

这就使这段超过40秒的长程任务的难度变得非常大。(没有摇操)

这也正是此次demo的亮点。

不过,当我们冷静下来思考,不难发现,Figure.02展示的其实并不是一个严格意义上的完整的洗衣流程。

正如眼尖网友指出的,真正的洗衣流程应包括:

机器人拿起满满一篮洗衣物、走向洗衣机、打开、装载、选择相关设置、关闭、启动、取出并放入烘干机并执行相同操作,或将其挂起来晾干、折叠,然后收起来的过程。

然而,这种分解任务,增加约束的方式也是现代机器人从工业到家庭跃迁的必经之路:

机器人往往就是先在严格约束的环境中学习子任务,随后系统自动放宽限制,赋予其更高自由度与自适应能力。

One more thing

自今年2月退出与OpenAI的合作,释出Figure.02和Helix后,Figure似乎并没有什么“大动静”。

在洗衣demo之前,Figure在6月份发布了Figure.02在快递分拣场景的demo。

在物流场景中,Helix系统通过数据扩展和架构改进,显著提升了处理多样化包裹的能力,达到了接近人类水平的速度和可靠性。

具体而言,Helix现在能够快速处理包括变形聚乙烯袋和扁平信封在内的多种复杂包裹类型,平均处理时间缩短至4.05秒/件,条形码扫描成功率提升至95%,展现了强大的自适应能力和灵活性。

而在7月份,则放出了一个相对重磅的消息:F.03电池。

电驱作为当今机器人的主流驱动方式,其性能和效率在很大程度上依赖于电池技术的进步。

Figure的F.03电池显著提升了能量密度,优化了安全性与可靠性,同时降低了成本和体积,成为电驱机器人领域的新标杆。

那么,电池来了,Figure.03还会远吗?

参考链接

[1]https://x.com/adcock_brett/status/1950687436801220798

[2]https://www.figure.ai/

[3]https://www.youtube.com/watch?v=lkc2y0yb89U&t=2s

[4]https://www.figure.ai/news/helix

一键三连「点赞」「转发」「小心心」

欢迎在评论区留下你的想法!

— 完 —

🌟 点亮星标 🌟

内容中包含的图片若涉及版权问题,请及时与我们联系删除