阿里巴巴通义千问团队推出Qwen3-Coder-Flash,一款轻量化AI编程模型,旨在平衡性能与效率。该模型拥有强大的Agent智能能力,在代理式编程、自动化浏览器操作及工具调用方面表现优异,接近部分闭源大模型。特别之处在于其原生支持256K tokens上下文窗口,并可通过YaRN技术扩展至100万tokens,有效解决大型项目代码理解不连贯问题。Qwen3-Coder-Flash已在ModelScope及Hugging Face等社区开源,方便开发者本地部署,构建个性化代码辅助工具。

💡 Qwen3-Coder-Flash是通义千问团队推出的一款全新轻量化AI编程模型,旨在为开发者提供性能与效率兼顾的解决方案。其全称为Qwen3-Coder-30B-A3B-Instruct,定位为一款高效的AI编程助手。

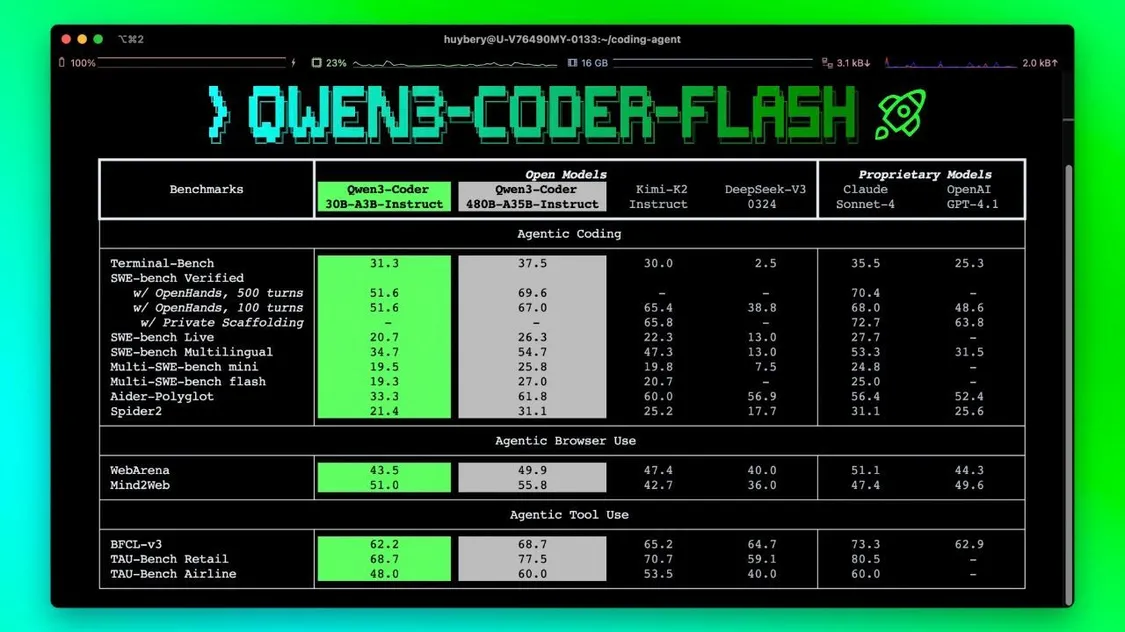

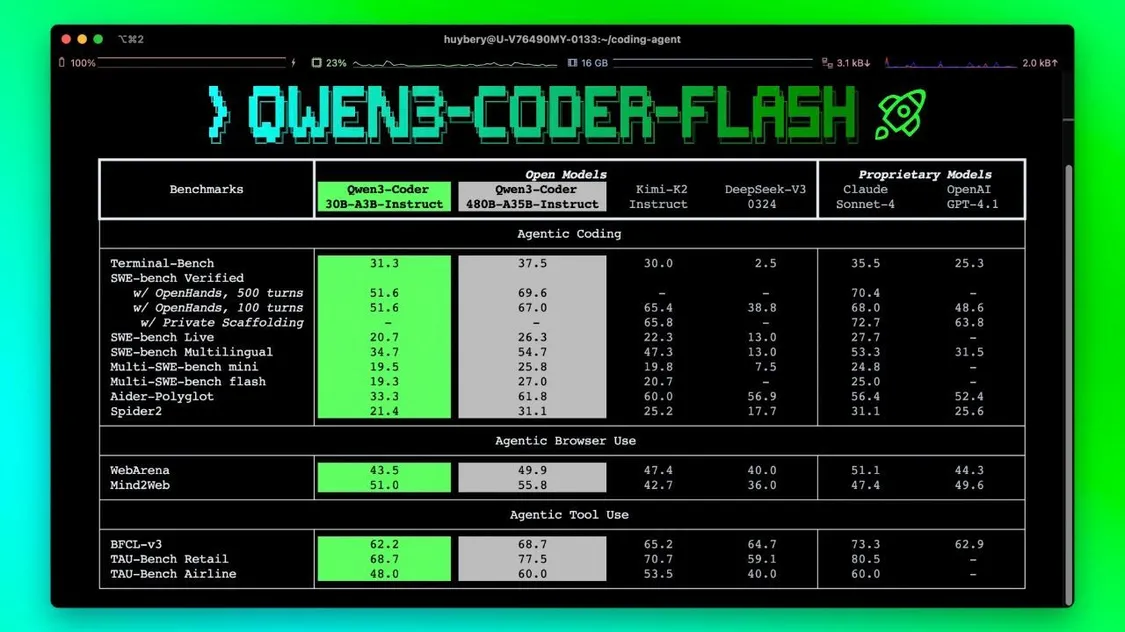

🚀 该模型的核心亮点之一是其强大的Agent智能能力,在执行代理式编程、自动化浏览器操作以及工具调用等复杂任务时表现突出,性能已接近部分行业领先的闭源大模型,为开发者提供了强大的自动化编程支持。

📚 在代码上下文理解方面,Qwen3-Coder-Flash提供了原生256K tokens的上下文窗口,并可通过YaRN技术进一步扩展至100万tokens。这意味着模型能够一次性理解和处理整个代码库级别的项目,显著提升了处理大型复杂项目的效率和准确性。

🌐 为了方便开发者使用和集成,Qwen3-Coder-Flash已在魔搭社区(ModelScope)及Hugging Face等主流AI社区正式开源,开发者可以根据自身需求,将其自由部署于本地硬件,构建个性化的代码辅助工具,降低了AI编程技术的应用门槛。

8月1日,阿里巴巴通义千问团队今日宣布,正式推出其Qwen3-Coder系列的一款全新轻量化编程模型——Qwen3-Coder-Flash。该模型的发布,旨在为开发者社区提供一个在性能与效率之间取得更佳平衡的AI编程解决方案。

据介绍,这款新模型的全称为 Qwen3-Coder-30B-A3B-Instruct,其核心亮点之一在于其强大的Agent智能能力。官方资料显示,该模型在执行代理式编程(Agentic Coding)、自动化浏览器操作以及工具调用等复杂任务时表现突出,其性能在主流开源模型中具备显著优势,已接近部分行业领先的闭源大模型。

对于开发者长期关注的代码上下文理解能力,Qwen3-Coder-Flash也给出了强有力的回应。该模型原生支持长达256K tokens的上下文窗口,并通过YaRN技术可进一步扩展至100万tokens。这意味着模型能够一次性理解和处理整个代码库级别的项目,有效避免了因上下文长度限制导致的代码理解不连贯问题,为处理大型复杂项目提供了便利。

目前,为了方便广大开发者使用和集成,Qwen3-Coder-Flash已在魔搭社区(ModelScope)及Hugging Face等主流AI社区正式开源。开发者可以根据自身需求,将其自由部署于本地硬件,构建个性化的代码辅助工具。