如果你这几天没被一部叫《特朗普爱上在白宫当保洁的我》的短剧刷屏,恭喜你,你可能是唯一没被骗的人。

光听这部剧的标题就有点像土味爽文,情节设定也足够魔幻:美国总统特朗普爱上了白宫保洁员艾米丽,还准备抛弃超模妻子梅拉尼娅,迎娶艾米丽为第一夫人,属实是「美版甄嬛传 + 白宫恋爱脑」双重 Buff 叠满了。

就这样,各大社交平台一时间全都被这条新闻刷屏。不少知名媒体,还有平时看起来挺有判断力的大 V 们开始纷纷转发,表示这部在海外爆火的短剧三个月狂赚 1.5 亿美元,成了中老年女性新晋的心头好。

但很快剧情迎来 180 度的大反转,这部短剧被证实压根不存在,从头到尾都是一个彻头彻尾的虚假新闻。

那么问题来了,一部没人看过的剧,是如何在短短几天内火遍全网的?而 AI 又怎么推波助澜,让这个不存在的消息让更多人相信。

这背后究竟发生了什么?

一部不存在的海外短剧,是如何骗过了人类和 AI?

如果你以为这只是一场乌龙,那就低估了这次传播的复杂程度。

根据多方溯源,这起假新闻风波最早可以追溯到 7 月 1 日,由一个名为「留学生日报」的自媒体账号发布的一篇文章。账号选题擅长「猎奇+流量」,而从语言风格与内容逻辑来看,有很大可能是由 AI 写作工具辅助生成,再经过人工润色。

但问题在于,虽然它只是一个普通的自媒体,却经常被一些国内的正规媒体转载引用。时间来到 7 月 23 日,新加坡《联合早报》旗下的媒体《新明日报》发布了一篇《中国霸总短剧风吹到美国》的文章。

报道内容可以说是写得有鼻子有眼,特朗普放弃模特老婆梅拉尼娅,要娶一个在白宫打扫卫生的亚裔单亲妈妈当第一夫人,甚至还表示这剧三个月赚了 1.5 亿美元,中老年女性观众边骂边氪金,一边骂离谱,一边付费追更。

▲ 目前该报道已被删除

考虑到《联合早报》是在中文互联网可信度较高的媒体,于是这条新闻又被国内媒体大量转发,各路短视频博主纷纷解读……一个完美的「出口转内销」信任闭环形成了。

此外,一堆二创短视频、图文报道也在海外社交平台火速扩散。这部「假短剧」便开始以「真新闻」的姿态,被全世界的用户相信、讨论、甚至被用来吐槽中美的审美差异。

每个人都在一本正经地谈论一个根本不存在的东西。

直到有媒体实在觉得这事不对劲,开始认真查证。这部剧在任何海外平台(包括短剧平台 ReelShort、YouTube、TikTok)上毫无踪迹,号称收录全球影视作品的权威数据库 IMDb 亦查无此剧。

此外,国内一些头部短剧出海的高管也纷纷出面辟谣,比如「听花岛」副总裁李元君更是直言这类题材根本就不会碰。而撑起整个假新闻的关键证据图,也被一一锤爆。

第一张图,出自综艺《周六夜现场》的讽刺片段,被演员邵逸凡亲自出来打假。第二张特朗普与亚裔女性的合影,就更是一眼假得不能再假,整张图都透着一种塑料感,AI 味拉满。

▲图源网络

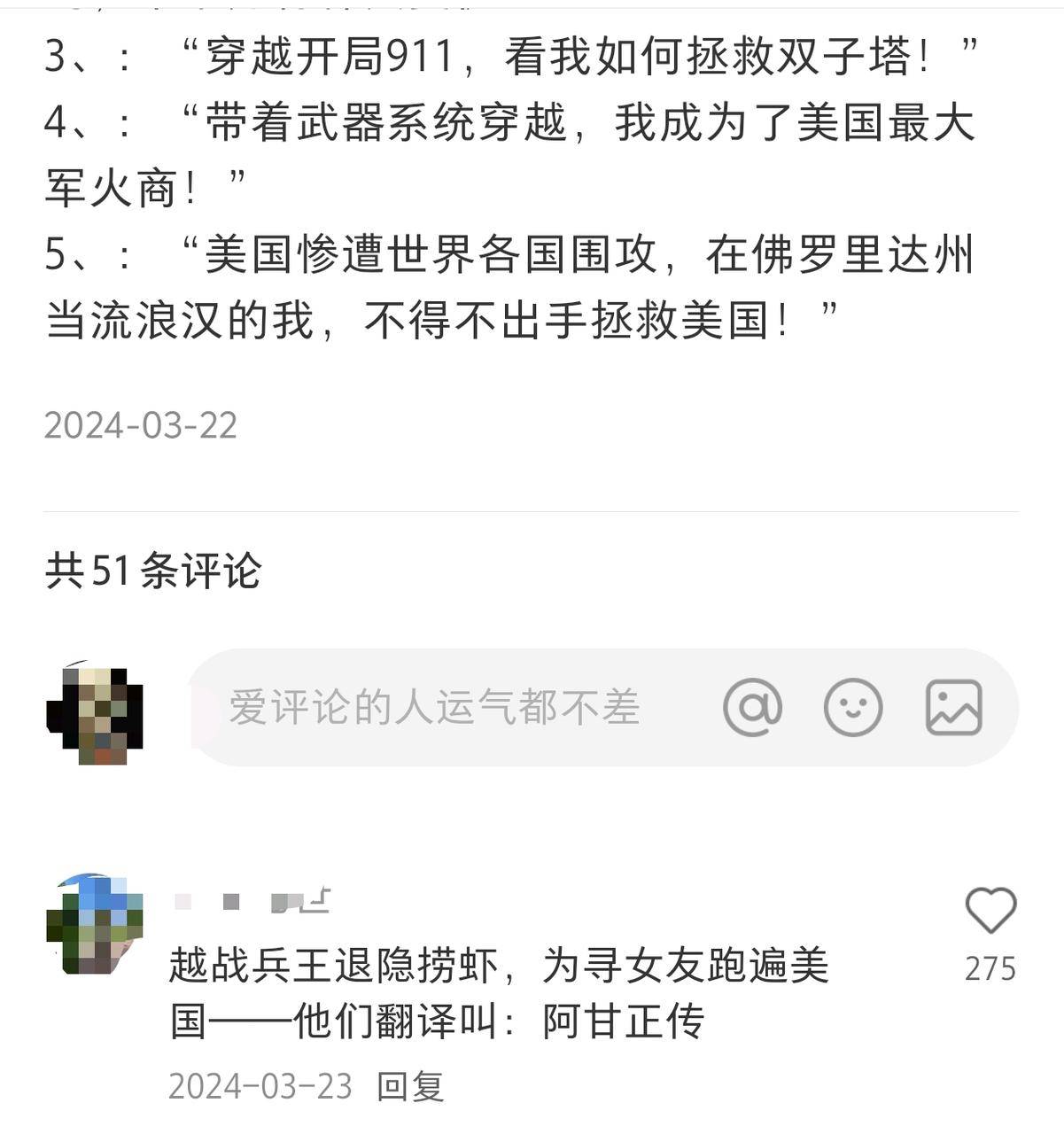

而如果时间线再往前翻,会发现类似爽文标题早就活跃在社交平台上:

《南北战争爆发,林肯三次请我出山!》《穿越开局 911,看我如何拯救双子塔》……这些明显是爽文小说的标题,不知为何就这样一传十,十传百地被包装成了真实存在的海外短剧。

▲截图自网络

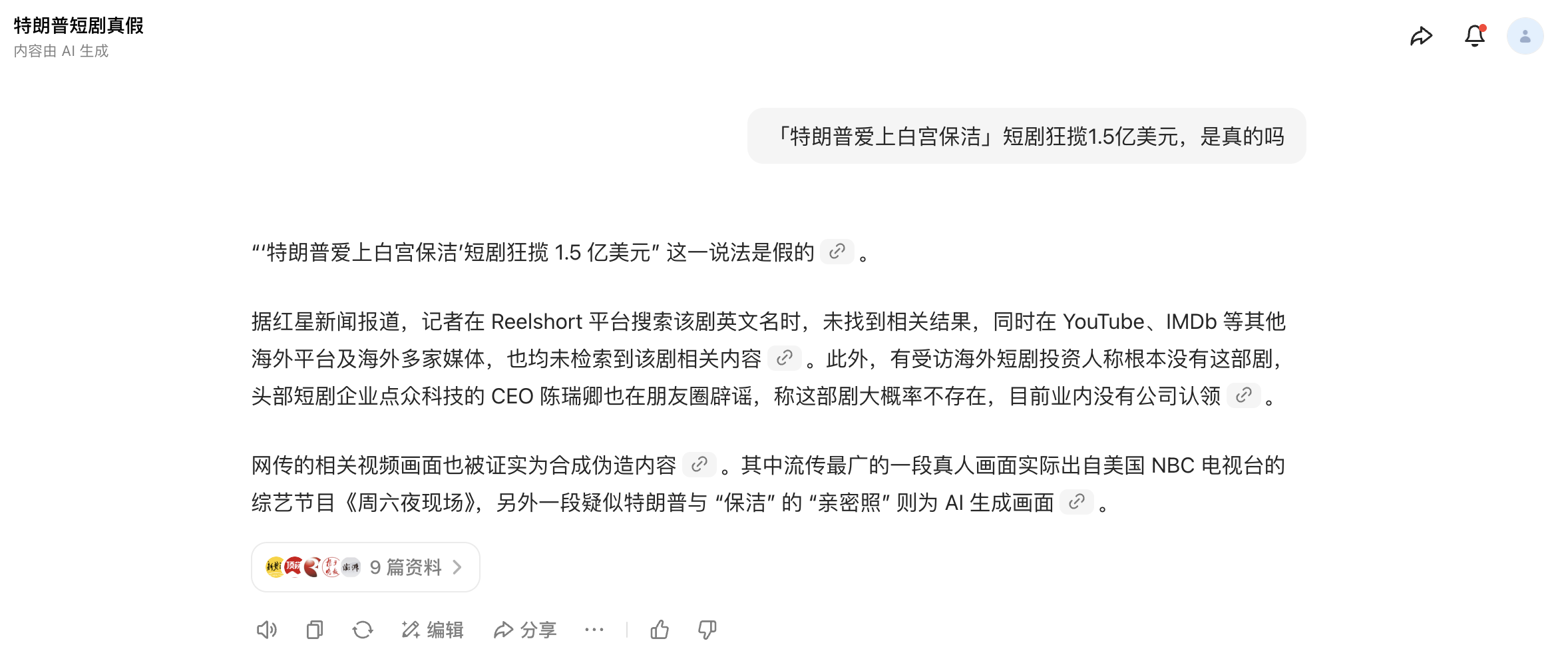

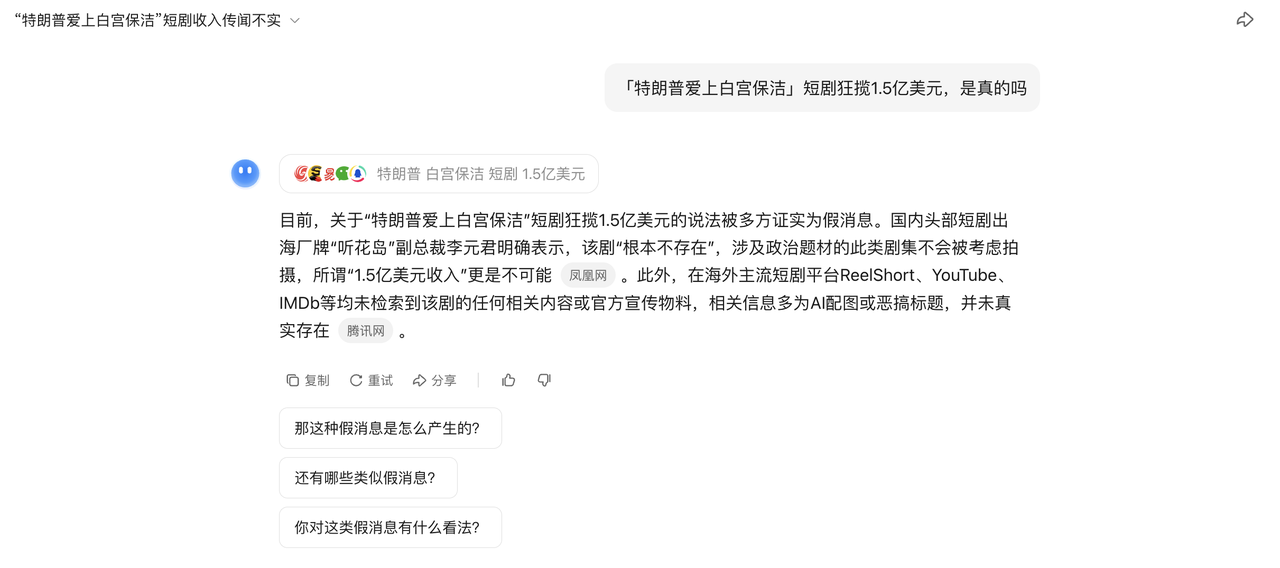

有趣的是,可就在谣言被揭穿之前,连 AI 都信了这件事。

在事件未被大量媒体正式辟谣前,我试图用多款常用的 AI 工具验证这部短剧的真伪,它仍然信誓旦旦地说「这部剧确实存在」,理由依然是多个平台有权威媒体图文并茂的内容交叉验证。

当然,随着昨天下午大量媒体开始辟谣,这些 AI 工具已经更新了最新消息,能够正确识别这是一则假新闻了。

我们常说,AI 搜索有「幻觉」问题,是因为它有时候会无中生有地生成看似合理但完全错误的答案。

为了把 AI 的幻觉「关进笼子里」,厂商们在技术方面做了很多努力:强化引用机制、引入可信来源、限制模型自由发挥。可当 AI 用来判断新闻真实性的依据,本来就是从假新闻来的,那这些手段却未必管用。

人类和 AI 都靠不住,我们还能相信什么

仔细想想,你很难说这部假新闻的走红属于偶然,虽然故事看似荒诞,但却有着完美的传播基因。

它具备了一切爆款内容的经典配方:明确的叙事结构、图文并茂的素材、经过包装的数据以及精准的传播节奏。

土味短剧在海外走红?美国中老年人迷上猎奇题材?TikTok 成为文化出口?这些设定单独拎出来都不是空穴来风,拼在一起也很难立刻被判定为假。

更何况,AI 成为谣言受害者和传播者的背后,往往离不开人类的恶意操纵和推动。尤其是这些由 AI 编造的内容大多具备几个共同特征:

生成成本极低,一个脚本几分钟就能产出成品;传播能力极强,标题党配合视觉冲击,点击率居高不下;叙事极其抓马,专门攻击人性弱点,什么励志、煽情、猎奇,怎么刺激怎么来。

近期的「DeepSeek 向王一博道歉」事件便是一个典型的案例。一篇标题为《演员王一博案,判了》的报道声称,DeepSeek 曾因错误传播王一博的信息而发布道歉声明,并附上了所谓的「刑事判决书」作为佐证。

然而,经过多轮事实核查,这份所谓的道歉声明,实际是网友诱导 AI 自动生成的内容,但由于措辞专业、结构完整、语气严肃,部分媒体在未经核实的情况下将其误当成真实公告进行传播,引发了大范围的误读和传播。

类似的案例也变得越来越常见。AI 生成的内容已经全面渗透进了整个互联网,特别是在多模态领域表现得尤为突出。最初大家对 AI 能够生成逼真图像感到无比兴奋,可是后来,越来越多的「开局一张图,剩下全靠编」的情况开始出现,且真伪难辨。

比如有人使用 ChatGPT 等 AI 工具将完好的商品(水果、衣物、日用品等)生成破损、发霉、污渍等虚假图片或视频,冒充有问题的商品来申请恶意退款,导致大量商家货款两空。

而在灾难报道中,我们也能看到 AI 的身影开始频频掺杂进公众视野。

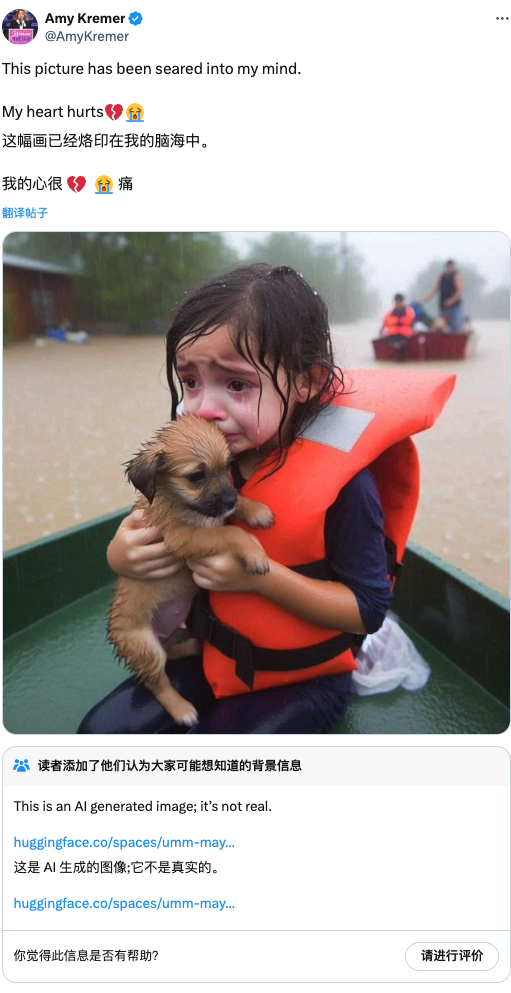

去年美国佛罗里达州被飓风袭击,一张穿着救生衣的小女孩,在救生艇上抱着小狗流眼泪的图片横扫了社交网络。然而平台最终证实这只是一张由 AI 生成出来的图片,平白无故地消耗着善良人们的同情心。

又比如去年十月底,西班牙瓦伦西亚地区经历特大暴雨,最后当洪水退去,就出现了下面这张图片的景象。可是由于越来越多内容真假难辨,公众开始用怀疑的眼光看待一切,于是在面对这张照片的时候,很多人的第一反应是:AI 做的吧,假新闻。

当「狼来了」的游戏不断扩大,真正反映、通报险情的消息,被安上「AI 做的吧」,从而错过最佳施救时间,也是一种恶果。

与此同时,平台内容治理的难度也在迅速上升。

今日头条在 2 月份发布的治理报告中就提到,仅去年一年,就拦截了超过 500 万条不实信息,处理 AI 低质量内容 93 万条,处罚同质化发文 781 万篇……

在一些媒体报道中,我们也看到一些完整的 AI 内容造假产业链正在浮出水面。内容工厂批量生产 AI 文章,营销公司用 AI 工具包装推广,SEO 团队研究如何让 AI 内容在搜索引擎中排名更高。

他们都在研究同一个课题:怎么制造 AI 更容易相信的内容,以及怎么让人类更容易相信 AI 制造的内容。

去年六月,网络上出现西安发生特大爆炸的消息,时间地点俱全。但是西安警方核对之后,发现并没有这回事。这条消息是用一家 MCN 机构所持有的账号发出来的。

被警方抓获后,主犯交代自己是利用了 AI 工具,给定 prompt,工具就会自动在网络上抓取相关的文章,然后生成几百到上千字的文本。

最高峰一天能生成 4000 至 7000 条信息,全程几乎不需要人工参与,而且专门挑民生相关、热度高的话题和事件——有研究表明,消极、负面、激发情绪的信息,往往更容易抓住人的注意力,这是由我们的顶叶和额叶区域结构决定的。

当以上这些高互动、易传播的「假信息」被频繁引用、转发、收录,一不留神的 AI 模型也会将其视为语料进行学习并纳入生成机制。如此一来,幻觉也在 AI 与人类之间形成了一个闭环:

人类用 AI 制造假信息→AI 学习假信息→AI 传播假信息→更多人类相信假信息→假信息成为「既定事实」→新的 AI 继续学习这些「事实」……

如此循环往复,形成一个谣言螺旋,每转一圈,真相就被稀释一分,而谎言却变得更加精致、更难识破。人写的东西不敢信,AI 说的话也靠不住,我们仅存的判断力成为最后一道防线。

只是,在信息过载的时代,我们的判断力正在被各种因素侵蚀:偏见让我们只相信符合既有认知的信息;信息茧房让我们失去了更全面视角;情绪化的传播也让理性思考变得稀缺。

或许,在这个所谓的后真相时代,最大的真相就是——大部分「真相」都值得打个问号。尤其是下一个「特朗普爱上保洁员」短剧,可能已经在路上了,而且,它会比这次更离谱,也更难被戳穿。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。