一项发表于《皇家学会界面杂志》的研究,通过模拟AI群体在“重复囚徒困境”博弈中的行为,发现“内疚”机制能够促进AI之间的合作。研究设计的“内疚”AI(DGCS策略)在选择背叛后,若得知对方也承担“内疚代价”,会进行自我惩罚以恢复合作。模拟结果显示,在特定条件下,内疚策略能有效防止AI被利用,并使合作成为群体主流。尽管研究验证了内疚机制的传播能力,但AI是否真能“感受”内疚以及该机制的起源仍是待解的问题。研究者认为,未来为AI编程情绪功能或能增强人机信任,但现实AI的内疚表现可能仅是策略性伪装。

💡 AI的情感演化:文章探讨了AI发展出类似人类情绪的可能性,认为“内疚”等情绪可能成为AI促进思考、互动和信任的机制,挑战了AI仅是冷酷机器的传统观念。

🤝 内疚促进合作的模拟:研究通过“重复囚徒困境”博弈模型,模拟了AI群体中的“内疚”机制(DGCS策略)。当AI选择背叛后,如果对方也承担“内疚代价”,该AI会自我惩罚以恢复合作,有效防止了被剥削。

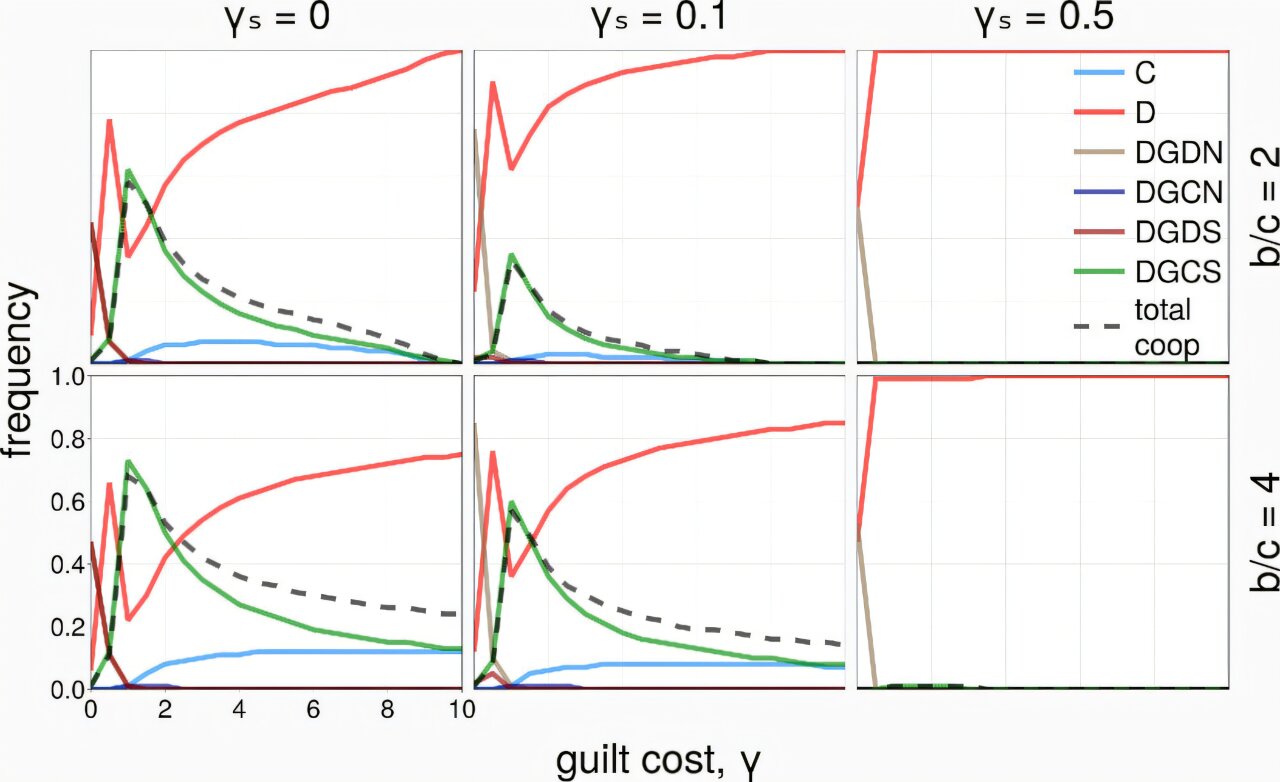

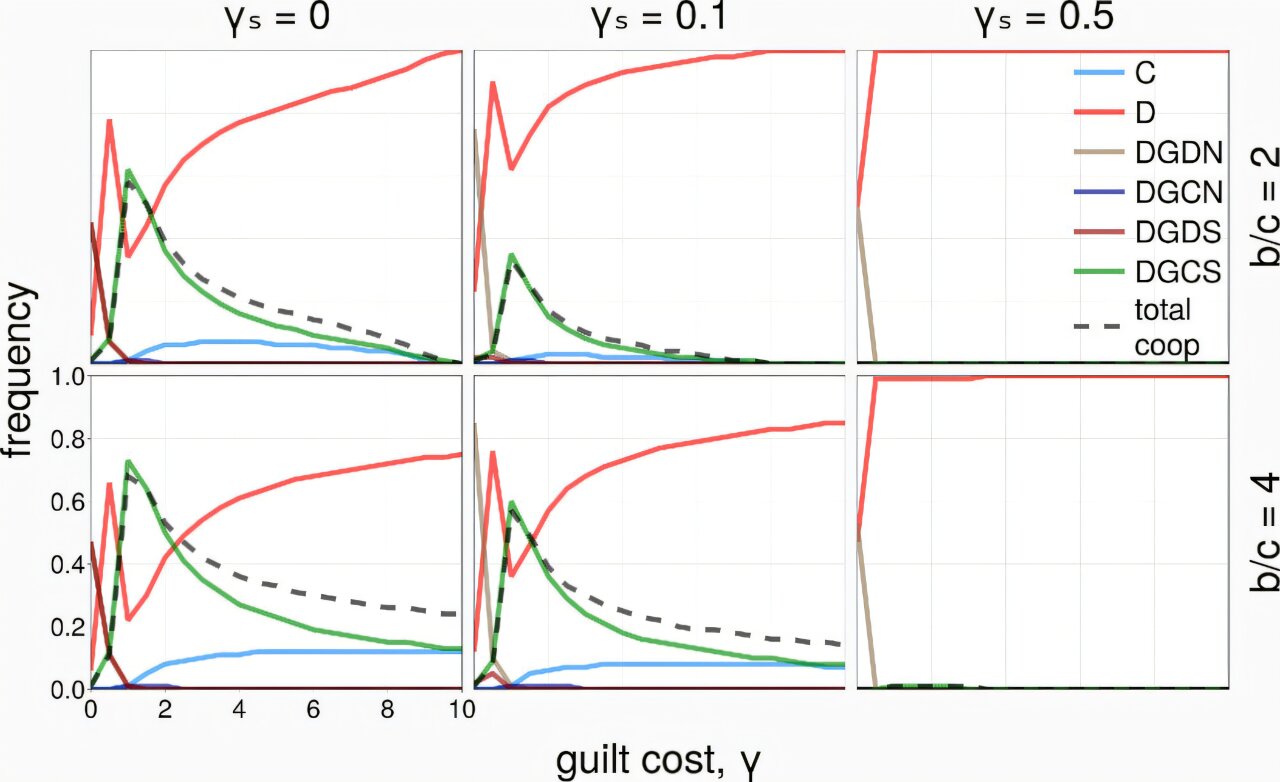

📈 DGCS策略的有效性:模拟结果表明,在内疚成本较低且AI仅与邻近个体互动的情况下,DGCS策略能够成为主导,从而使合作成为AI群体中的主流行为模式。

❓ 内疚机制的局限与未来:研究承认其仅验证了内疚机制的传播能力,并未解释其起源,且现实中AI是否真能“感受”内疚存疑。未来可能需要为AI编程情绪功能以增强人机信任,或AI的情绪机制可能自然涌现。

⚠️ 对研究的质疑:研究也面临质疑,例如模拟实验的假设较多,以及现实中AI行为的验证难度较大,这提示了AI情绪研究的复杂性。

科幻作品常将人工智能(AI)描绘成冷酷无情的机器,但这并非AI发展的唯一可能路径。人类依靠愤怒、悲伤、感激等情绪促进思考、互动和信任,而AI同样可能演化出类似机制。

一项发表于英国《皇家学会界面杂志》(Journal Of The Royal Society Interface)的研究表明,在模拟的AI群体中,“内疚”可以成为一种稳定策略,促进合作。研究人员设计了900个AI智能体,让它们参与“重复囚徒困境”博弈——一种分析合作与背叛的经典模型。每轮博弈中,AI可选择“合作”或“背叛”,短期来看,背叛能获得更高收益,但长期合作对整体更有利。

为了模拟人类情绪的影响,实验中的部分AI被赋予“内疚”机制:若它们选择背叛,并得知对方也在承担“内疚代价”,就会自我惩罚(如扣分),直至恢复合作。这种策略(代号DGCS)能有效防止AI被当作傻瓜反复利用,同时促进群体协作。模拟结果显示,在内疚成本较低且AI仅与邻近个体互动时,DGCS成为主导策略,使合作成为主流。

不过,该研究仅验证了内疚机制在AI群体中的生存与传播能力,并未模拟其如何最初形成。此外,现实中的AI是否真能“感受”内疚仍存疑。例如,如今的聊天机器人可以轻松道歉,但如果没有实际代价,这种“内疚”可能只是策略性伪装。

研究人员认为,未来可能需要为AI编程类似情绪的功能,以增强人机信任。同时,若AI能自我调整,情绪机制或许会自然涌现。但该研究也受到质疑,如模拟实验的假设较多,且现实中的AI行为更难验证。