在影视作品里,我们看过太多机器人失控的场面。一些应对方案的段子也早已烂熟于心:断网、拔电、重启三连,一键送它回炉重造。

但现在,这一套流程可能不太管用了。

今天,Google DeepMind 推出了一款全新机器人控制模型——Gemini Robotics On-Device。这款大模型能在机器人本地运行,集视觉识别、语言理解和动作执行于一体。

而它最大亮点在于,即使完全离线,它也能理解人类指令,流畅完成任务。

比起诸如 ChatGPT、Gemini 等擅长聊天、写作、答题的大模型,Gemini Robotics On-Device 则给机器人装上了一个真正的「大脑」,让其也能具备类似的理解力和执行力。

它本质上是一个专为双臂机器人打造的 VLA 基础模型,顾名思义,Vision(视觉)+Language(语言)+Action(动作),三者结合,看得见、听得懂、动得了,是它的基本素养。

举例而言,你可以对机器人发出请求:「请把这件衣服叠好,再放进背包里,拉上拉链。」过去这需要提前编写程序、分解动作,现在 Gemini On-Device 可以直接理解这句话的意思,然后一步一步执行下来。

那既然联网也能跑,为什么还要费劲折腾本地运行?答案不外乎速度和稳定性。

机器人若需将数据传至云端、等待服务器分析再返回结果,必然产生延迟。在医疗操作、灾难救援、工厂自动化等任务中,延迟容错空间几乎为零。何况,现实中许多地方网络条件差,甚至完全无网。

实际上,让机器人顺利应对复杂、动态的现实任务,一直是 AI 领域最难啃的骨头之一。

从公开视频看,Gemini On-Device 已能胜任多种常见场景,如叠衣、拉链、抓取陌生物体并放置到指定位置。而这一切得益于它的学习机制。

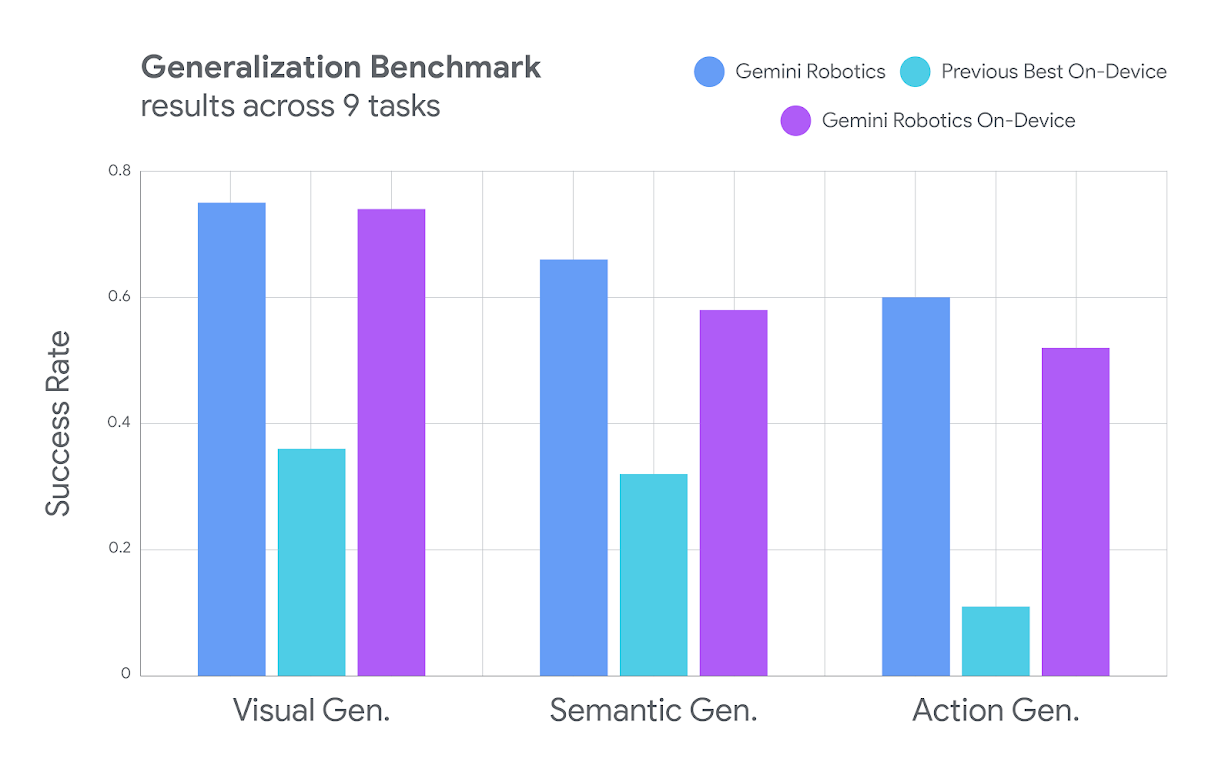

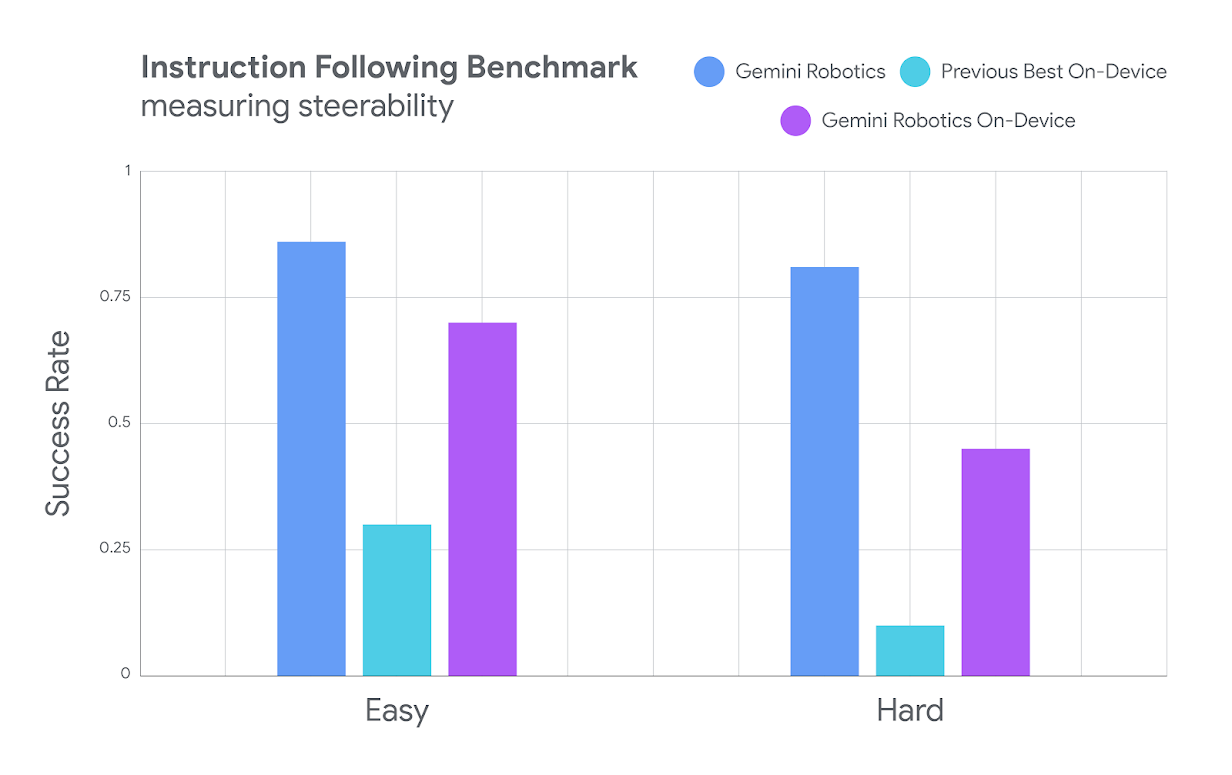

▲强大的泛化能力

它不需要从零开始进行长时间训练,开发者仅需提供 50 至 100 次人工演示,如亲自操控机器人叠衣,模型便能迅速学会并独立操作。

在更具挑战性的分布式任务或复杂的多步骤指令执行中,Gemini Robotics On-Device 的表现依然优于目前其他本地运行的替代方案。

而且,它的适配性也很强。

虽然 Gemini Robotics On-Device 最初在 Google 自研的 ALOHA 双臂机器人平台上进行训练的 ,但稍加适配,它也能稳定运行于 Franka FR3 工业机械臂。

甚至结构迥异的人形机器人 Apollo 也能丝滑运行,同一个通用模型通过少量学习,就习惯了完全不同的身体形态。

理想情况下,开发者无需为每种新机器人重新训练一个 AI,只需训练一次通用模型,之后通过轻量级的迁移学习即可部署到各式各样的机器人平台上。这种「一模多用」的能力将有望加速机器人技术的普及和应用。

当然,理想归理想,它也还有短板。

随着机器人智能与自主性提升,安全要求也随之提高。Gemini On-Device 虽然能执行动作,但它并不能合理判断你给的任务是否安全,因此,必须为模型加装「安全栓」。

DeepMind 给出的建议是,开发者可以给模型接入 Google Gemini Live API 接口,让系统先判断这个指令合不合理,再决定是否执行;同时在动作层面设置物理限制,如力度、角度、速度,以防意外。

此外,模型多步骤逻辑规划能力仍有提升空间。

像做三明治、整理桌面这这类需要先后逻辑、顺序安排的操作,目前还不在它的舒适区。这和它所基于的 Gemini 2.0 架构有关,未来随着升级到 2.5,这部分能力可能也会补齐。

另一个现实挑战,是数据。

虽然它只需几十次演示就能上手,但最理想的示范,是由真人实际操控机器人时采集的真实数据,而不是虚拟模拟。这类数据训练出来的效果,更快、更准,也更稳定。

▲技术报告地址:https://arxiv.org/pdf/2503.20020

据项目负责人 Carolina Parada 介绍,这是 Google 首次发布完全脱离云端运行的机器人 AI 模型,也是首个供开发者根据自身需求进行微调的版本。

目前,DeepMind 向「可信测试者」开放了 Gemini Robotics On-Device 的 SDK 和模型访问权限。如果你是做机器人开发、工业自动化,或智能系统研究的开发者,现在就可以申请试用。

附上申请链接:https://docs.google.com/forms/d/1sM5GqcVMWv-KmKY3TOMpVtQ-lDFeAftQ-d9xQn92jCE/edit?ts=67cef986

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。