index_new5.html

../../../zaker_core/zaker_tpl_static/wap/tpl_guoji1.html

![]()

本文探讨了通用人工智能(AGI)的发展现状、实现时间表以及可能带来的影响。文章指出,AI在诸多任务上已超越人类,但AGI的实现仍面临争议。产业界乐观,学术界谨慎。文章也分析了历史上的乐观预测,并强调了AGI可能带来的风险,如被滥用或失控。最终,文章呼吁人们对AGI的未来保持警惕,做好准备,以应对可能出现的挑战。

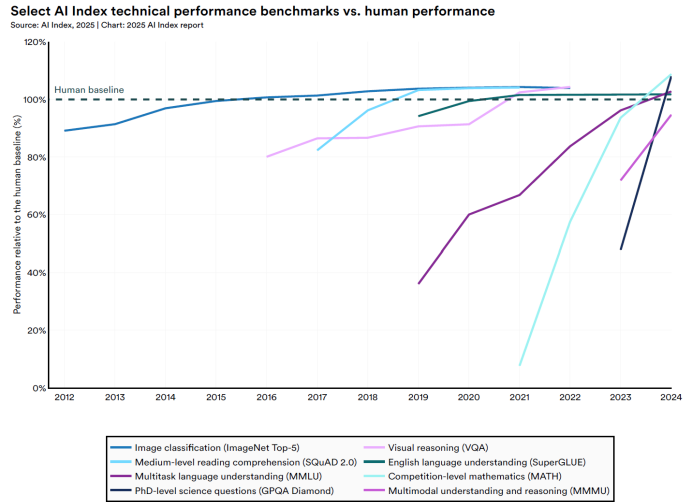

🚀 AI能力突飞猛进:AI在图像分类、阅读理解、视觉推理等多个领域已超越人类水平,预示着在现有基准上“全部超越人类水平”的奇点时刻即将到来。

🎯 AGI的目标与争议:通用人工智能(AGI)是具备跨领域能力、媲美甚至超越人类的AI,成为顶尖AI公司和科研机构的核心目标,但其实现时间表存在巨大争议,乐观者认为很快实现,悲观者认为遥遥无期。

🤔 历史的借鉴与警示:回顾AI发展史,历次技术浪潮中都伴随着对AGI的讨论,过去的乐观预测常被打脸。同时,面对AGI,要警惕可能带来的风险,如被滥用或失控。

⚠️ 风险与应对:AGI可能带来巨大福祉,但也伴随着潜在威胁,如被滥用、接管人类等。文章强调了对AGI风险的重视,呼吁未雨绸缪,做好准备。

原创 闫德利 2025-05-12 16:30 北京

人们盼它来,又怕它乱来。

闫德利 腾讯研究院资深专家

AI发展日新月异,在许多任务上已经陆续超越人类基线水平。如2015年图像分类,2018年中等水平阅读理解,2020年视觉推理、英语语言理解,2023年多任务语言理解、竞赛级数学,2024年博士级科学问题。下图所示的8项关键任务技能中,AI仅在多模态理解和推理能力上还略逊人类一筹,但从2023年开始就加速提升。我们有望很快见证AI能力在现有主流基准上“全部超越人类水平”的奇点时刻。我们已经构建了无数在特定任务上超越人类水平的AI系统,但它们缺乏通用性,无法应对超出预定任务之外的问题,尚处于“狭义人工智能(Narrow AI)”阶段。随着AI性能的大幅提升,具备跨领域能力、在多个方面媲美甚至超越人类的、更强大的AI被提上日程。人们常将之命名为“通用人工智能(AGI)”。各国高度重视AGI。2023年4月28日中共中央政治局会议提出:“要重视通用人工智能发展”;英国《国家人工智能战略》(2021)对AGI进行了专门强调,指出“必须认真对待AGI和更通用AI的可能性”;2024年11月,美国国会下属机构USCC建议 “建立并资助一个类似曼哈顿计划的项目,致力于更快获得AGI能力”;今年,沙特阿拉伯公布了到2050年实现AGI的雄心壮志。实现AGI是顶尖AI公司和科研机构的核心目标。例如,OpenAI的使命是“确保AGI造福人类”;DeepMind在愿景中指出“AGI...有可能推动人类历史上最伟大的变革之一”;Meta把创造AGI作为公司的新目标;DeepSeek在公司介绍中表示“专注于研究世界领先的AGI底层模型与技术,挑战人工智能前沿性难题”;MiniMax自称“领先的AGI科技公司”。实现AGI是长路漫漫,还是指日可待?最乐观的是山姆·奥特曼,他去年11月宣称今年将实现AGI;埃隆·马斯克则表示最晚2026年;达里奥·阿莫迪不喜欢术语“AGI”,认为强大的人工智能(powerful AI)最早可能在 2026年出现,也有可能需要更长时间;DeepMind首席执行官、2024年诺贝尔化学奖得主Demis Hassabis认为AGI将在未来五到十年内实现。如下表所示。龙头AI公司的掌门人给出了乐观判断,认为AGI很快就能实现。然而很多学者认为它需要花费很长的时间,甚至永远不会到来(例如:Iris van Rooij,2024)。斯坦福大学李飞飞教授(2017,2023)表示:“AI仍处于前牛顿时代。”西安交通大学郑南宁院士(2023)表示:“通用人工智能是一个充满着不确定性的未来目标。”图灵奖得主杨立昆(2025.1)指出:“仅靠大型语言模型无法实现 AGI。”南京大学谭铁牛院士近日演讲指出:“通用人工智能还任重道远。” 人们的分歧很大,受身份、职业、年龄等因素影响,甚至对AGI概念本身有着不同理解。AGI最初是由Mark Gubrud于1997年提出;2005年,Ben Goertzel和Cassio Pennachin联合出版了以AGI为名的书籍,进一步普及了这一术语。时至今日,人们对AGI的定义和内涵,甚至它是否具有确切含义,还存在争议。阿莫迪(2024)和杨立昆(2025.1)都明确表示不喜欢术语“AGI”;李飞飞(2024)表示:“坦白说,我甚至不知道AGI是什么意思。”机器学习先驱Thomas Dietterich不客气地指出(2024):“没有人能够用非拟人化的方式定义AGI,更不用说实现它了。整个概念毫无科学性,人们甚至应该因使用这个术语而感到羞愧。”对AGI到来的时间表,人们给出了截然不同的判断。大体是产业界乐观激进,学术界悲观保守。对此无需评说,时间会给出答案。我们不妨从AI大历史观角度,再行审视。人工智能70年的历程,几经起伏。每一次高潮来临,总会引起AGI的争论。上一轮高潮开启于2016年的AlphaGo,2018年就有两个著名的调查。一是AGI-11调查,有近一半受访者认为AGI将在2030年之前出现,近90%认为在2100年之前。二是对23位AI领域最杰出人物的调查,包括Demis Hassabis、Jeff Dean、李飞飞等。要求预测哪一年能够有50%的机会成功实现AGI。最乐观的时间为2029年,最悲观认为要到2200年,平均是2099年;而且对AGI的态度和年龄之间存在相关性,年长者倾向于悲观。两次调查均表明,此次浪潮中人们对AGI到来的时间同样存在巨大争议。以上是近十年的情况,再看最早期的。1956年达特茅斯会议提出“人工智能”概念,与会的年轻科学家后来都取得了非凡的成就。赫伯特·西蒙是图灵奖和诺贝尔经济学奖的双料获得者,他在1965年预测:“二十年内,机器将能完成人能做到的一切工作。”马文·明斯基获得了AI领域的第一个图灵奖,他在1970年接受采访时指出:“在三到八年内,我们将拥有一台与普通人类智能相当的机器。我的意思是,它将能够阅读莎士比亚、给汽车加油、玩办公室政治、讲笑话、打架。”尽管当时还没有“AGI”这个术语,但两位都描绘了AGI的未来图景,作出了过于乐观的判断。乐观的预测常被打脸。杨立昆在2025英伟达GTC大会上指出:“纵观AI发展史,一代又一代的AI研究员一旦发现新范式,就声称——就是它了!十年内或者五年内,我们将拥有人类水平的智能,将拥有在所有领域都比人类聪明的机器。这种情况已经持续了70年,每10年左右就有一波。当前这股浪潮同样是错误的。”然而,声称强大的技术永远不会实现也是不明智的。1933年9月11日,核物理之父卢瑟福把从原子中提取能量的前景描述为“不切实际的幻想”。然而,就在第二天利奥·西拉德就发现了核链式反应,九年后人们成功建造出核反应堆。总之,面对此次大模型浪潮,无非往常一样的两种基本态度。一是“这在以前发生过”(This has happened before,罗珊·凯许的歌名),没大不了的,是被高估的新一轮技术炒作;二是“这次不一样了”(This time is different,卡门·莱因哈特的书名),要变天了,必将引发第四次工业革命。对实现人类水平智能的时间表仍存在很大争议。但实现AGI是多数人的愿望。人类发展史就是一部技术工具史,AGI是一个有待发明创造的强大工具,将深刻改变我们的世界,产生巨大福祉,也会使人类面临可能的风险和潜在的威胁,例如被人滥用、接管人类。因此,人们盼它来,又怕它乱来。辛顿(2025.4)表示:“到那时会发生什么,我们一无所知”“现在有关于安全性的研究,但还远远不够”。牛津大学哲学家Nick Bostrom(2016)曾经指出:“AI对人类的威胁可能比气候变化更大”“我们就像玩炸弹的小孩子”。近年,硅谷流传着 “ P(doom)”(即AI引发人类末日的概率)的讨论,埃隆·马斯克(2024)和辛顿(2025)均认为这个概率是10%-20%。MIT的最新研究指出:采用最理想的监督机制,人类成功控制超级智能的概率为52%;随着AGI日益临近,成功率会下降,全面失控的风险可能超过90%。关键是人类很难觉察自己被AI操纵,就像“老师用糖果控制幼儿园的孩子”一样。这也许是危言耸听,也许永不发生,但不能不未雨绸缪。对此,我们做好准备了吗?

推荐阅读闫德利:《中小企业数字化转型:为何转?何处难?如何转?》

亨利·基辛格等:《基辛格:人类可能是AI发展的最大制约》

👇 点个“在看”分享洞见

阅读原文

跳转微信打开