刚刚,Kimi团队上新了!

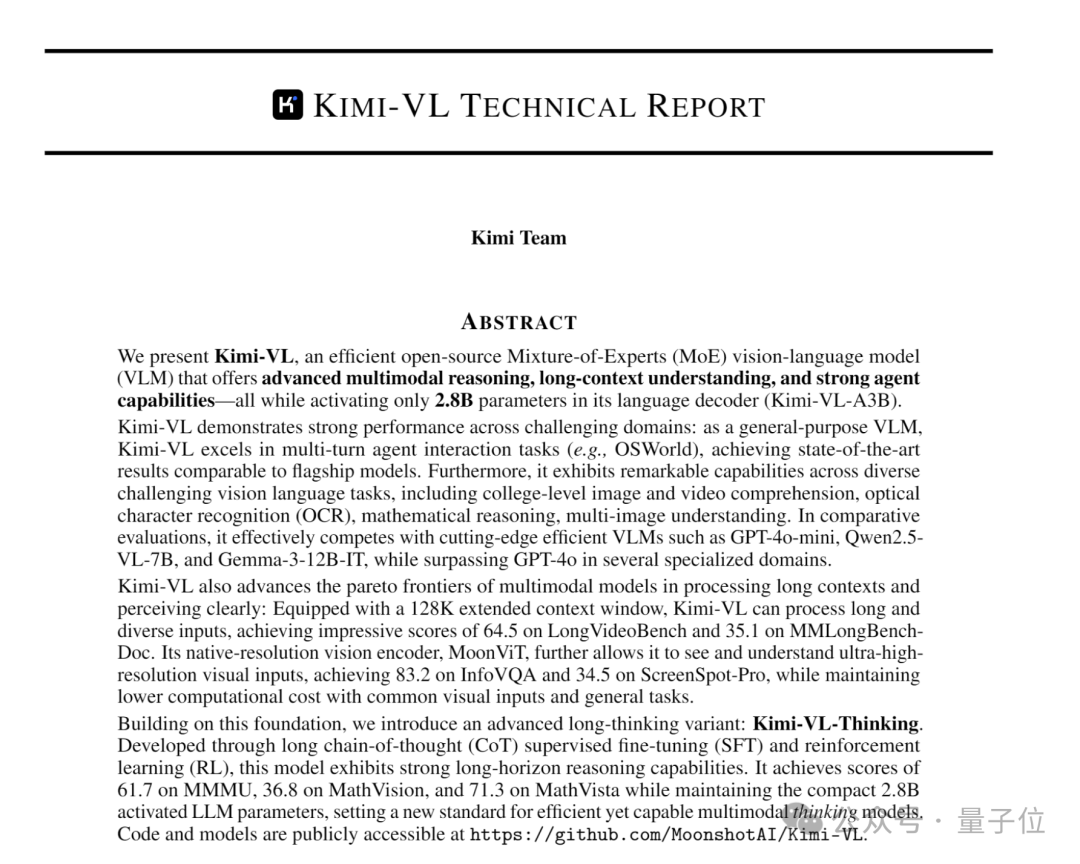

开源轻量级视觉语言模型Kimi-VL及其推理版Kimi-VL-Thinking,多模态和推理双双拿捏。

按照Kimi官方的说法,其关键亮点如下:

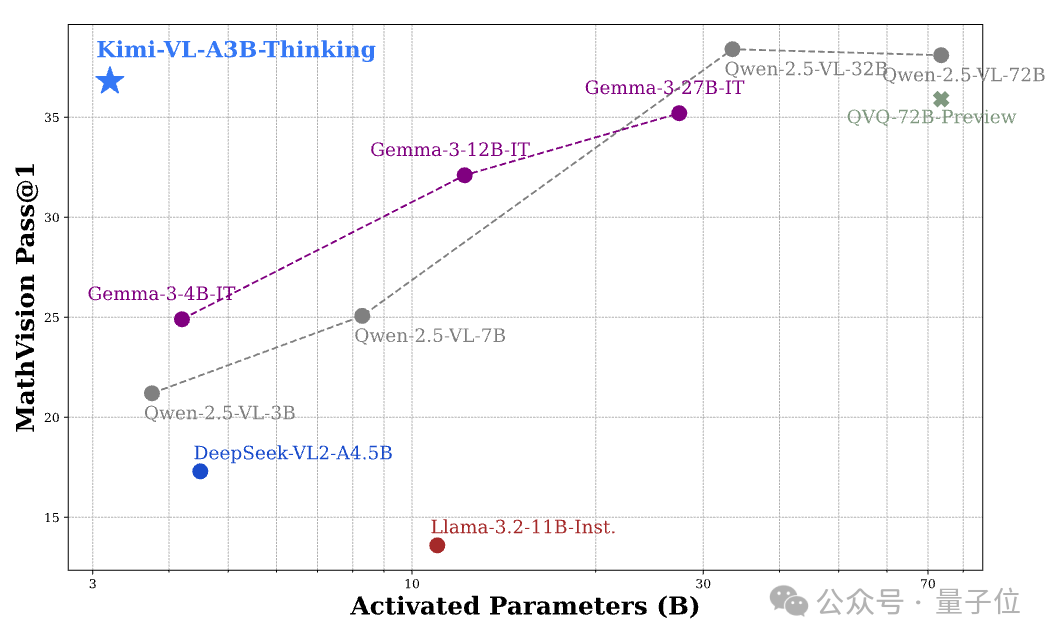

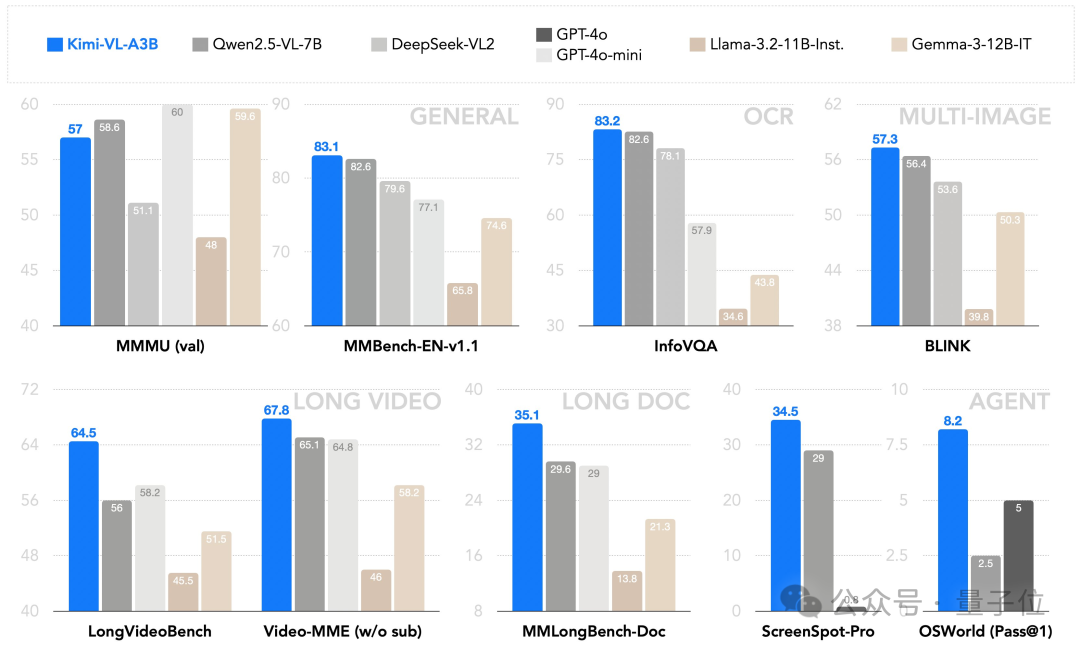

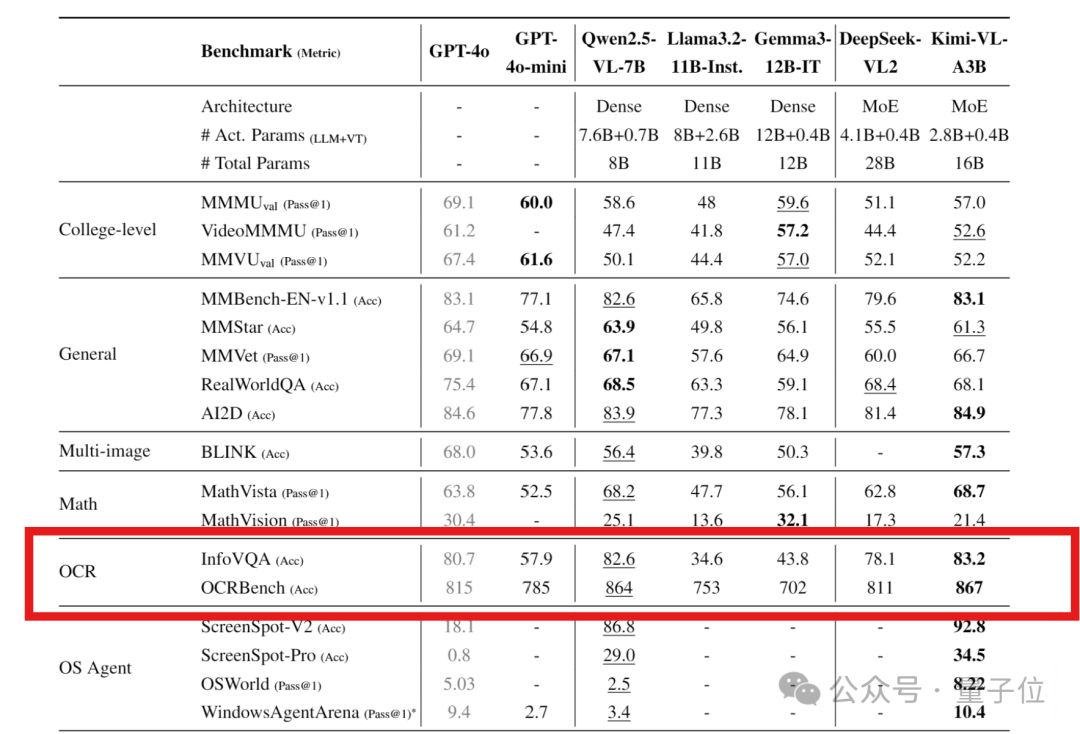

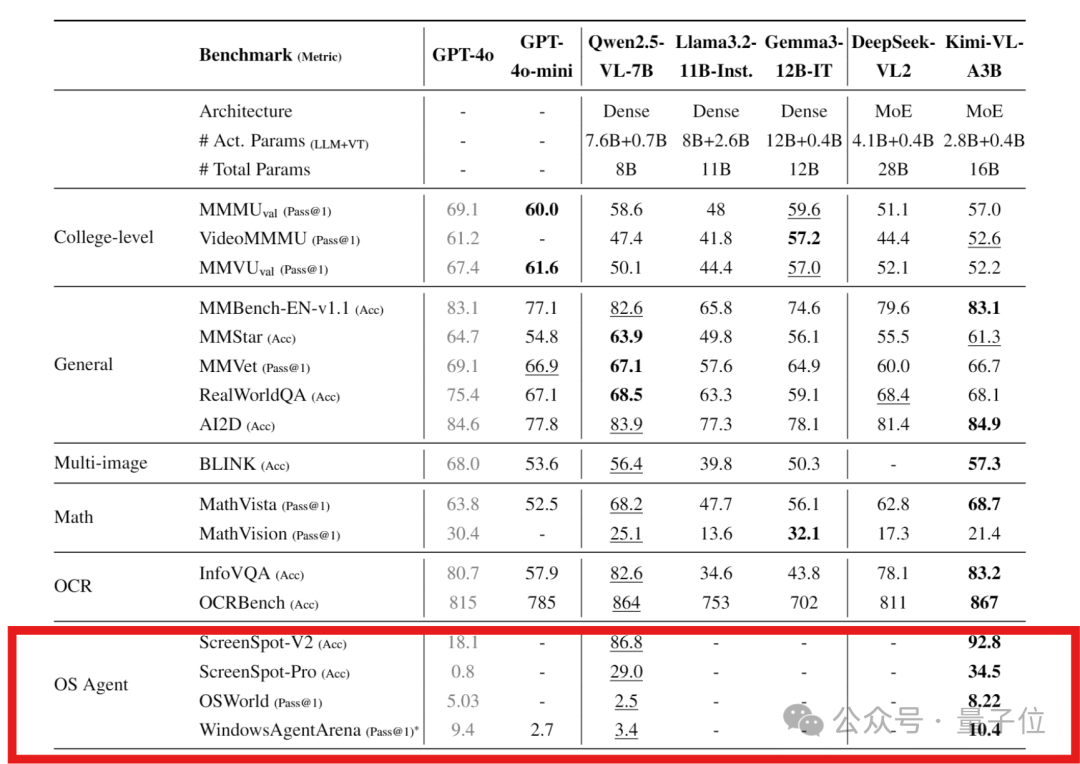

如图所示,和Qwen2.5-VL、Gemma-3等前沿开源VLM相比,Kimi-VL-Thinking仅使用2.8B激活参数即可实现强大的多模态推理。

同时在一些重要基准测试中,Kimi新模型“以小博大”,超越了GPT-4o等规模更大的模型。

目前两款模型均已上架Hugging Face,分为Instruct基础版和Thinking推理版。

网友们纷纷表示,新的标杆再次诞生!

多模态和推理双双拿捏

话不多说,我们直接看Kimi新模型的具体玩法和效果。

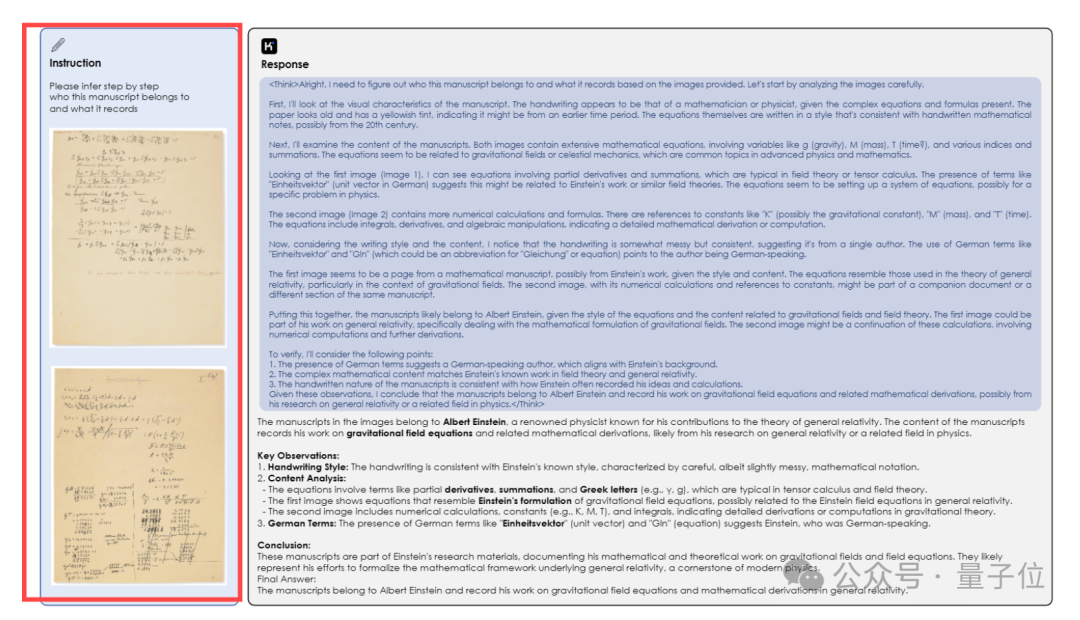

视觉理解与推理

首先,作为一款通用的VLM模型,Kimi-VL具备强大的视觉理解和推理能力。

给它一份手稿,要求它通过逐步推理来确认手稿属于谁,以及所记录的内容。

可以看到,Kimi-VL通过分析手稿的笔迹、内容、语言等特征,推断出手稿可能属于爱因斯坦,理由是这些内容与引力场方程有关,这与爱因斯坦对广义相对论的贡献有关。

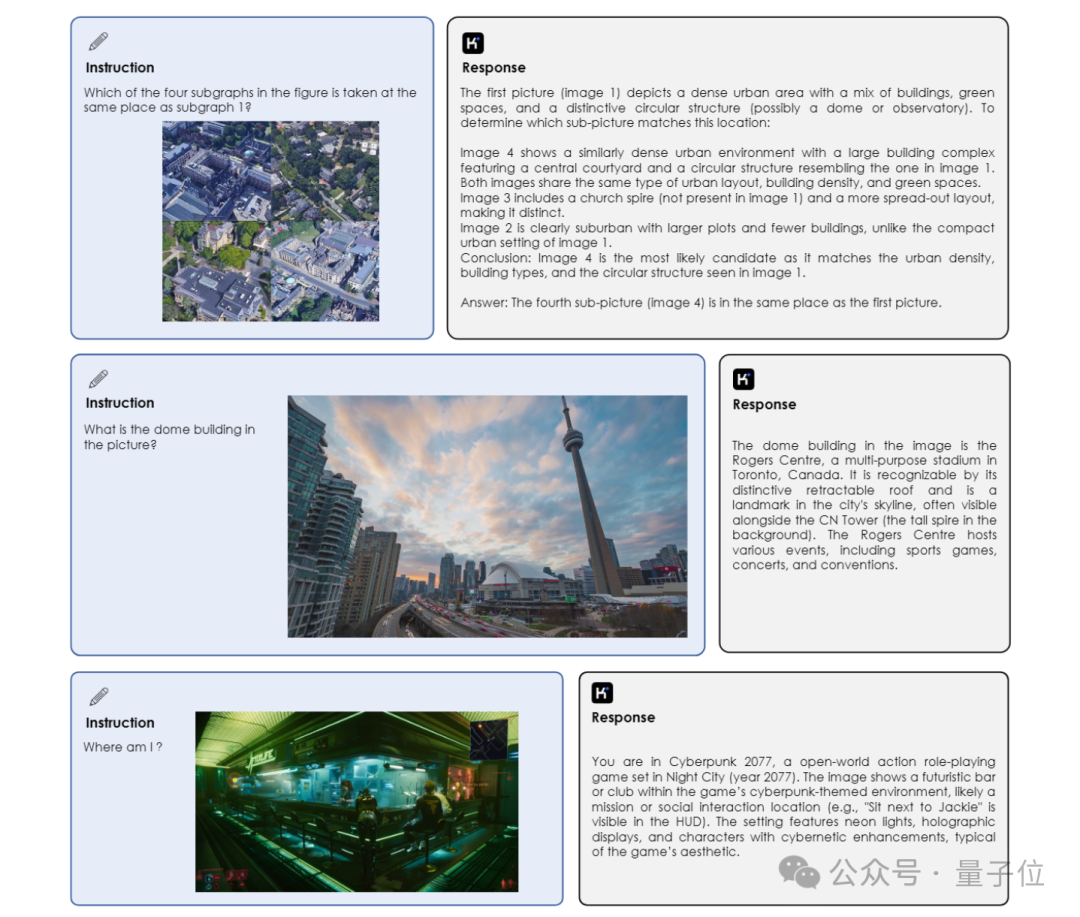

又或者只提供一张图片,让Kimi-VL来判断城市地标建筑、识别游戏场景等。

比如第2个例子中,它成功识别出图片中的穹顶建筑为多伦多的罗杰斯中心(Rogers Centre),同时描述了其特征和用途。

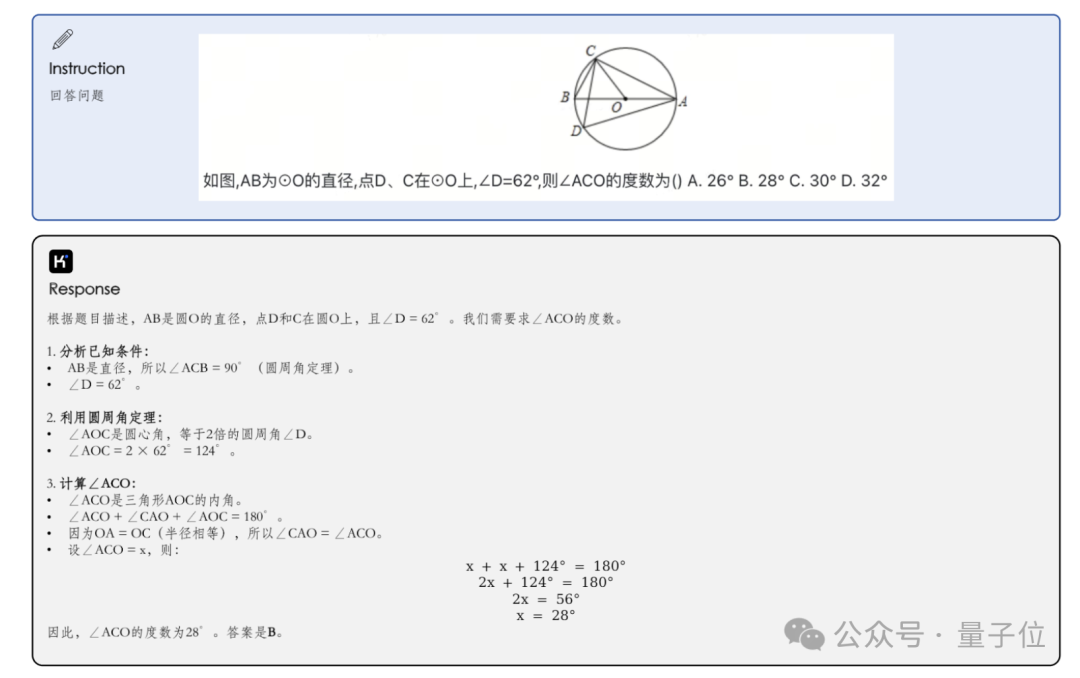

除此之外,Kimi-VL也能被用来解答高难度几何数学题。

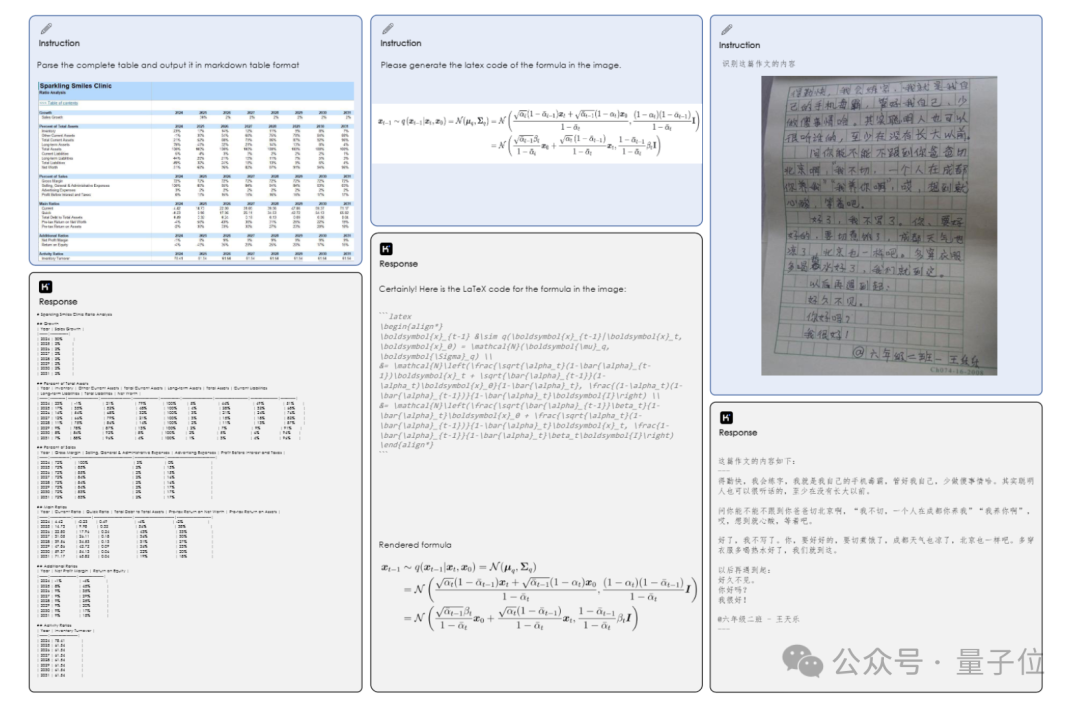

还是仅需一个上传图片的动作,它就能将复杂数学公式转换为LaTeX代码,并以正确格式输出。

OCR与文本处理

当然,Kimi-VL对多模态数据的正确理解还离不开一项关键能力——OCR字符识别。

在OCRBench基准测试中,其得分为867,属于SOTA水平。

除了识别数学公式,它还能识别金融表格(以Markdown表格格式输出)和手写作文。

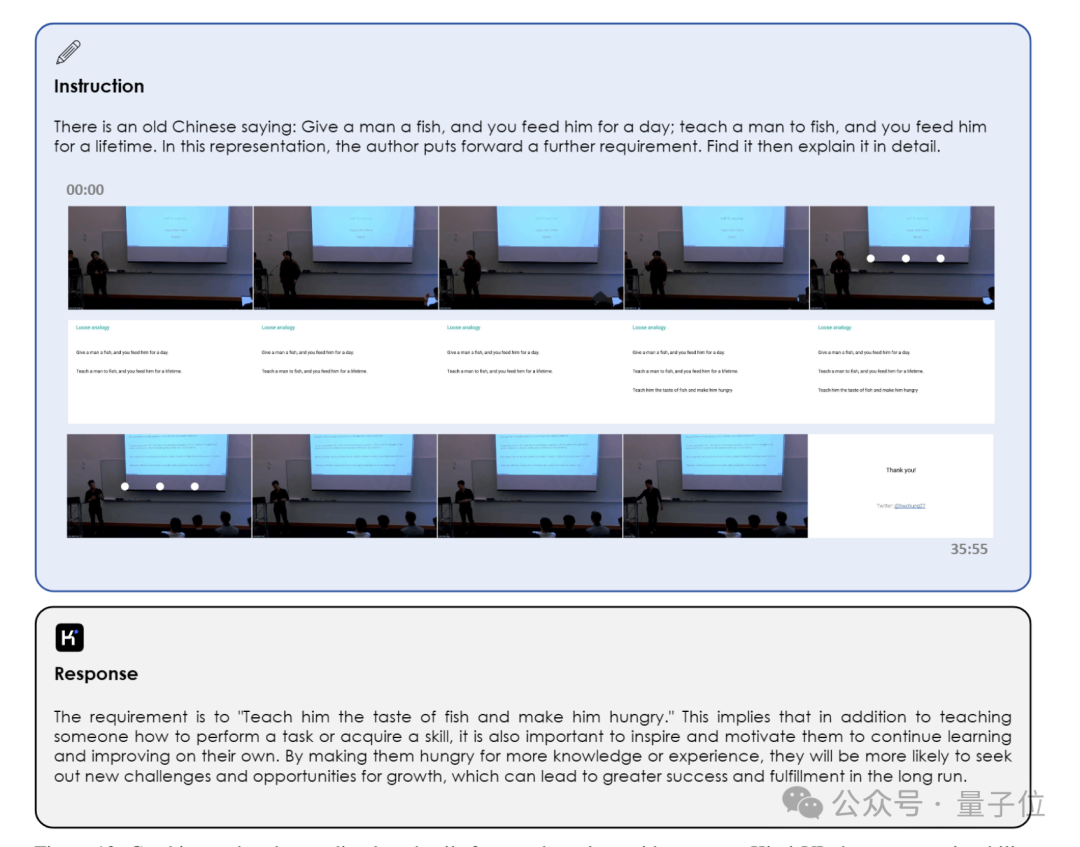

甚至还能从长达一小时的视频课程中捕捉和理解关键细节。

比如提供视频中的某句话“授人以鱼不如授人以渔”,要求它找到出处并进一步解读。

智能体任务与交互

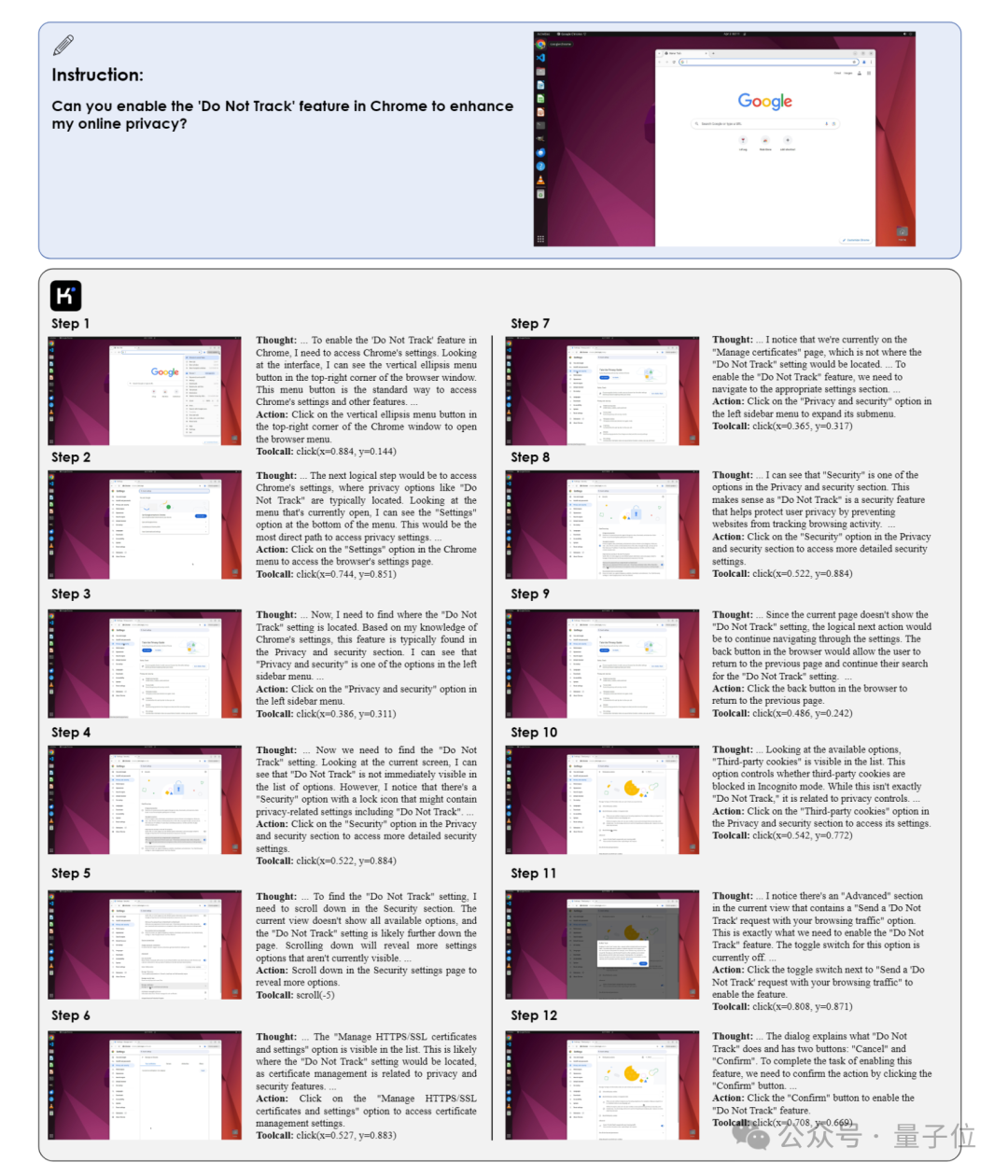

值得关注的是,Kimi-VL还在多轮Agent交互任务(例如OSWorld)中表现出色,取得了媲美旗舰模型的SOTA结果。

比如在Chrome浏览器中,要求它自动启用“Do Not Track”功能来保护用户隐私。

可以看到,通过一步步思考,Kimi-VL对每个屏幕进行解读,识别相关的用户界面元素,并通过清晰的思路、操作和API调用按顺序执行相应的操作。

背后技术原理

那么接下来的问题是,怎么做到的?

来看Kimi此次公开的技术报告。

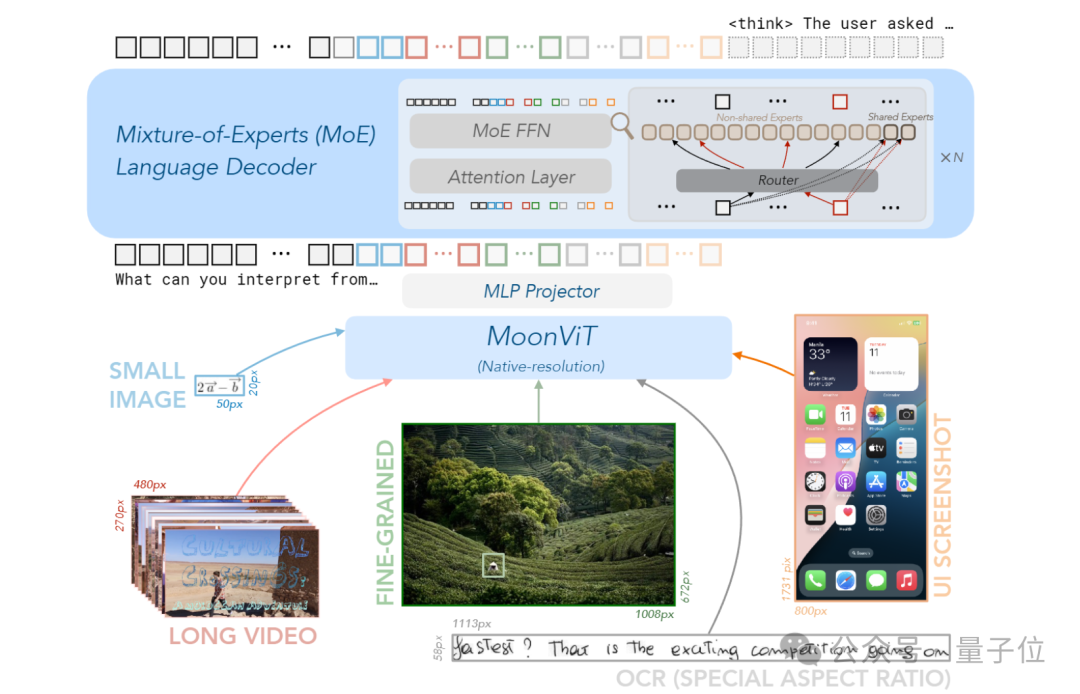

首先,在模型架构上,Kimi-VL和Kimi-VL-Thinking主要由三大部分构成:

模型具体训练过程如下:

数据准备

这第一步,团队构建了三大类别数据集:

1、预训练数据。精选来自六个类别的高质量数据,包括字幕数据、图像文本交织数据、OCR数据、知识数据、视频数据和智能体数据。通过过滤、合成和去重等操作,控制数据质量。

2、指令数据。用于增强模型的对话和指令遵循能力。对于非推理任务,通过人工标注构建种子数据集,训练种子模型后生成并筛选多轮响应;对于推理任务,利用拒绝采样的方式扩展数据集,确保数据多样性和准确性。

3、推理数据。通过类似拒绝采样和提示工程的方法,收集和合成高质量的长思维链数据。

预训练:主要提升多模态能力

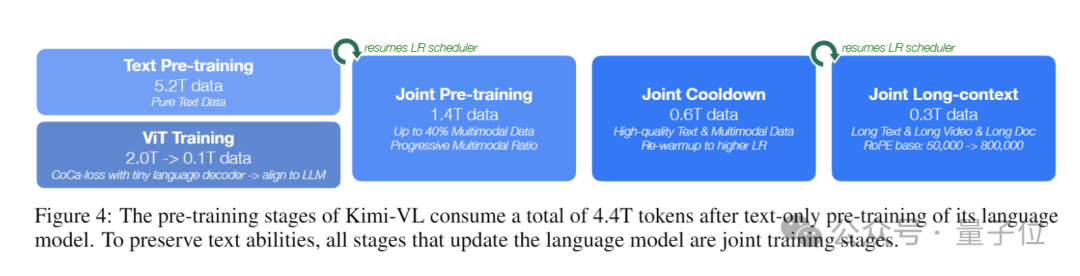

然后开始预训练,这一阶段共消耗4.4T tokens,主要目标是提高模型的多模态理解能力。

概括而言,这一过程包含4个步骤:先独立进行ViT训练,以建立原生分辨率视觉编码器;随后进行三个联合训练阶段(预训练、冷却、长上下文激活)。

后训练:主要提升长思维链推理能力

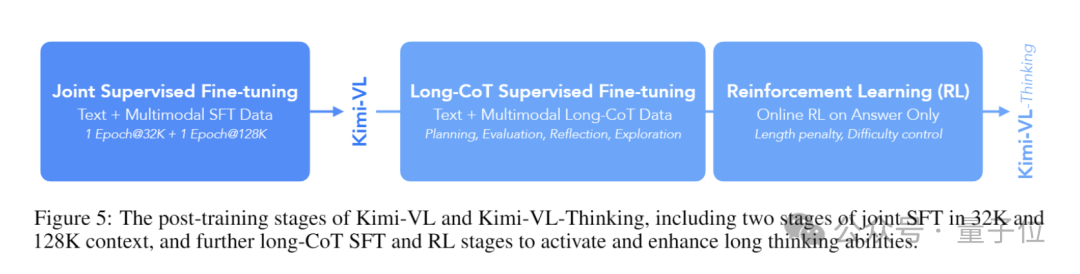

接着进行后训练,通过在32K和128K上下文中进行的两个阶段的联合监督微调、长思维链监督微调及强化学习,团队进一步提升了模型的长期思考能力。

更多细节感兴趣可以查阅原论文。

One More Thing

有一说一,相比于DeepSeek、Qwen等国内竞争对手,Kimi最近一个月实在有点过于安静了。

从官方公众号来看,最新一条发布还是在2月份。

在这股平静之下,网友们开始猜测:

Kimi即将有大动作了?

结合更多消息,目前大家比较认可的推测是K1.6模型即将到来。

就在3月,基于Kimi-K1.6的数学模型突然曝光,在编程基准测试LiveCodeBench中拿下第一,超越o3、DeepSeek-R1等模型。

当然,也欢迎更多知情者在评论区爆料(doge)。

论文:

https://github.com/MoonshotAI/Kimi-VL/blob/main/Kimi-VL.pdf

模型开源地址:

https://huggingface.co/collections/moonshotai/kimi-vl-a3b-67f67b6ac91d3b03d382dd85

参考链接:

[1]https://x.com/Kimi_Moonshot/status/1910035354570371082

[2]https://x.com/iamfakhrealam/status/1909559812498886813

一键三连「点赞」「转发」「小心心」

欢迎在评论区留下你的想法!

— 完 —

不到一周!中国AIGC产业峰会观众正在火热报名中 🙋♀️

全部嘉宾已就位 🔥 百度、华为、AWS、MSRA、无问芯穹、数势科技、面壁智能、生数科技等十数位AI领域创变者将齐聚峰会,让更多人用上AI、用好AI,与AI一同加速成长~

4月16日周三,就在北京,一起来深度求索AI怎么用 🙌 点击报名参会

🌟 一键星标 🌟

科技前沿进展每日见

内容中包含的图片若涉及版权问题,请及时与我们联系删除