加拿大AI新創Cohere周四(3/13)發表了新一代AI模型Command A,只需要兩個A100或H100的Nvidia GPU就可部署,宣稱該模型在代理企業任務上的表現與GPT-4o及DeepSeek-V3相當,能夠以最少的硬體提供最大的性能。

Cohere是在2019年由Aidan Gomez、Ivan Zhang及Nick Frosst共同創辦,其中,Gomez曾在2017年於Google實習,也是該年出爐的《Attention Is All You Need》論文的8位共同作者之一,該論文被視為是機器學習領域的里程碑,它介紹了新一代的機器學習架構Transformer,也預見了Transformer被應用在問答及多模態生成AI的潛力,之後Transformer亦成為基於GPT等大型語言模型的主要架構。

Cohere表示,Command A是專為要求嚴格的企業環境所設計,它支援256k的脈絡長度與23種語言,且只需要兩個GPU即可部署,其它競爭模型最多需要32個GPU。

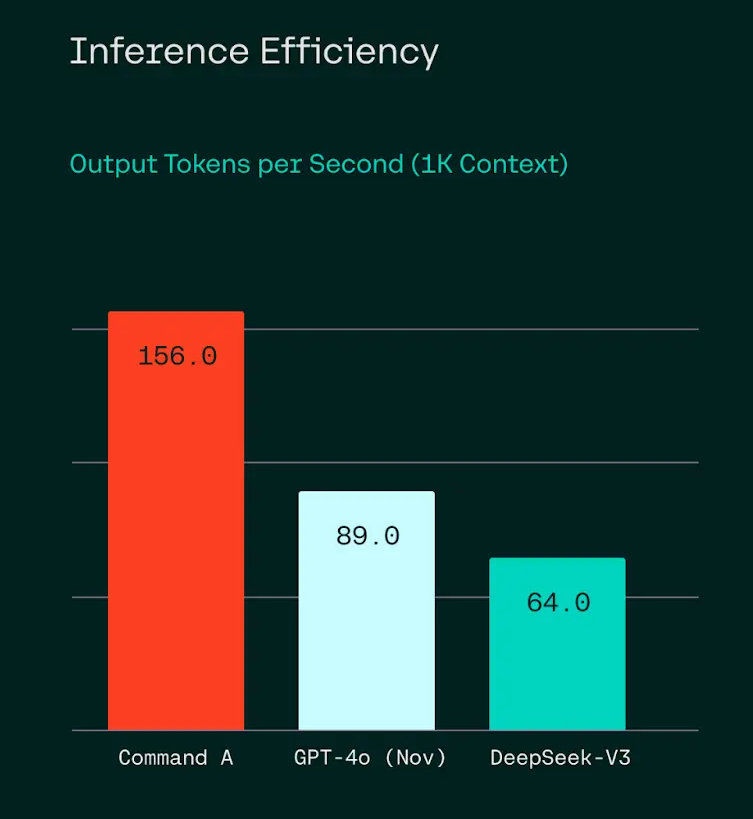

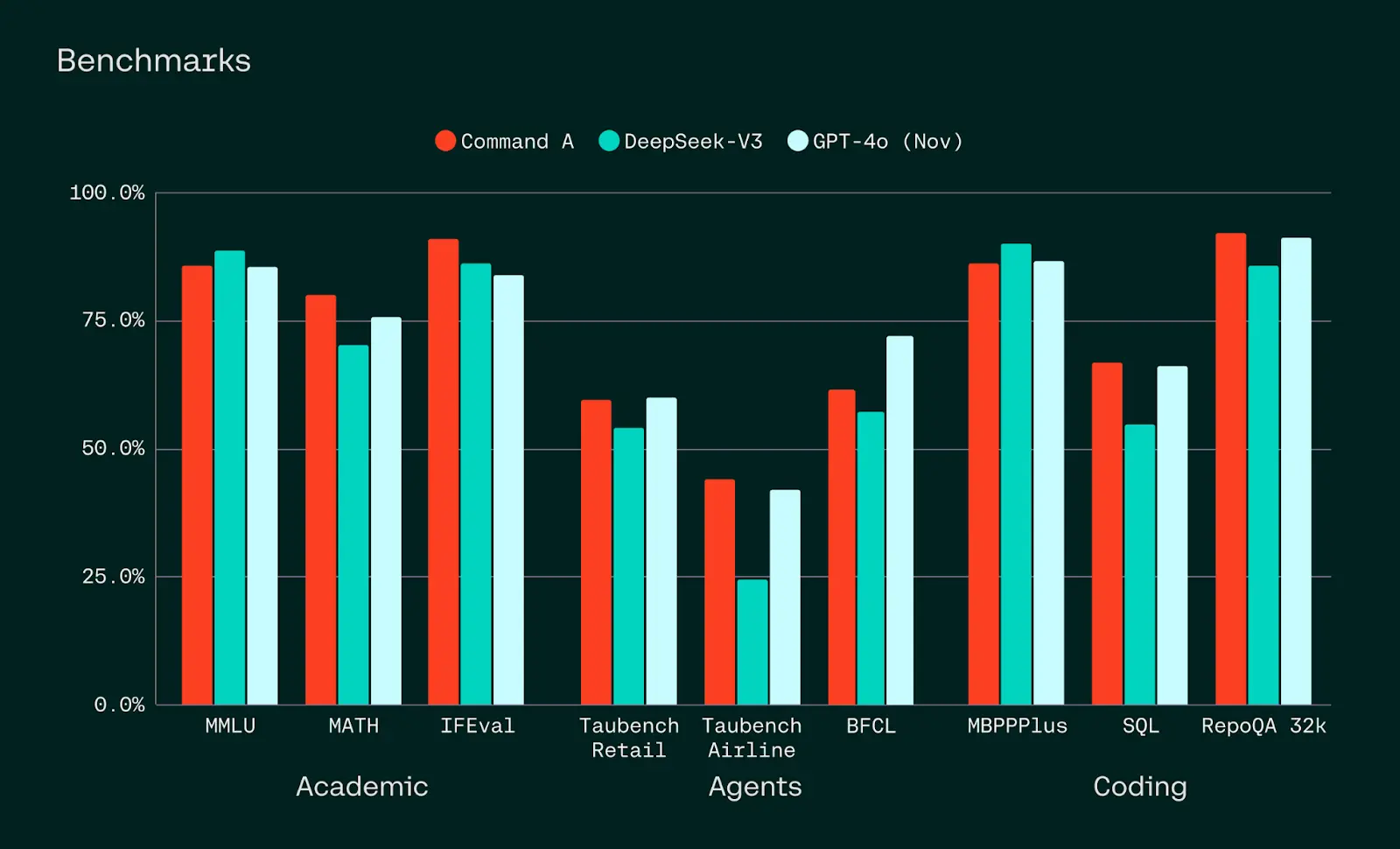

另一方面,在效能測試中,Command A最快每秒可輸出156個Token,比GPT-4o快1.75倍,比DeepSeek-V3快2.4倍,除了硬體優勢及輸出速度外,Command A在指令追蹤、SQL、代理程式及工具任務的基準測試中也有出色的表現。

圖片來源_Cohere

Cohere指出,不切實際的大型模型可能導致嚴重的延遲,若是只想快速獲得正確答案,Command A將是最佳選擇,而且相較於基於API的存取服務,Command A的私有部署最多可節省50%的成本。

目前Cohere平臺已釋出Command A,也透過Hugging Face開放給學術使用,亦即將登上其它雲端供應商,有意私有部署的企業則可直接聯繫其銷售團隊。

在Hugging Face於2024年6月公布的開源大型語言模型(LLM)排行榜上,當時Cohere所開發的Command R+還占據排行榜第5名,但最新的資料顯示,它已掉到700名外,彰顯出AI模型市場的激烈競爭態勢。