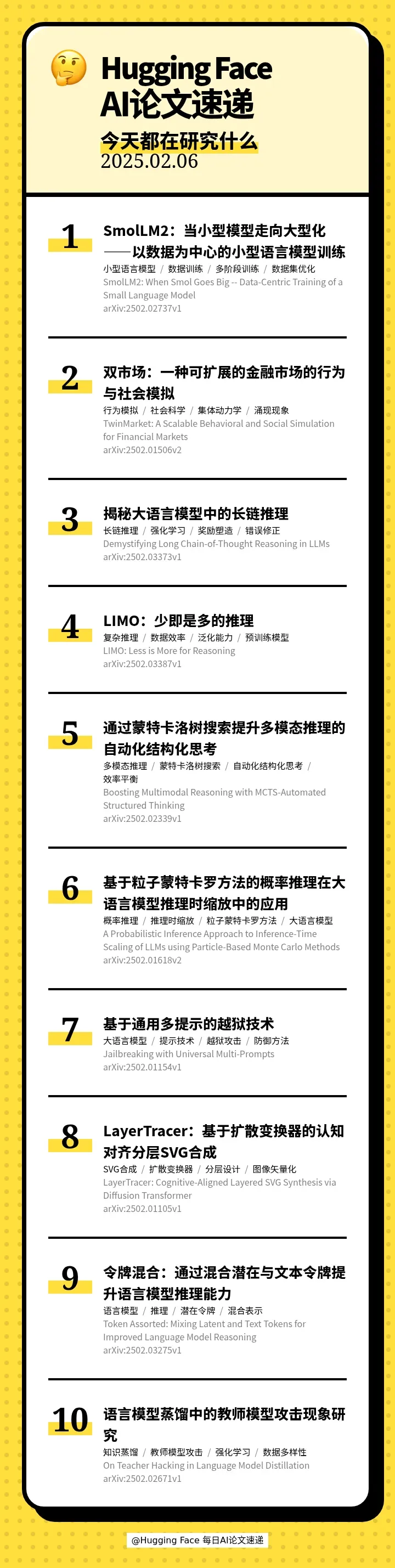

本期的 10 篇论文如下:

[00:26] ? SmolLM2: When Smol Goes Big -- Data-Centric Training of a Small Language Model(SmolLM2:当小型模型走向大型化——以数据为中心的小型语言模型训练)

[01:08] ? TwinMarket: A Scalable Behavioral and Social Simulation for Financial Markets(双市场:一种可扩展的金融市场的行为与社会模拟)

[01:45] ? Demystifying Long Chain-of-Thought Reasoning in LLMs(揭秘大语言模型中的长链推理)

[02:23] ? LIMO: Less is More for Reasoning(LIMO:少即是多的推理)

[03:15] ? Boosting Multimodal Reasoning with MCTS-Automated Structured Thinking(通过蒙特卡洛树搜索提升多模态推理的自动化结构化思考)

[04:04] ? A Probabilistic Inference Approach to Inference-Time Scaling of LLMs using Particle-Based Monte Carlo Methods(基于粒子蒙特卡罗方法的概率推理在大语言模型推理时缩放中的应用)

[04:47] ? Jailbreaking with Universal Multi-Prompts(基于通用多提示的越狱技术)

[05:25] ? LayerTracer: Cognitive-Aligned Layered SVG Synthesis via Diffusion Transformer(LayerTracer:基于扩散变换器的认知对齐分层SVG合成)

[06:27] ? Token Assorted: Mixing Latent and Text Tokens for Improved Language Model Reasoning(令牌混合:通过混合潜在与文本令牌提升语言模型推理能力)

[07:09] ? On Teacher Hacking in Language Model Distillation(语言模型蒸馏中的教师模型攻击现象研究)

【关注我们】

您还可以在以下平台找到我们,获得播客内容以外更多信息

小红书: AI速递