OpenAI通过API向在OpenAI消费至少1000美元的开发者推出正式版o1,替代API中已有的o1预览版,o1拥有视觉输入推理能力等新功能,使用的推理token比预览版平均少 60%,但收费较高,每分析约75万个单词收费15 美元,相当于GPT-4o收费的三到四倍;OpenAI同时更新Realtime API,新API支持WebRTC,纳入收费更低的新版GPT-4o和4o mini模型,GPT-4o音频定价降低了60%。

在为期12个工作日的线上新品和新技术发布活动中,OpenAI的王炸又来了一波:将OpenAI的最强推理模型o1向开发者开放,用于开发语音类App的API中纳入了收费更低的先进模型GPT-4o版本。

美东时间12月17日周二进行的第九日线上分享中,OpenAI宣布,从周二开始,通过应用程序编程接口(API)向第三方开发者推出o1。但OpenAI并非向所有开发者敞开使用o1,而是以“第五层”使用类别的形式提供,要获得第五层的使用资格,开发者必须在OpenAI的产品上花费至少1000 美元,并且拥有的账户自首次成功付款以来已使用超过30天。

虽然OpenAI只是向部分开发者推出了o1,但此举已经标志着开发者在AI领域的最新进步,他们将有机会打造新的高级 AI 应用程序App,或者将最先进的 OpenAI 技术集成到他们现有的App和工作流程中,无论是面向企业还是面向消费者。

今年9月,OpenAI 发布了o1的预览版o1 preview,称o1是第一个具备真正通用推理能力的大模型,它的核心能力推理在测试化学、物理和生物学专业知识的基准GPQA-diamond上得到了充分体现。

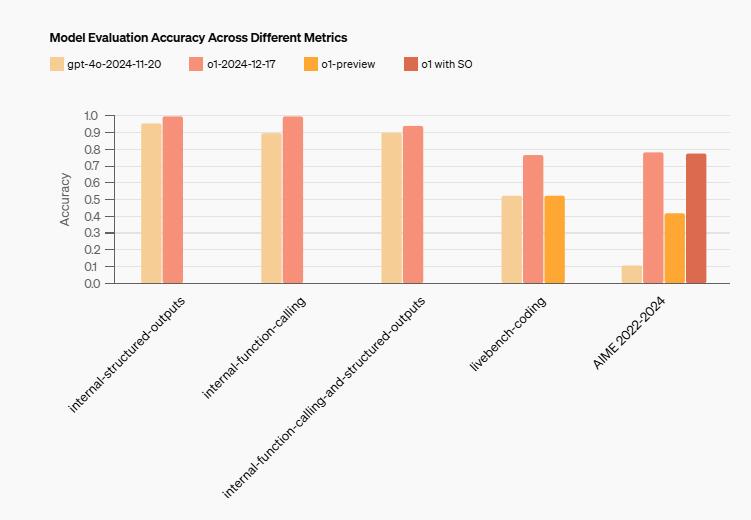

据OpenAI的评估,o1在该测试中全面超过了人类博士专家,准确率达到78.3%,而人类专家的得分为69.7%。OpenAI称,“通用人工智能(AGI)之路,已经没有任何阻碍”。此外,o1在多个高难度的推理基准测试中表现优异,例如在美国数学邀请赛(AIME)中,o1的正确率达到了83.3%,远超其前身GPT-4o的表现。

本月5日,OpenAI在预告的连续12日王炸发布活动首日就推出了正式版的o1,所谓满血o1,它被纳入ChatGPT Plus套餐。正式版o1支持多模态输入,具备视觉推理能力。相比o1 preview版本,正式版o1的平均响应速度快了60%,OpenAI还发现正式版o1在推理时犯重大错误的频率比o1 preview减少34%。

在包括编码、数学和视觉推理任务在内的一系列基准测试中,正式版o1都相比预览版取得了明显进步。例如在SWE-bench Verified基准的编码测试中,o1的评分从o1 preview的41.3 提高到 48.9,而以数学为重点的 AIME 测试中的评分甚至从 42 跃升至 79.2。

O1的新功能为开发者提供更多帮助。比如结构性输出Structured Outputs功能让响应可靠地匹配自定义格式,如JSON模式,从而确保与外部系统交互时的一致性;函数调用Function calling功能简化了将 o1 连接到 API 和数据库的过程;对视觉输入进行推理的能力Vison capabilities发掘了制造、科学和编码方面用例的前景。

开发人员还可以使用新的reasoning_effort参数微调o1的行为,该参数控制模型在任务上花费的时间,以此平衡性能和响应时间。

本周二推出的API中,正式版o1替代了API中已有的o1 preview版本。因为需要大量计算资源才能运行o1,OpenAI对o1 API的收费也较高,o1每分析约75万个单词收取 15 美元,模型每生成约75万个单词收取60 美元,相当于OpenAI最新非推理模型GPT-4o收费的三到四倍。

同时,o1的延迟更低,对于给定的请求,o1使用的推理token比 o1-preview 平均少 60%。

更新Realtime API,纳入收费更低的新版GPT-4o和4o mini模型,支持WebRTC

本周二OpenAI还更新了支持语音助手、实时翻译工具等低延迟自然对话体验的Realtime API。Realtime API目前还处于测试阶段,用于打造低延迟的AI 生成语音响应的App,此次更新中包括GPT-4o 和 GPT-4o mini模型各自的新版本,新版本的数据效率更高、可靠性提高,用起来也更便宜。

更新后Realtime API拥有一些新功能,比如并发带外响应,它可以让内容审核等后台任务在不中断交互的情况下运行。该API现在还支持 WebRTC,它是为基于浏览器的客户端、智能手机和物联网设备构建实时语音应用程序的开放标准。

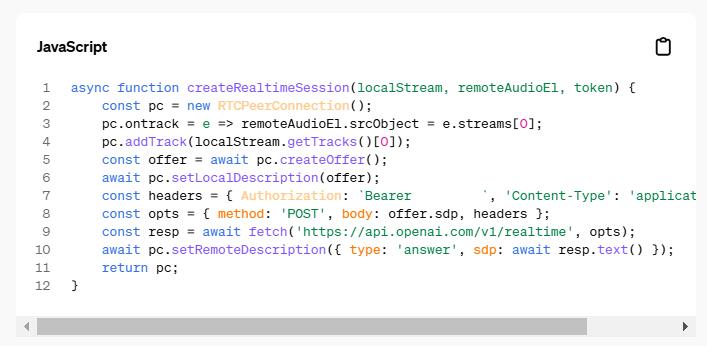

在Realtime API中结合WebRTC意味着,API可以直接支持音频流、噪声抑制和拥塞控制,从而简化打造基于语音的App。开发者现在可以以最少的设置集成实时功能,即使在多变的网络条件下也是如此。借助WebRTC,开发者现在只需几行 Javascript代码即可添加Realtime功能。

OpenAI同时降低了Realtime API的收费,将GPT-4o音频的定价降低了60%,降至每 100 万个输入token收费40 美元,每 100 万个输出token收费80 美元。

缓存音频输入定价降低了87.5%,现在定价为每100 万个输入token收费2.50 美元。OpenAI将要添加的更小模型 GPT-4o mini定价更便宜,每 100 万个输入token收费10 美元,每 100 万个输出token收费20 美元。

GPT-4o mini 的文本token费率也大幅下调,输入token起步价0.60 美元,输出token起步价2.40 美元。