index_new5.html

../../../zaker_core/zaker_tpl_static/wap/tpl_guoji1.html

![]()

近年来,人工智能领域追求更深更大规模的神经网络模型,但面临着算力和理解网络行为的挑战。Nature Computational Science上的一项研究提出,通过赋予单个神经元更丰富的属性,构建具有内部复杂性的小模型,可以等效于外部复杂性的大模型。研究人员利用时变电导LIF神经元构建了子网络,证明了内部复杂性可以弥补模型拓扑结构的简单性,同时提高计算效率。这项研究为解决大模型瓶颈问题提供了新思路,探索了计算神经科学与人工智能的交叉点,并为构建更有效的人工智能模型提供了借鉴。

🤔 **内部复杂性与外部复杂性等效:**研究通过构建具有内部复杂性的小模型,发现其可以等效于外部复杂性高的大模型,从而降低计算成本和提升模型可解释性。例如,研究者利用时变电导LIF神经元构建了子网络,证明了内部复杂性可以补偿模型拓扑结构的简单性。

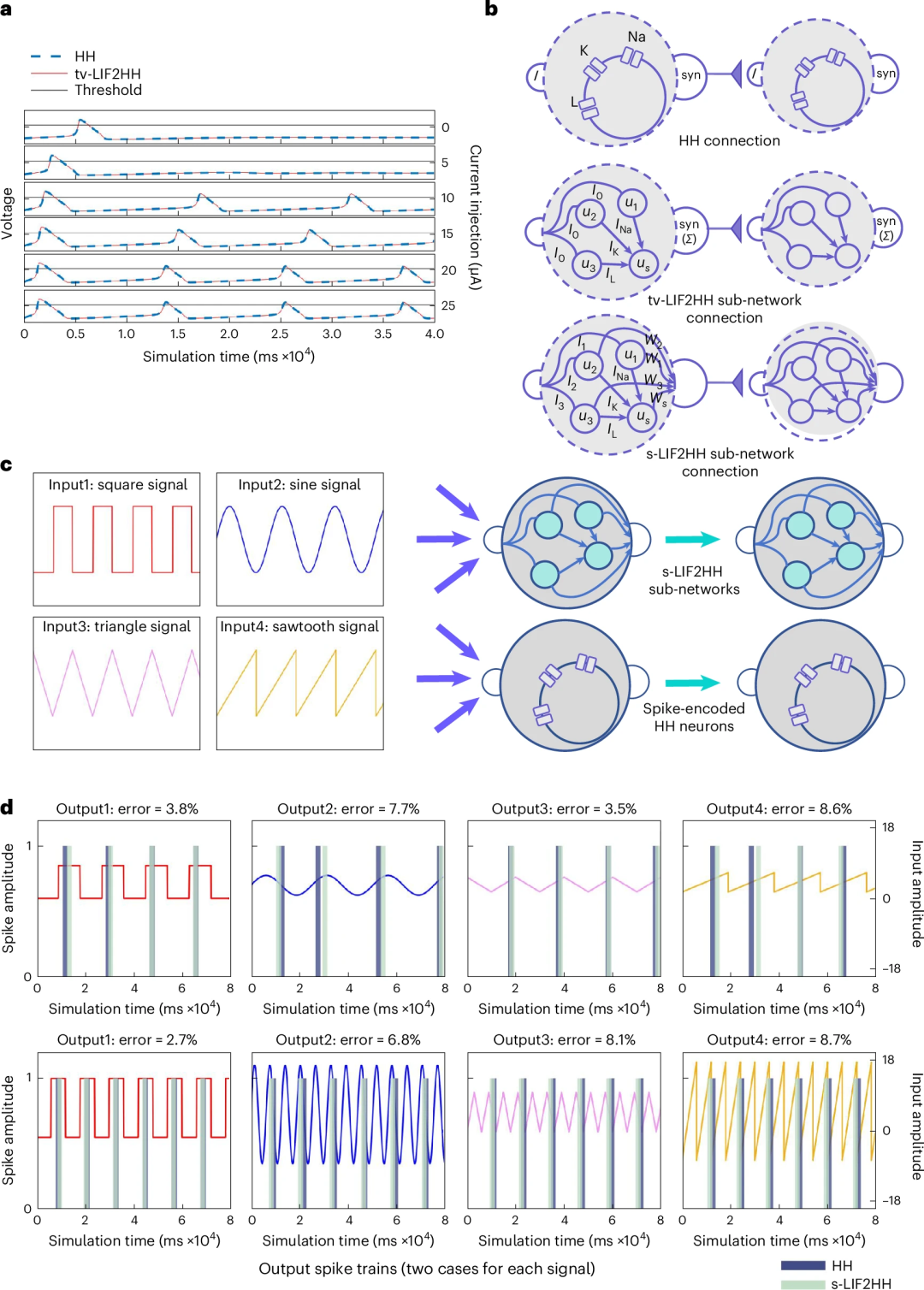

💡 **神经元模型的等价性:**研究推导出内部复杂度较低的LIF2HH模型和内部复杂度较高的HH模型在激发特性上的等价性,并通过一系列近似方法构建了简化后的s-LIF2HH网络,证明了两种模型在不同波形下的发放模式非常相似,放电时间误差低于10%。

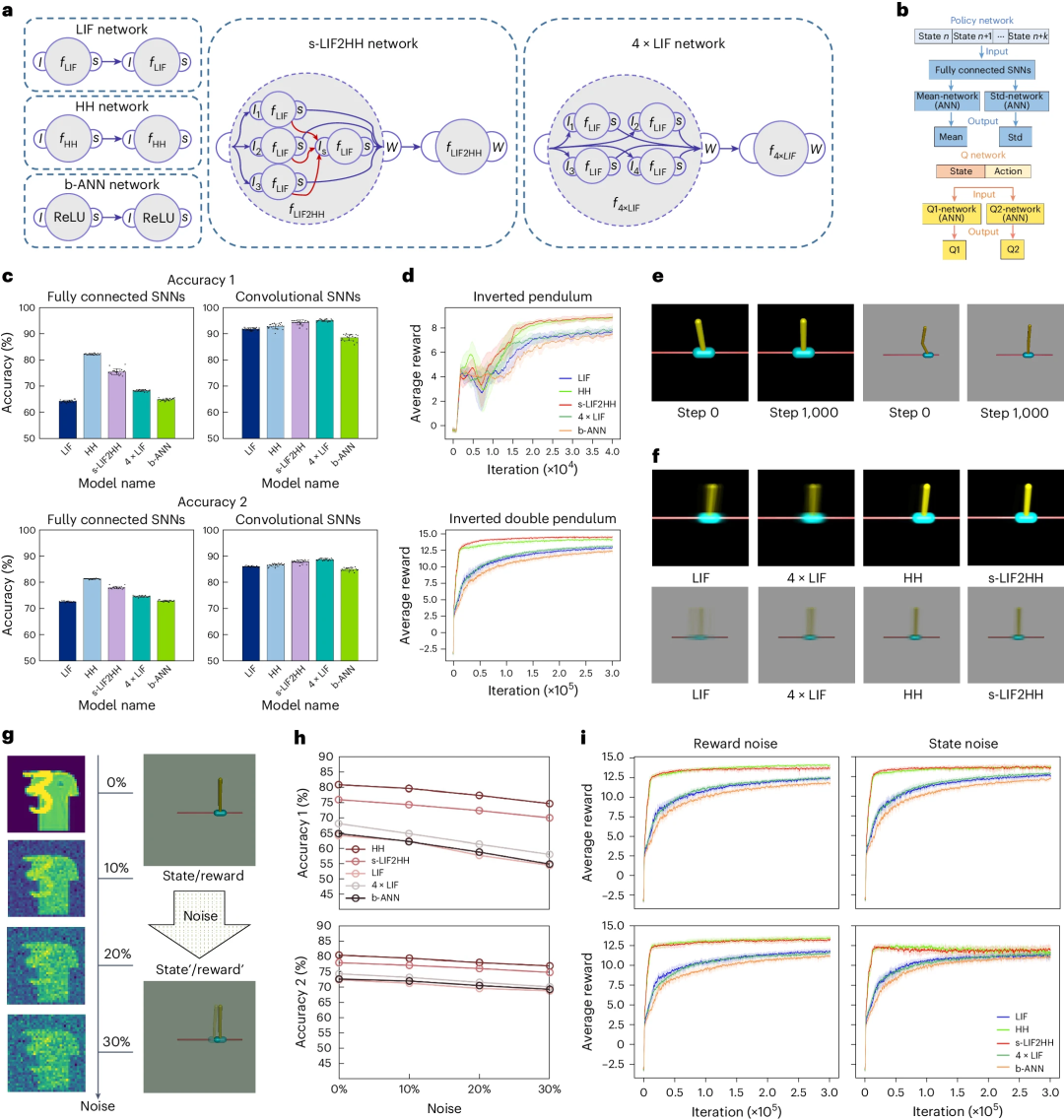

🚀 **模型复杂性与信息处理能力:**研究发现,具有更复杂神经元动态的HH模型和具有复杂拓扑结构的s-LIF2HH网络在深度学习任务中都具有较强的空间和时间信息提取能力,并且具有相似的噪声鲁棒性。这表明,模型的内部和外部复杂性可以相互转化,提升模型的信息处理能力。

📊 **计算效率的提升:**相比于HH网络,s-LIF2HH网络在深度学习任务中展现出更高的计算效率,表明将外部复杂性转换为内部复杂性可以提升深度学习模型的效率。

论文题目:Network model with internal complexity bridges artificial intelligence and neuroscience

论文地址:https://www.nature.com/articles/s43588-024-00674-9

期刊名称:Nature Computational Science

当今人工智能研究人员普遍认为,通用人工智能的构建需要依靠更深、更大规模和更泛化的神经网络模型。然而,这种外部复杂性高的大模型瓶颈也是显而易见:消耗过多算力,理解网络中神经元的行为十分困难。近期发表在Nature Computational Science 的一项研究,通过给单个神经元添加丰富的属性,构建了一种具有神经元内部复杂性的小模型,可与外部复杂性的大模型等效。

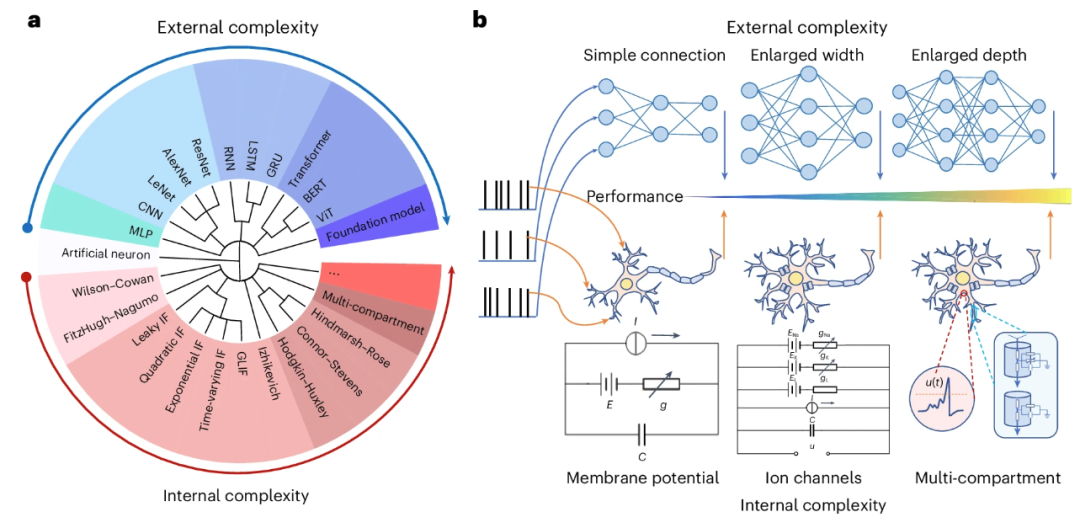

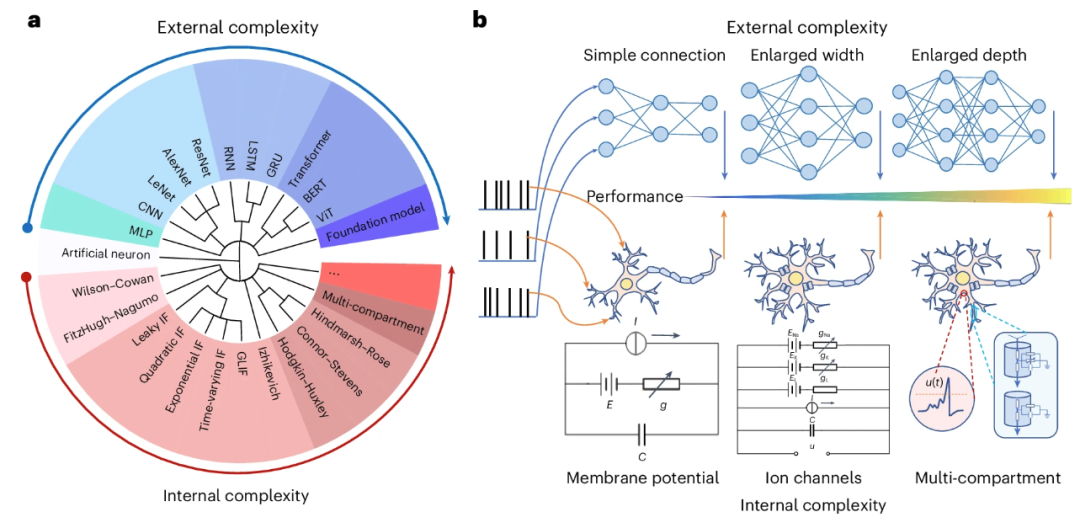

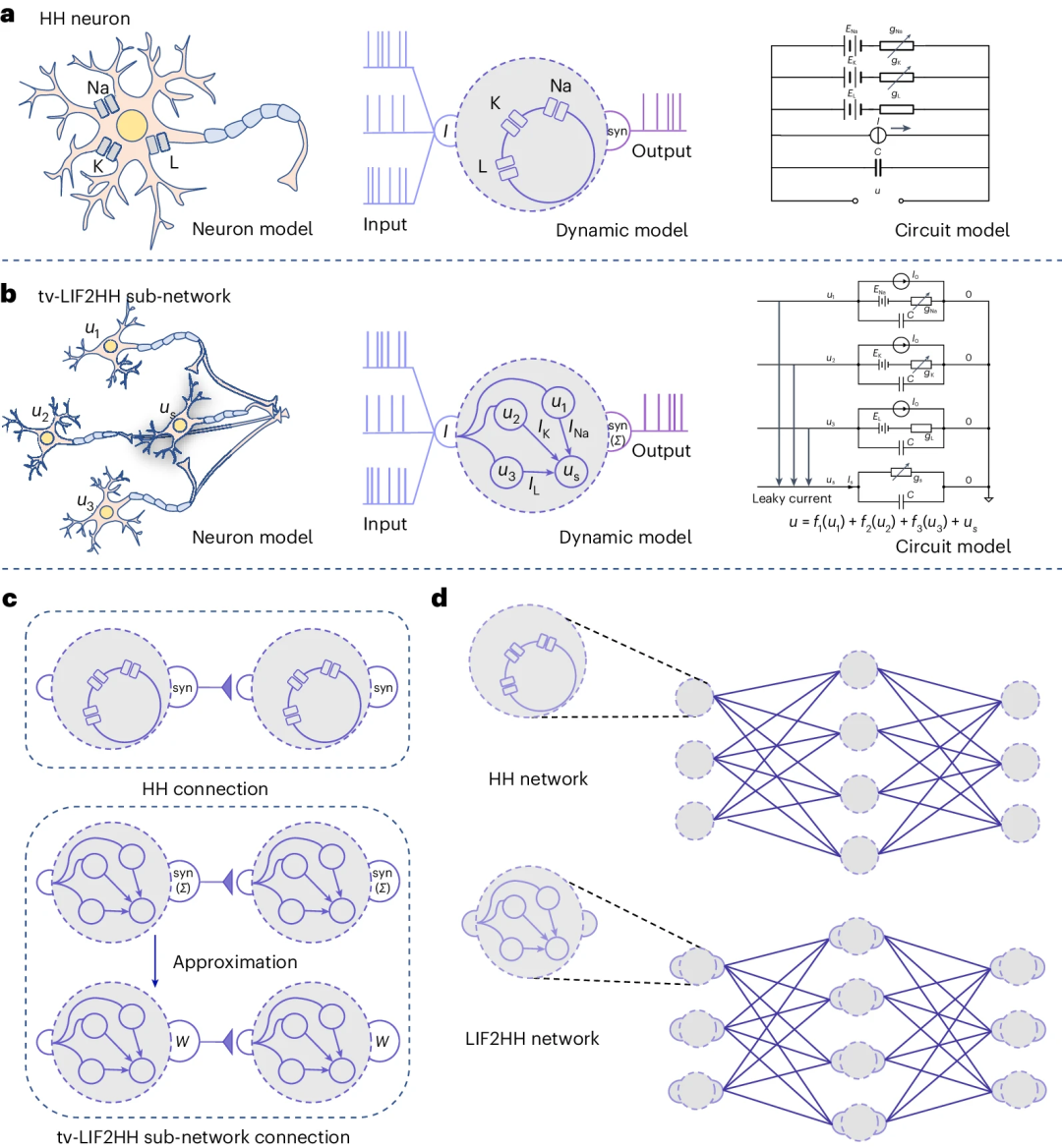

研究者认为通过找到计算神经科学与人工智能的交叉点,模仿大脑皮层并利用丰富的时空动态,可以帮助解决现有大模型的瓶颈问题。本研究中引入了由4个具有时变电导的LIF神经元组成的子网络结构 tv-LIF2HH。首先,在理论上推导出内部复杂度较低的 LIF2HH 模型和内部复杂度较高的 HH 模型,二者在激发特性上等价。而后在实验中,为解决实际训练中的复杂性问题,研究者使用了一系列近似简化的方法,包括近似发放函数,在网络中使用直接连接,固定神经元电导等(图2c),构建得到s-LIF2HH网络。结果显示,两种神经元模型对不同波形的发放模式都非常相似,放电时间之间的相对误差均低于10%。

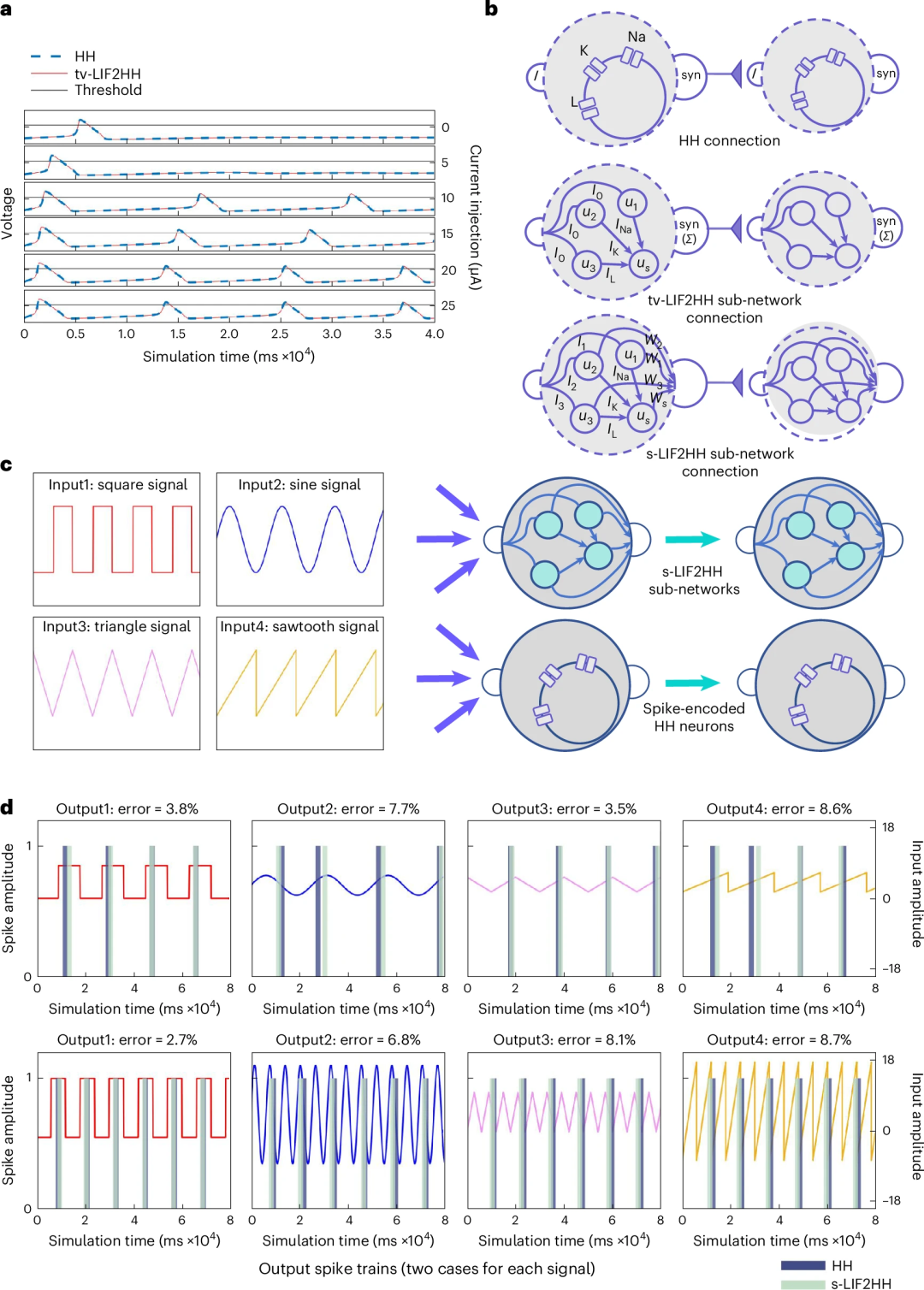

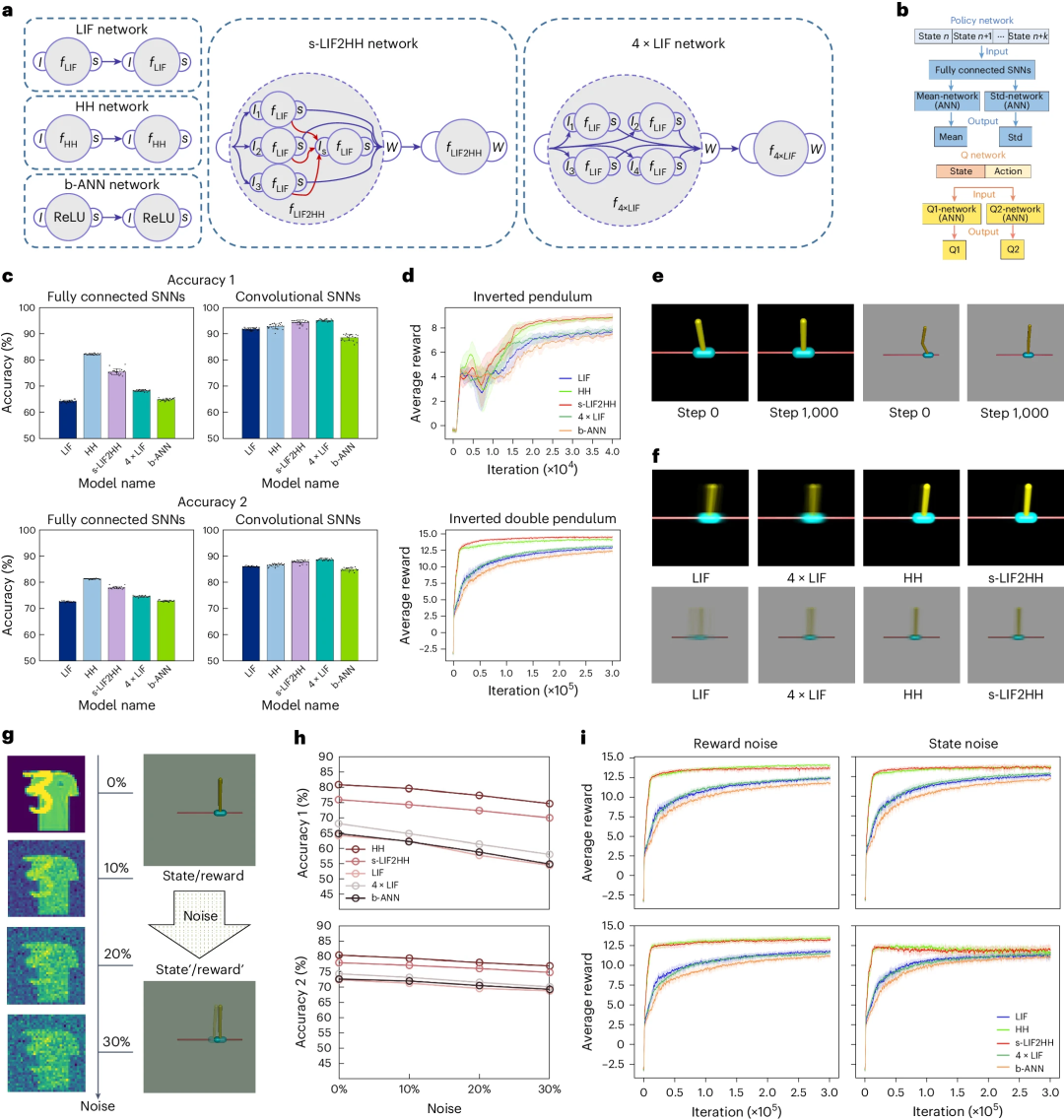

在深度学习任务中,研究者发现HH和s-LIF2HH网络结构都具有较强的空间和时间信息提取能力,单个HH神经元信息处理能力的增强补偿了其简单的拓扑结构;HH和s-LIF2HH网络具有相似的噪声鲁棒性,鲁棒性来源于HH神经元的动态复杂性和s-LIF2HH的复杂拓扑结构,而不仅仅是神经元数量。这支持了模型内部和外部复杂性之间的可比性,以及在深度学习任务中,超越了神经元动态模式简单但规模大的模型。此外,与s-LIF2HH网络相比,HH网络提供了可观的计算效率,表明将外部复杂性转换为内部复杂性提高了深度学习模型的效率。

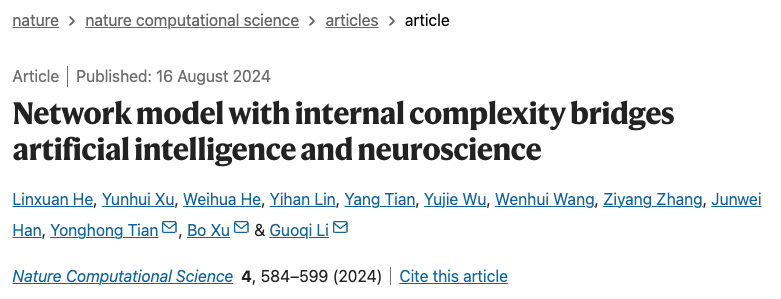

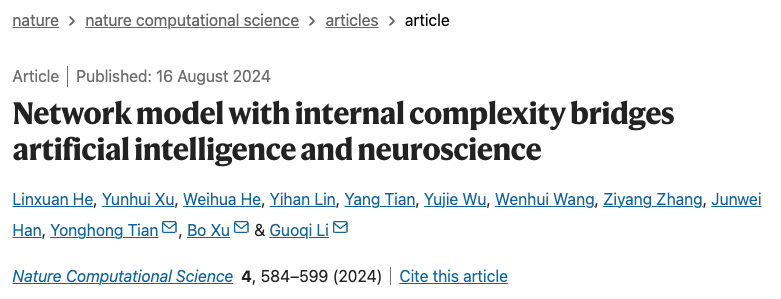

图 1. (a) 神经元仿真模型和神经元网络结构分别对应不同水平的复杂度。具有非常精细和丰富动力学描述的神经元仿真模型对应更高内部复杂度,具有更深和更广泛连接的网络对应更高外部复杂度。(b) 模型的表征能力与其总复杂性有关,总复杂性包括内部复杂性和外部复杂性。

图 2. (a) HH神经元结构及相关电路图。(b) 等价于HH神经元的tv-LIF2HH子网络结构及相关电路图,每个tv-LIF神经元电位的非线性效应之和等于相同尖峰输入下的HH神经元电位。(c) 连接之间的等效性,tv-LIF2HH模型包括近似操作。(d) 由HH神经元与tv-LIF2HH子网络的等效连接组成的神经网络。LIF2HH网络中的每条线代表了从前一子网络中的四个LIF神经元到整个后一子网络的四个不同连接。

图 3. (a) 相同电流输入,单个HH模型和tv-LIF2HH子网络的电位输出。(b) 按网络中采用的模型分类的三种连接:HH、tv-LIF2HH子网络和s-LIF2HH子网络连接。(c) 将二进制编码和简化后的LIF2HH子网络的实验,使用了正方形、正弦、三角形和锯齿形输入信号。(d) HH神经元和s-LIF2HH子网络的尖峰数和相对触发时间误差。

图 4. 网络结构,与多任务学习(a,c),深度强化学习(a,b,d,e,f)和鲁棒性(a,g,h,i)实验结果。彭晨 | 编译

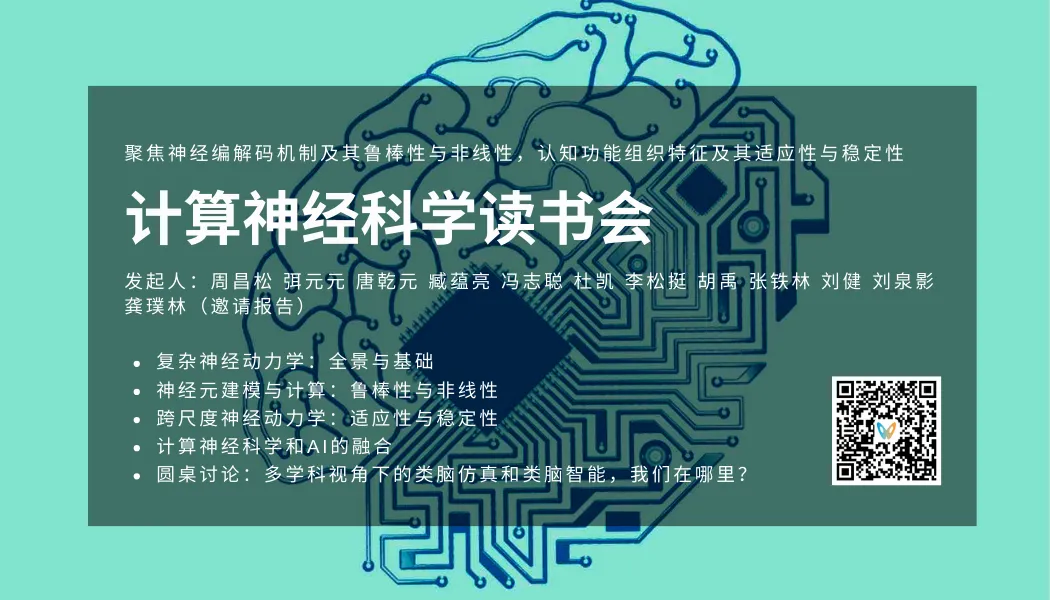

6. 加入集智,一起复杂!