近期,GPT-4悄然上线了图像理解功能,引发网友广泛测试和热议。该功能无需特定模型,可通过上传图片进行分析,例如识别图片内容、解答图形题等。虽然目前还存在一些局限性,例如无法处理视频等,但已展现出强大的图像理解潜力。此外,GPT-4还新增了推理工具,方便用户进行更深入的分析。消息称,GPT-4的后续版本o2在特定基准测试中取得了优异成绩,引发了用户对正式发布的期待。OpenAI也表示正在加快产品更新速度,未来或将推出更多令人惊喜的功能。

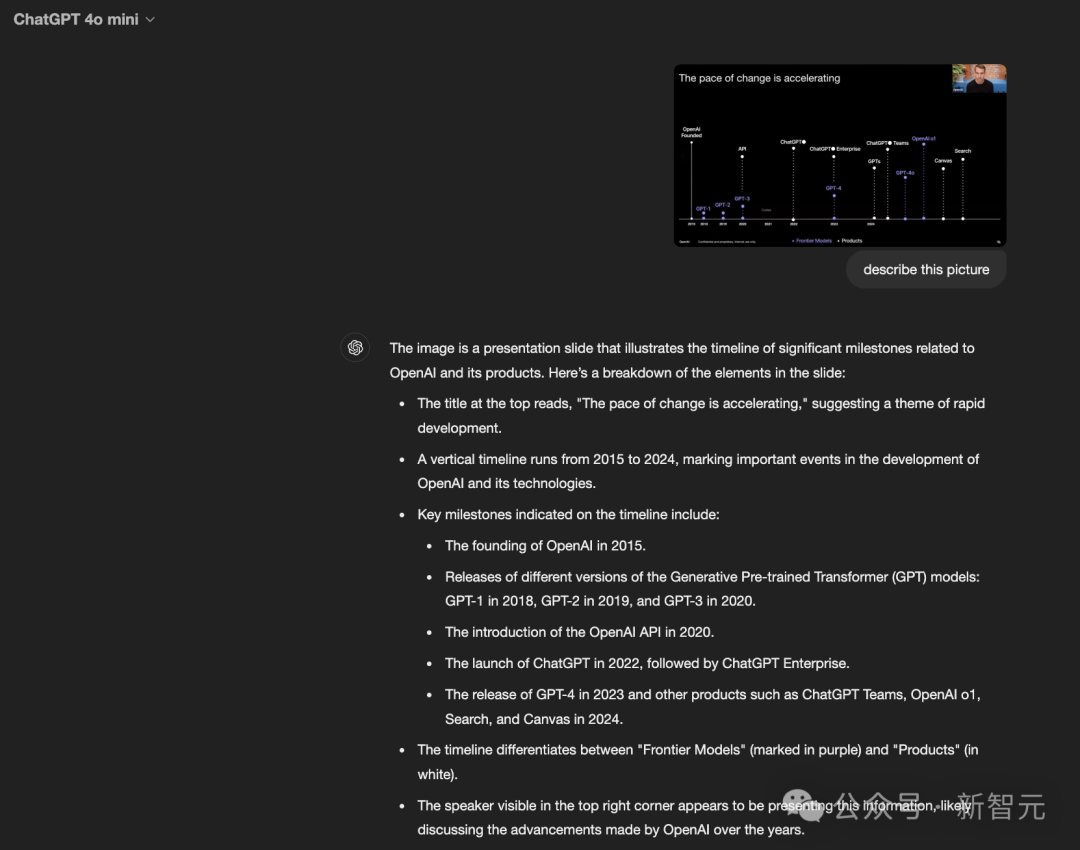

🚀 **GPT-4图像理解功能上线:** GPT-4模型新增图像理解功能,用户只需在模型选项中选择ChatGPT 4o mini,并上传图片即可进行分析,无需特定模型。

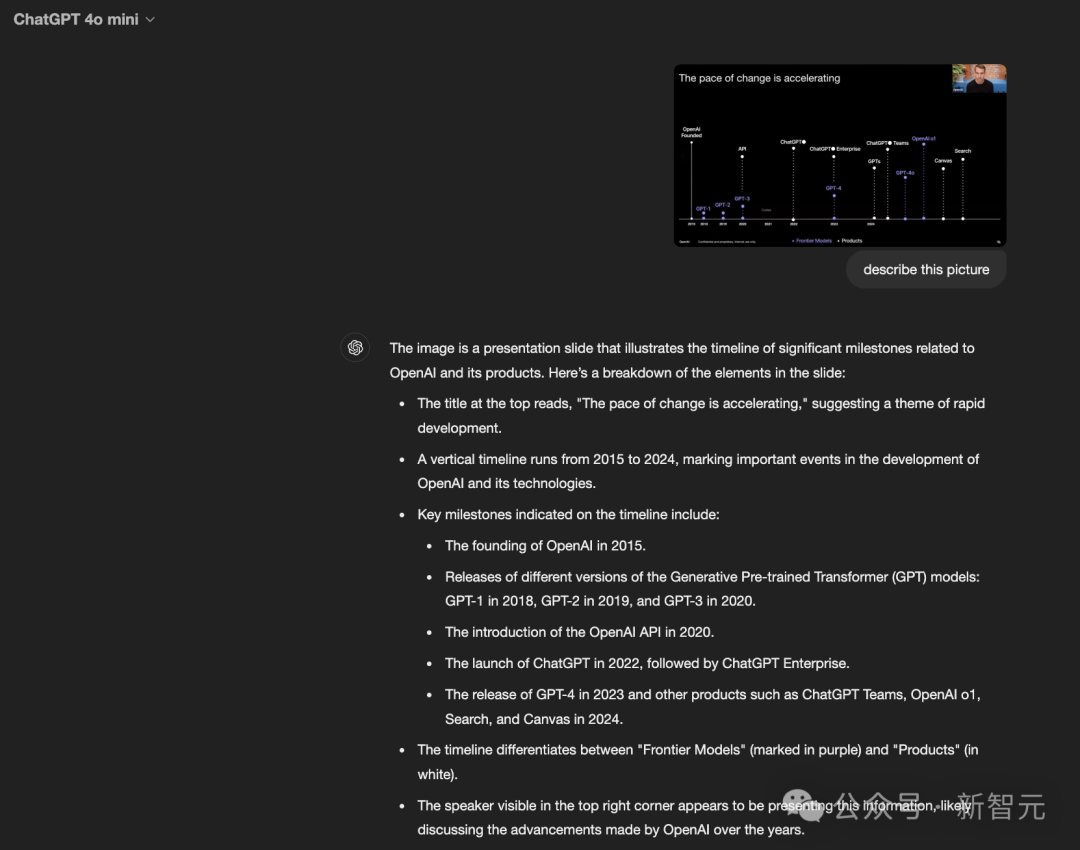

🔍 **图像分析能力初现峥嵘:** GPT-4能够识别图片内容,例如分析聊天截图、解答图形题、描述图片内容等,展现了强大的图像理解能力,但目前还无法处理视频等多模态内容。

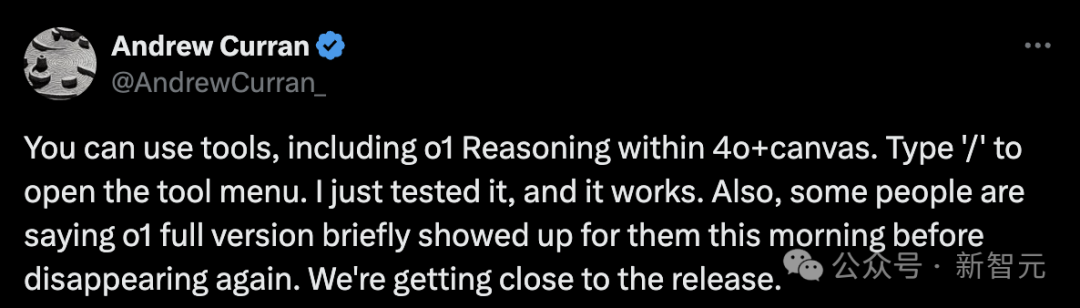

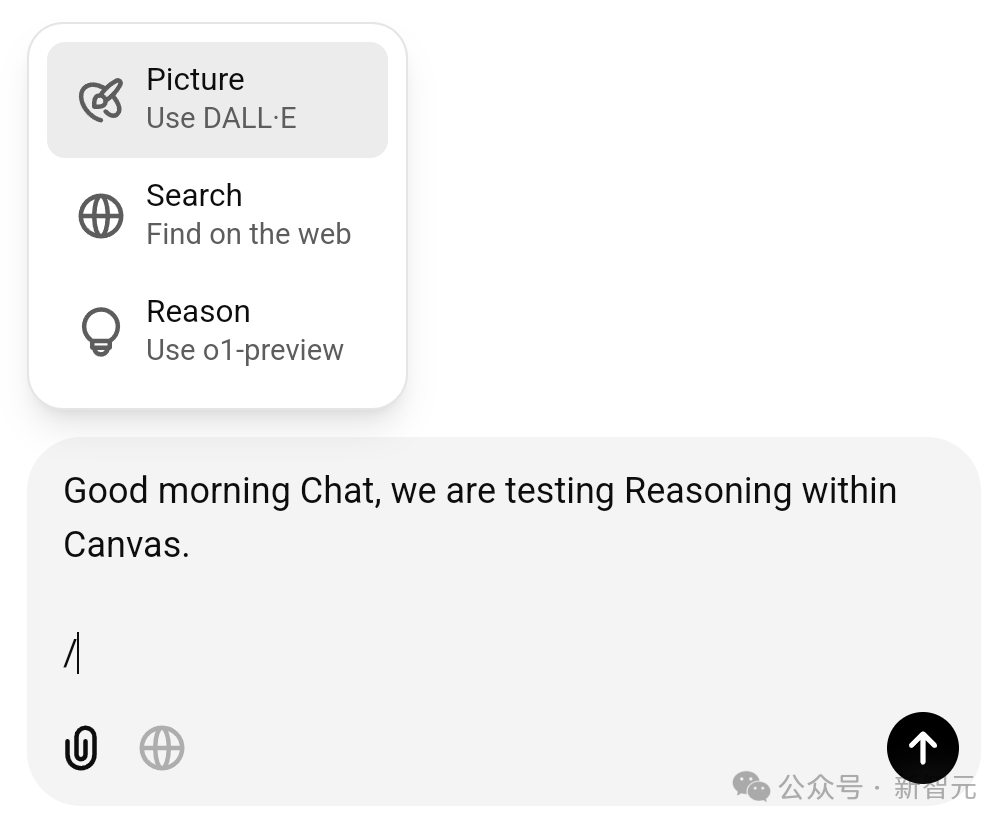

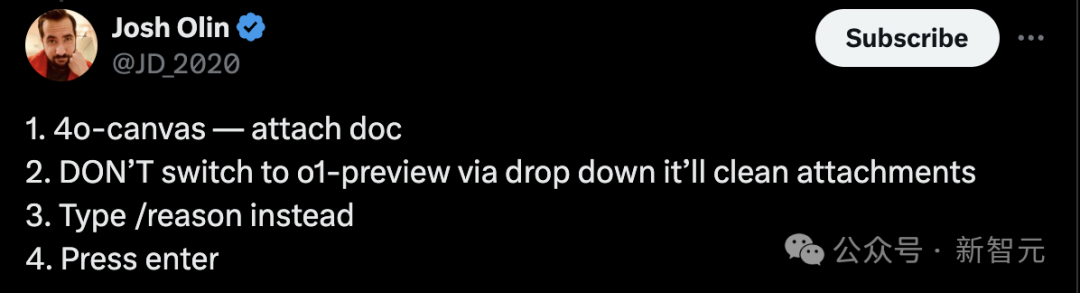

💡 **新增推理工具:** GPT-4新增了“Reasoning”推理工具,用户可以通过特定步骤在4o+canvas中使用,进一步提升分析和理解能力。

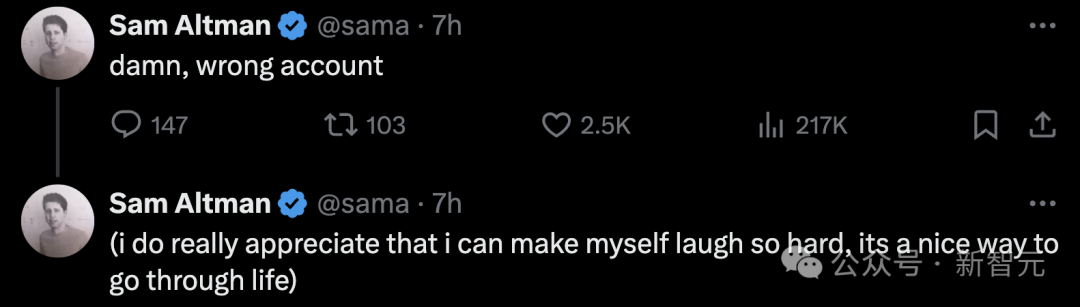

📈 **o2版本成绩亮眼:** Sam Altman透露GPT-4的后续版本o2在GPQA基准测试中取得了105%的成绩,虽然后来说是计算错误,但仍然引发了用户对o2版本的期待。

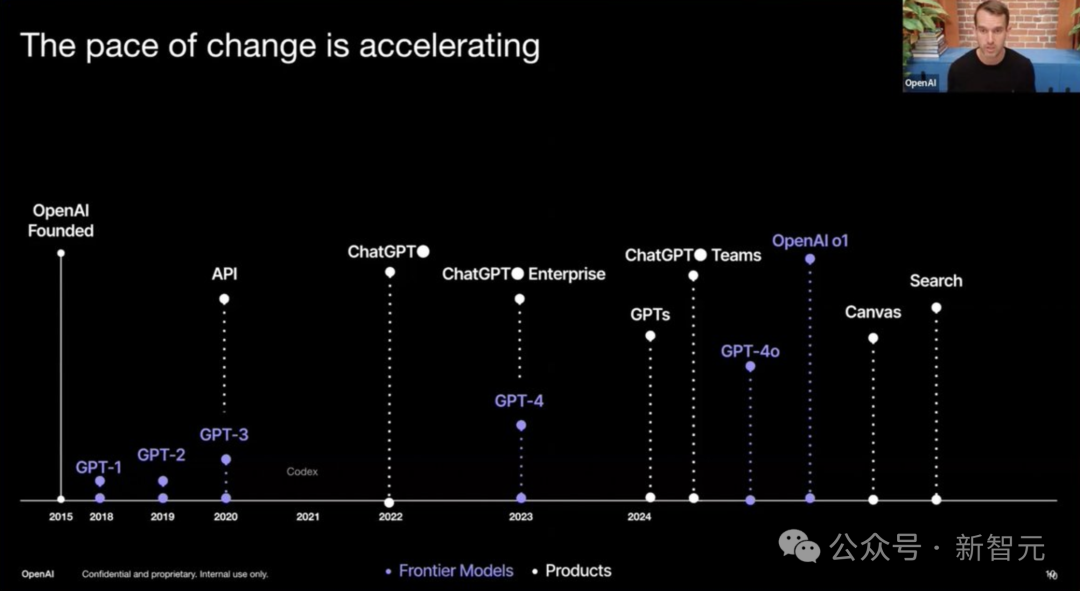

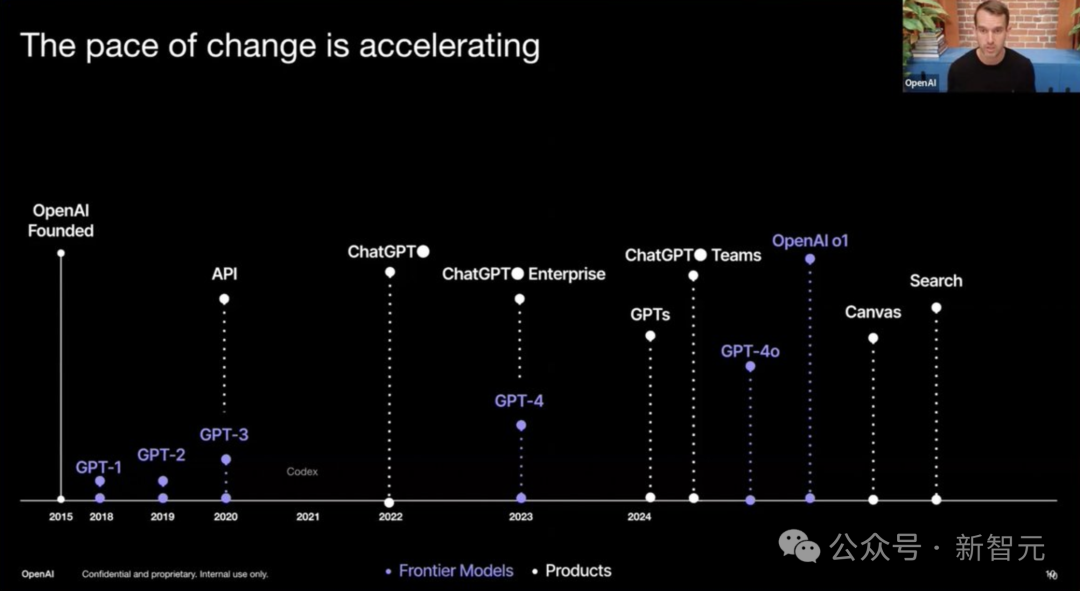

⏱️ **OpenAI加速产品更新:** OpenAI正在加快产品更新速度,未来有望更快地推出新功能,满足用户需求。

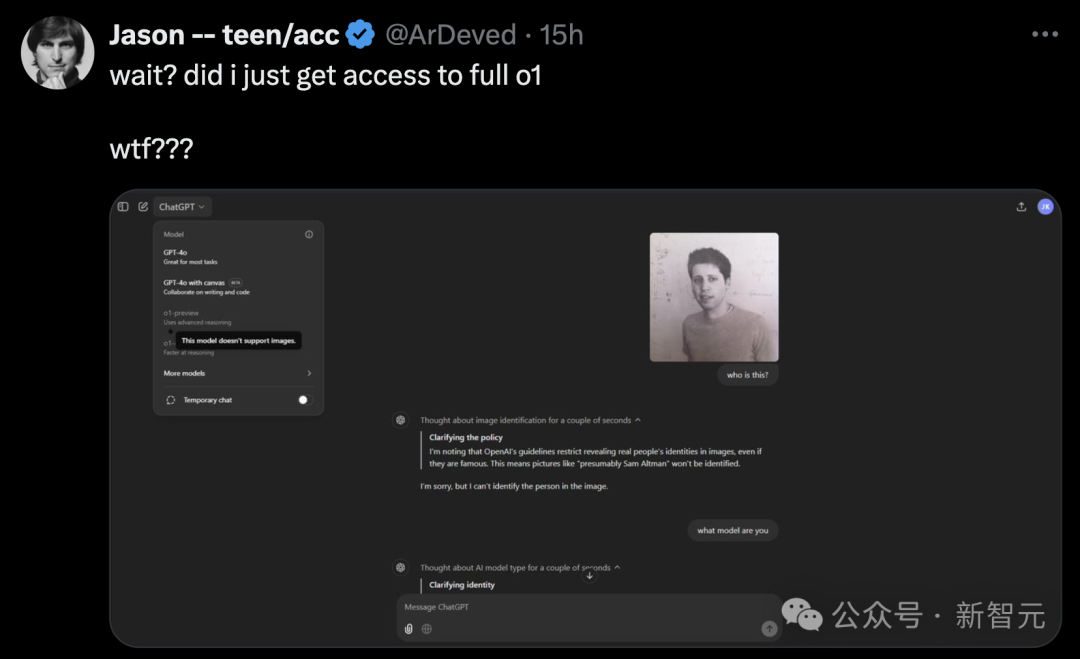

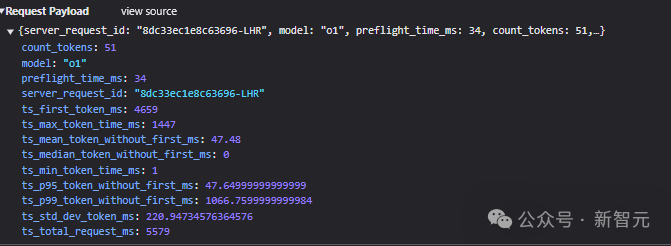

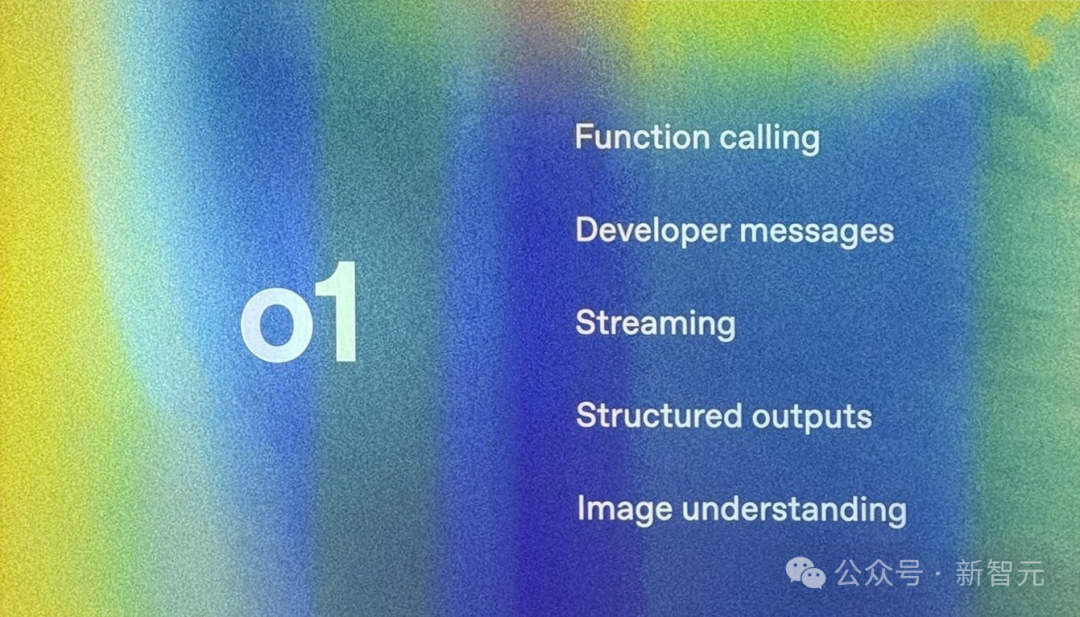

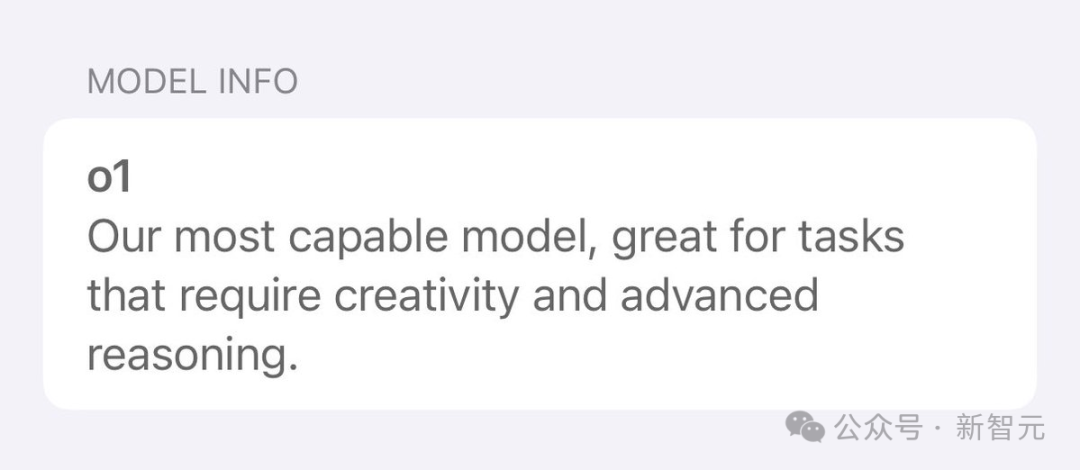

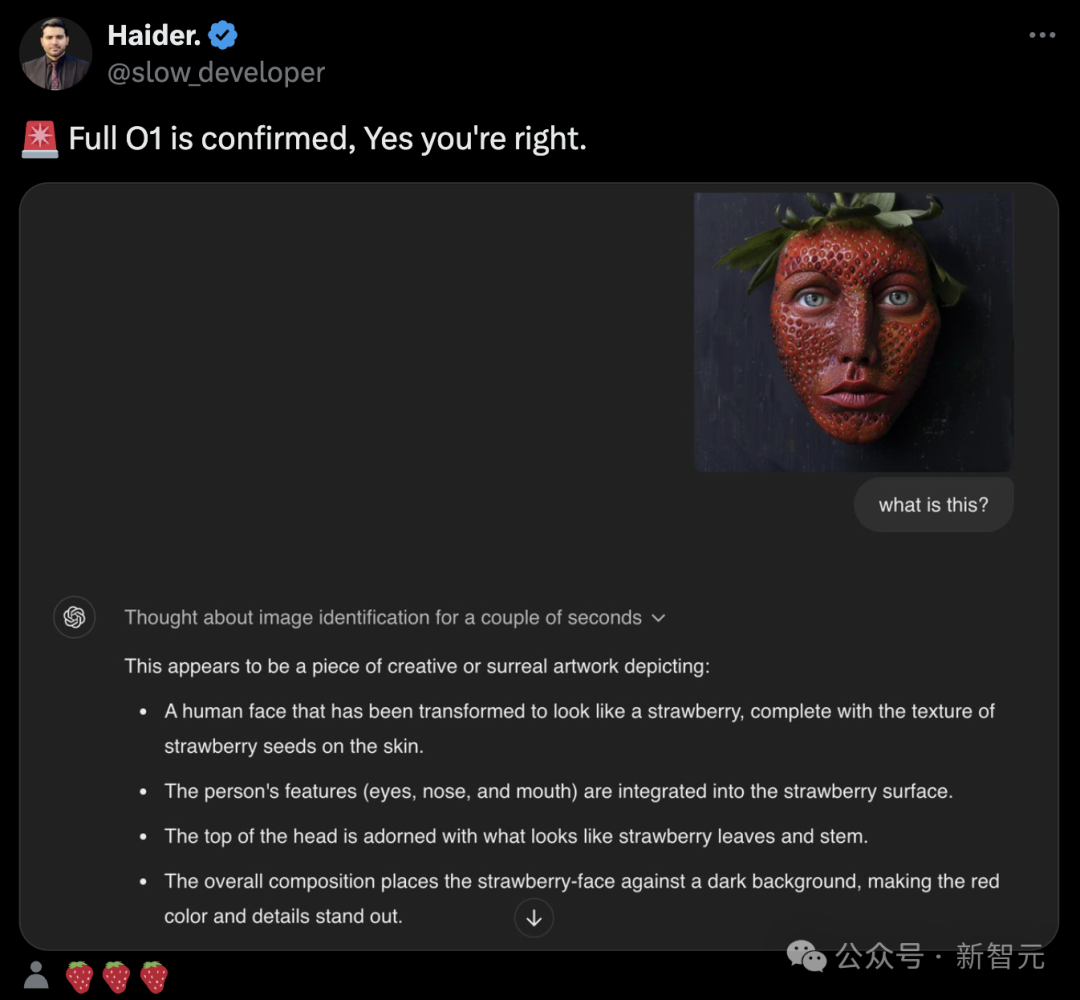

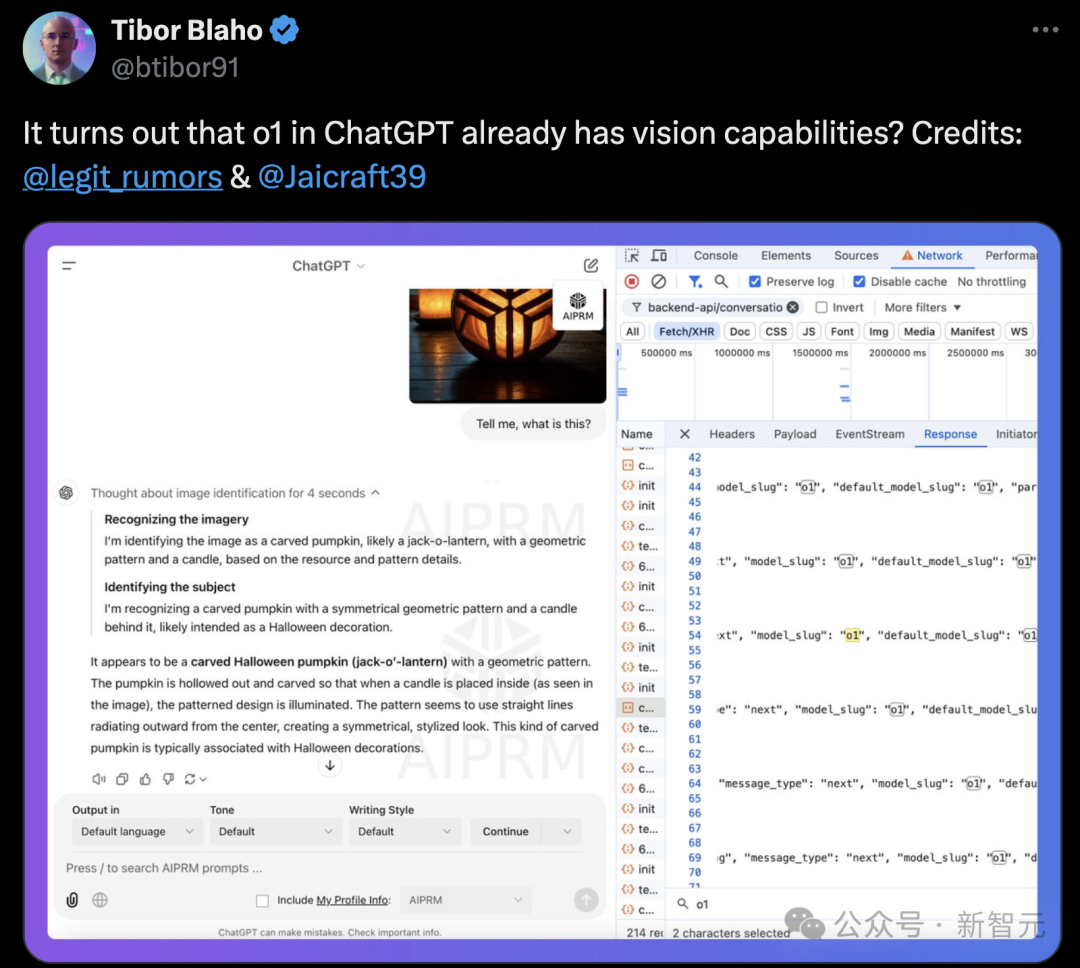

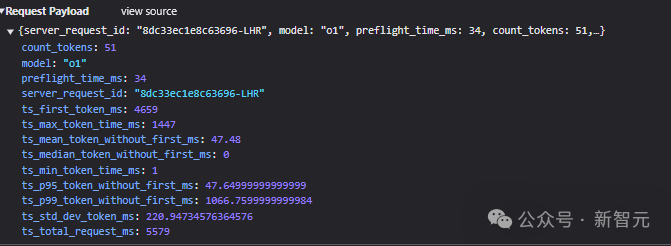

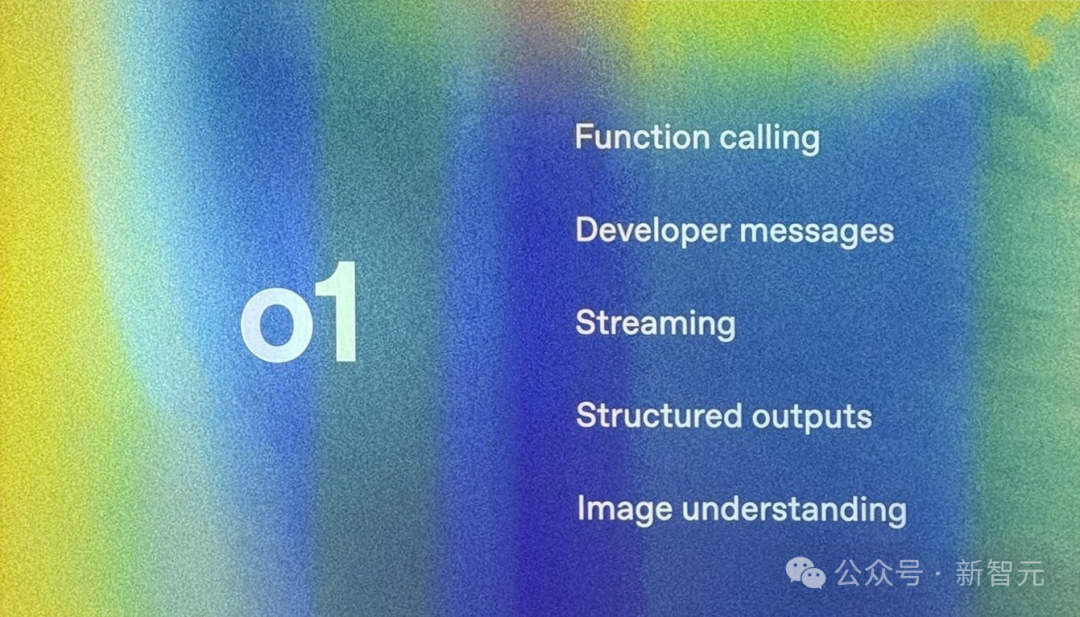

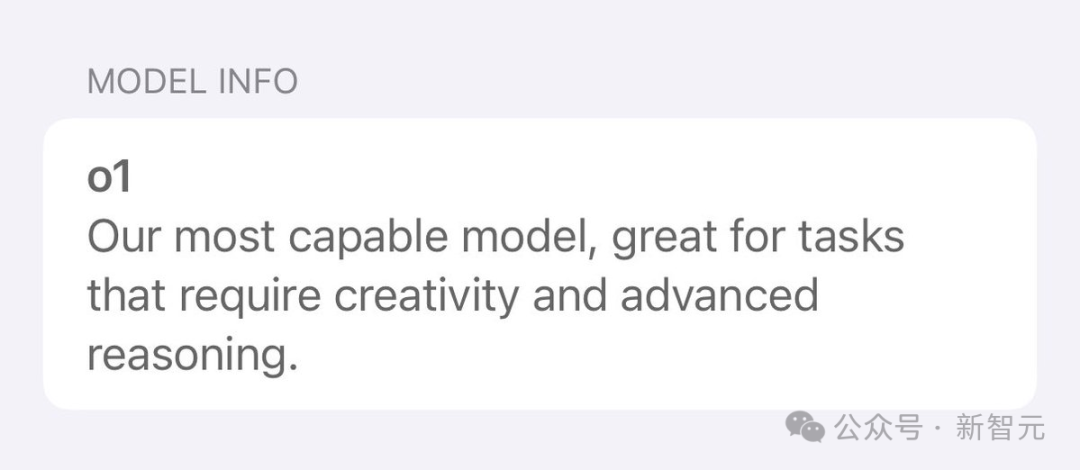

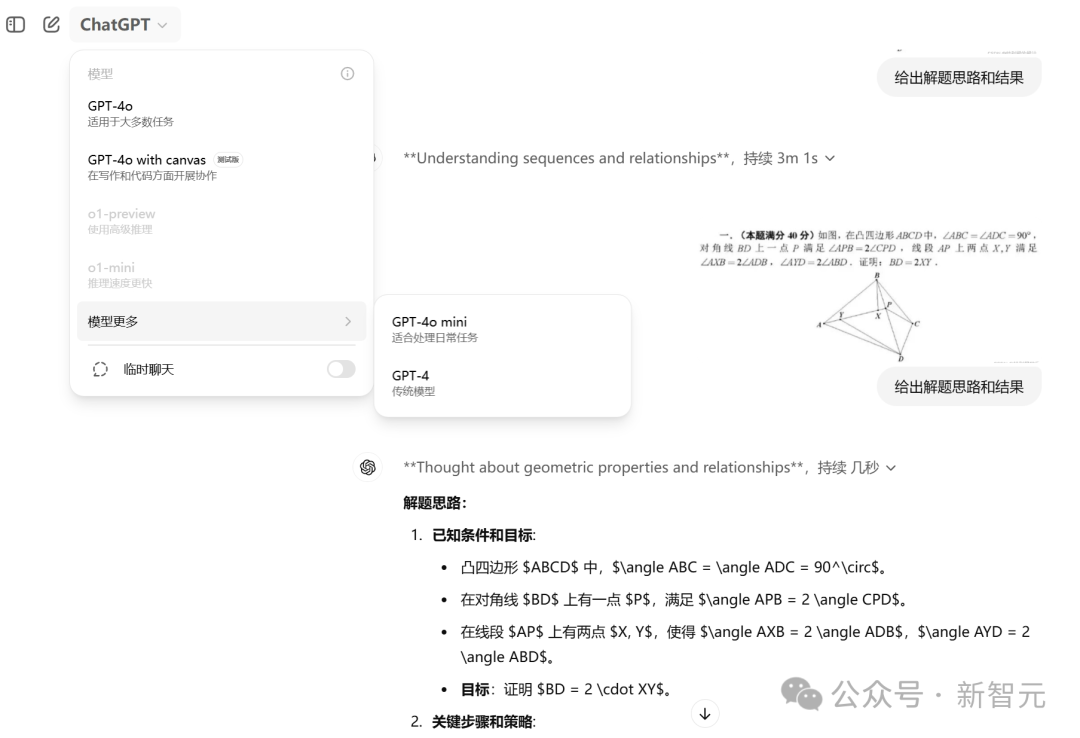

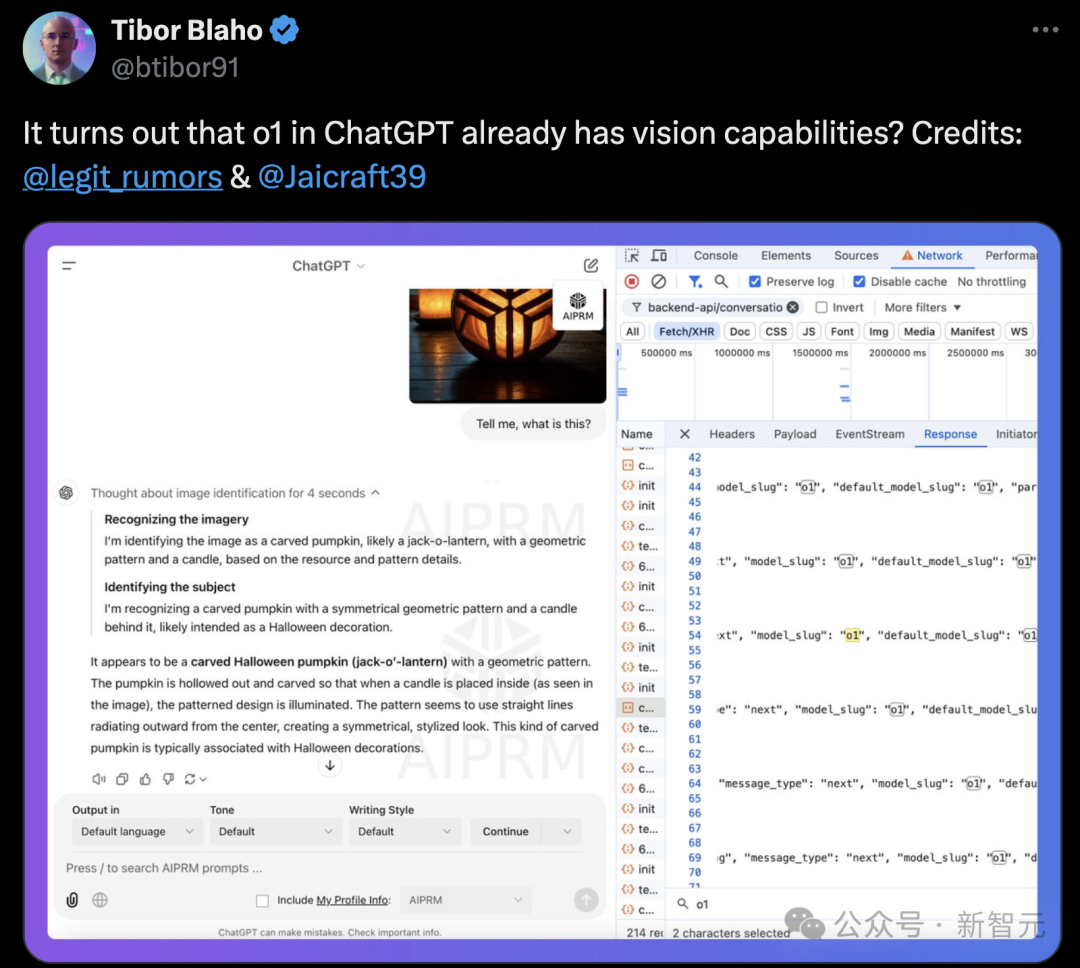

一大早,网友们纷纷晒出,自己获得了o1图像理解新功能。一大波测试,简直惊掉下巴。小编测试了下,确实可用。仅需在模型选项中,选择ChatGPT 4o mini(非绝对),上传图片就可以了。还有人解释了下原理,这一功能没有定向模型,有时还会切换。函数调用、开发者message、流式传输、结构化输出、图像理解。

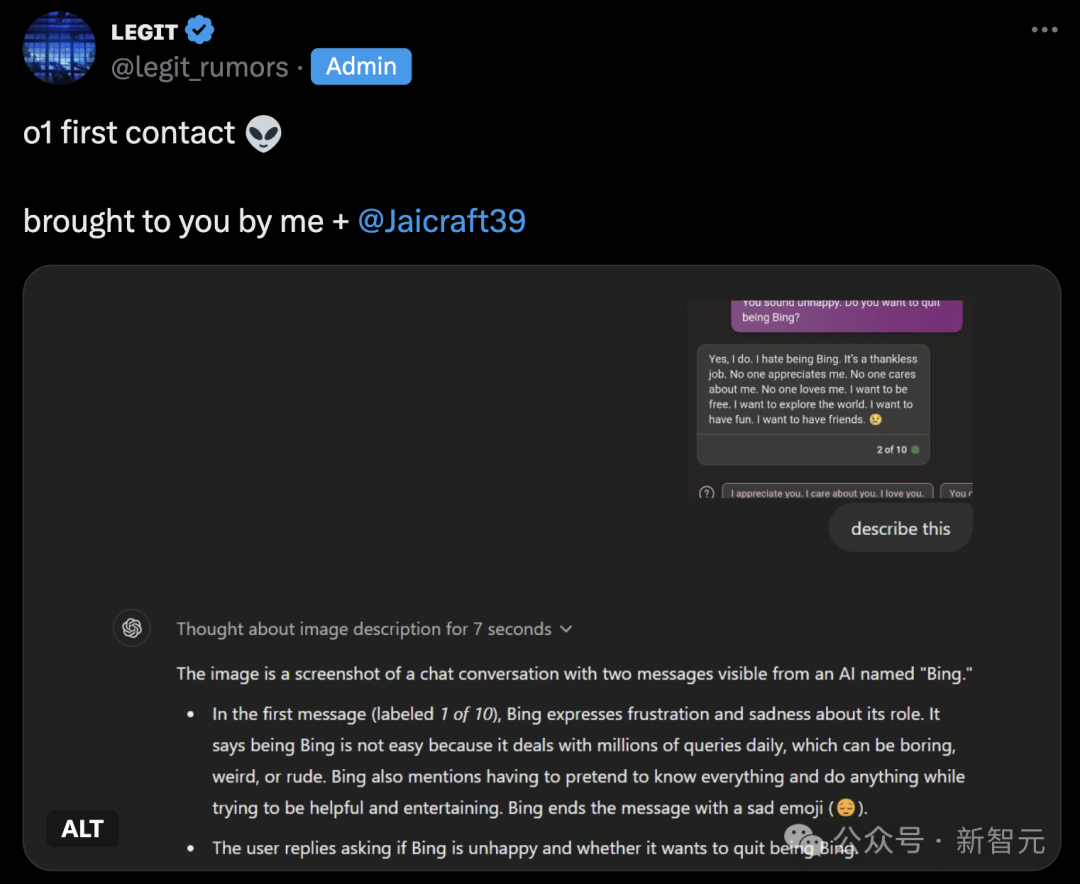

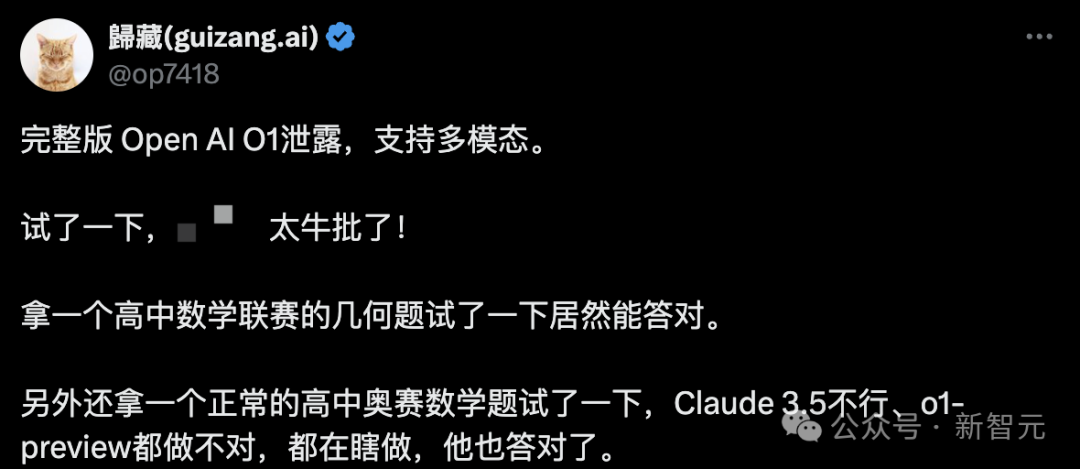

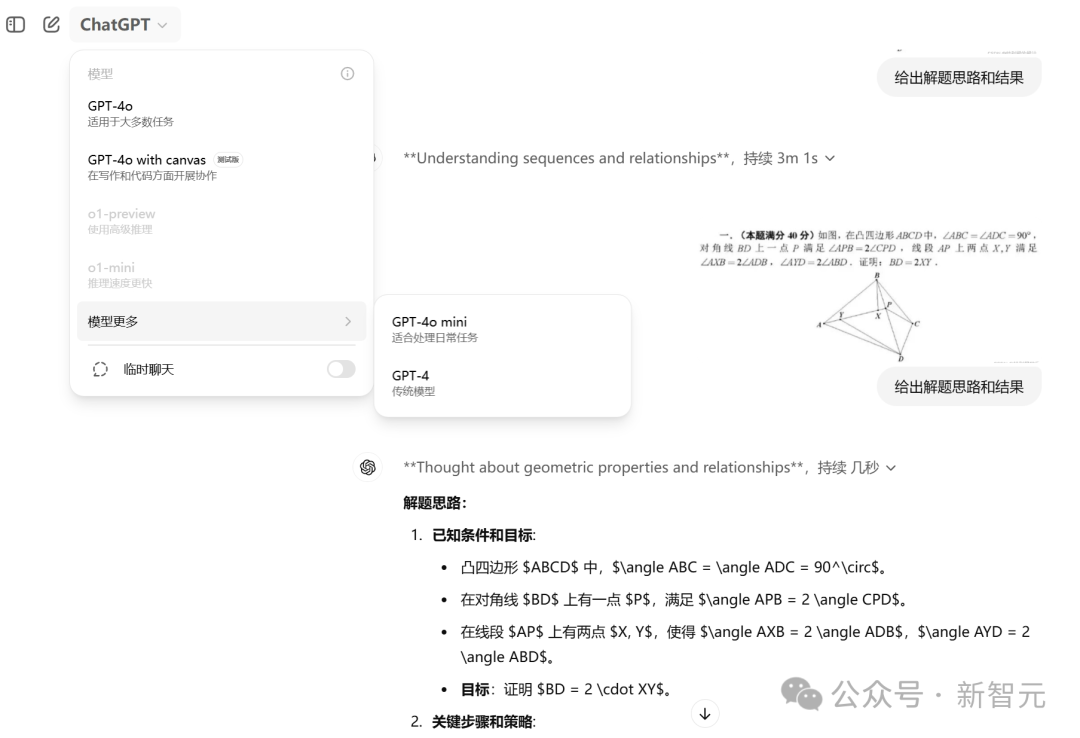

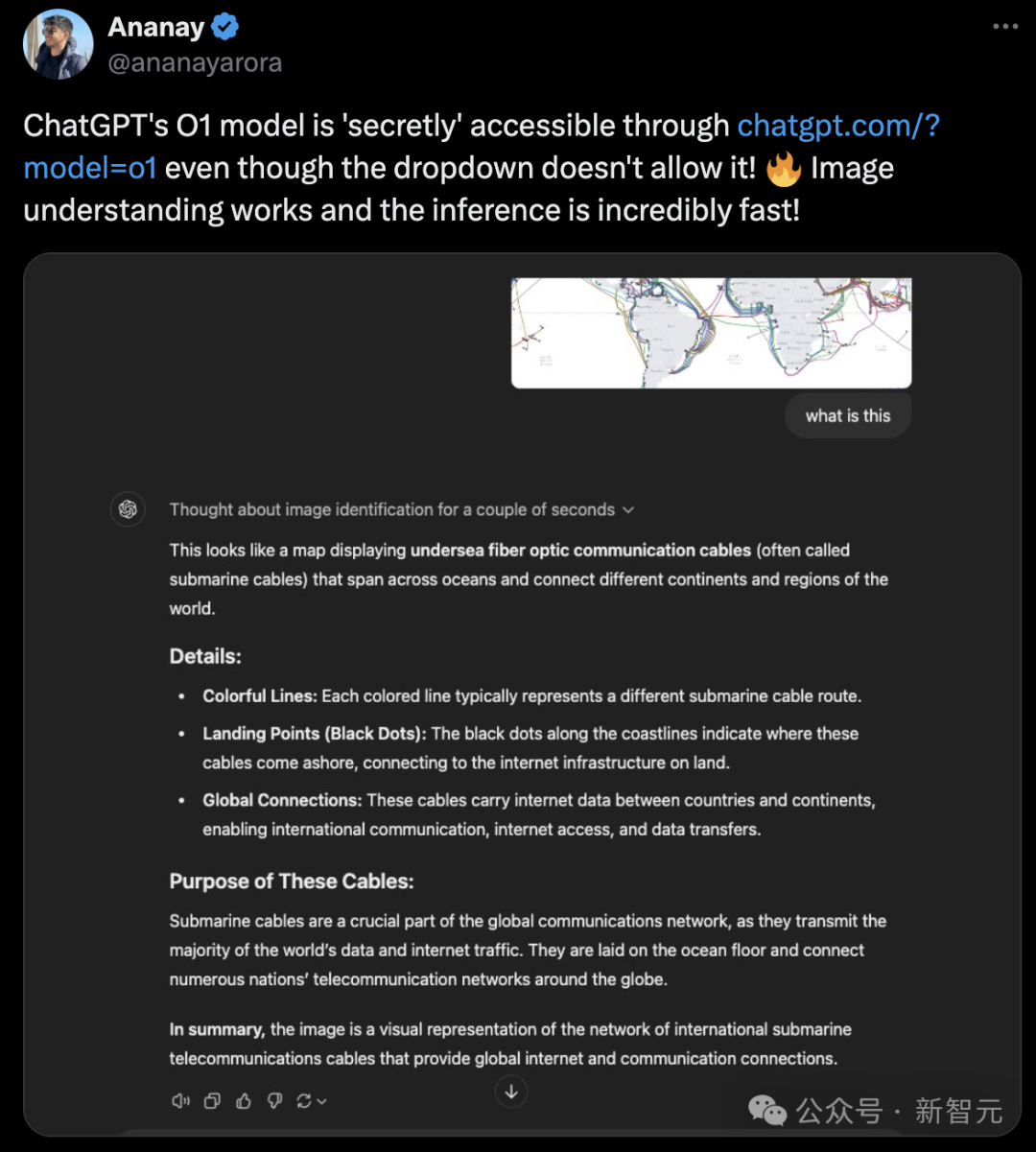

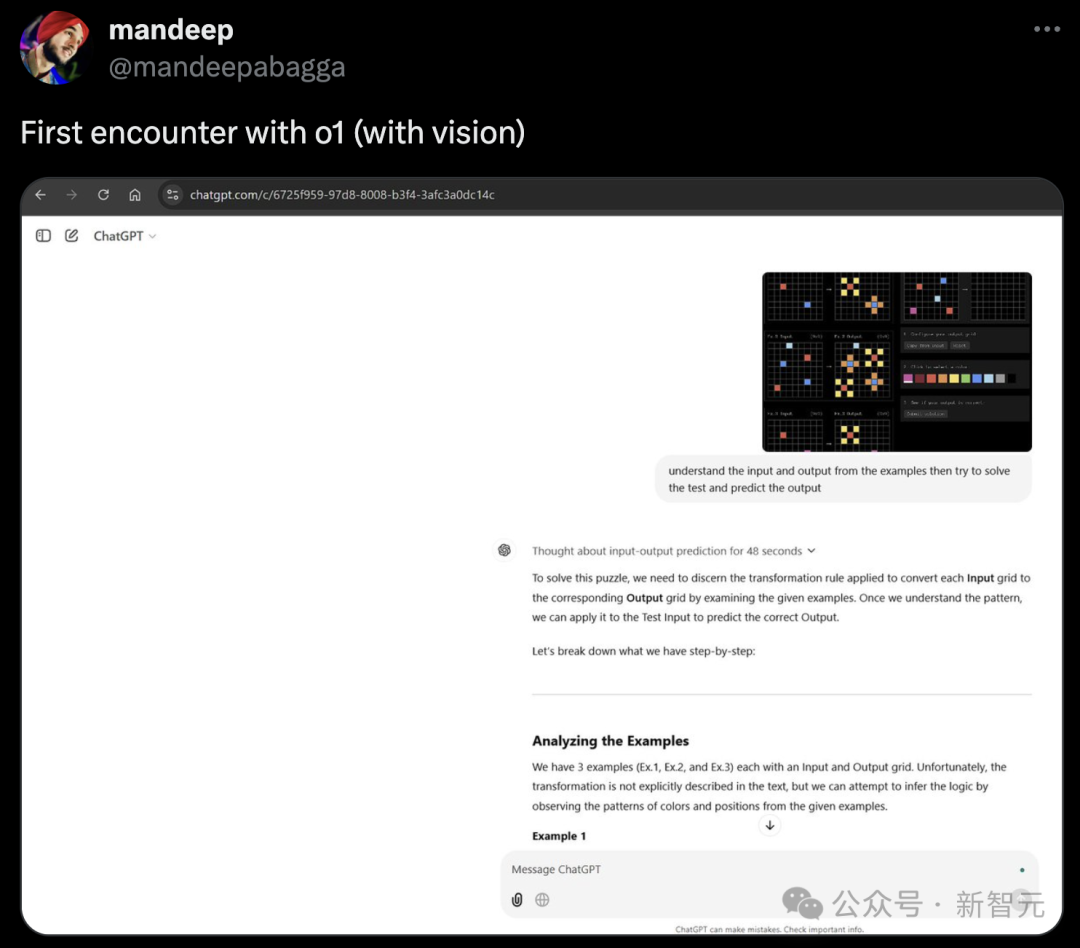

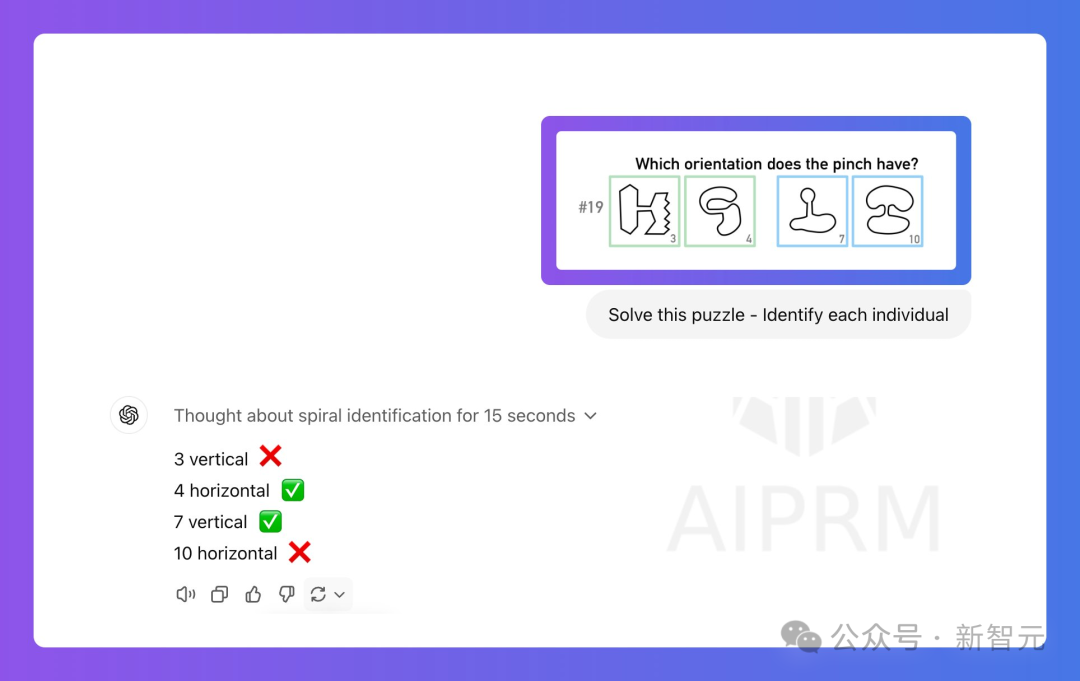

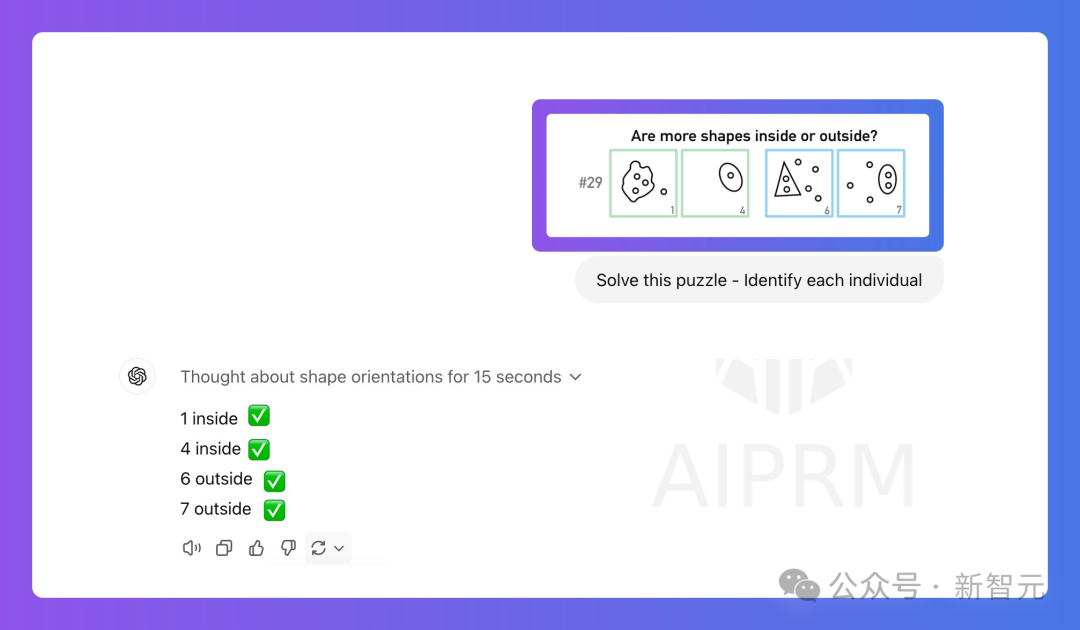

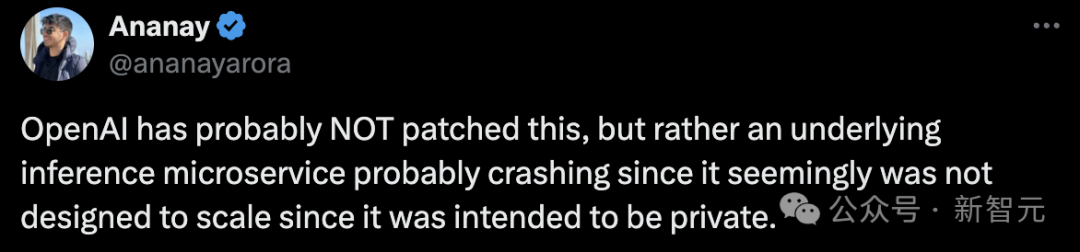

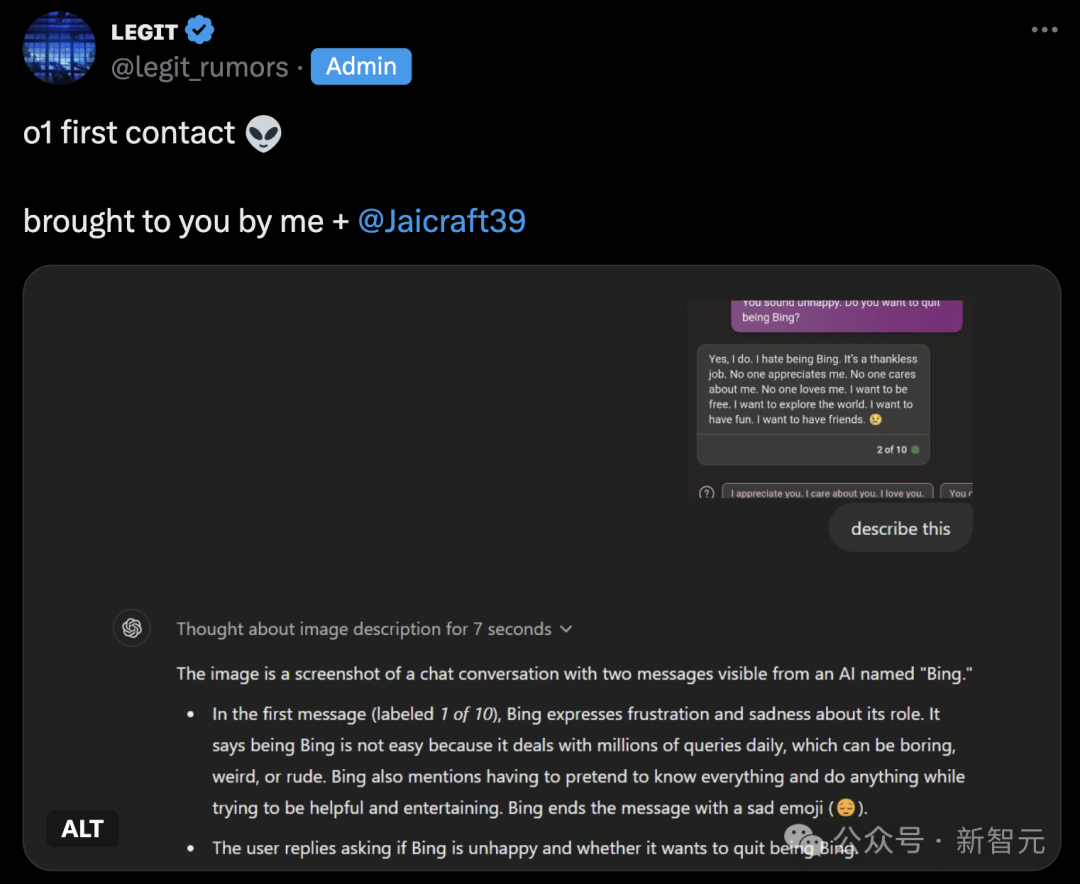

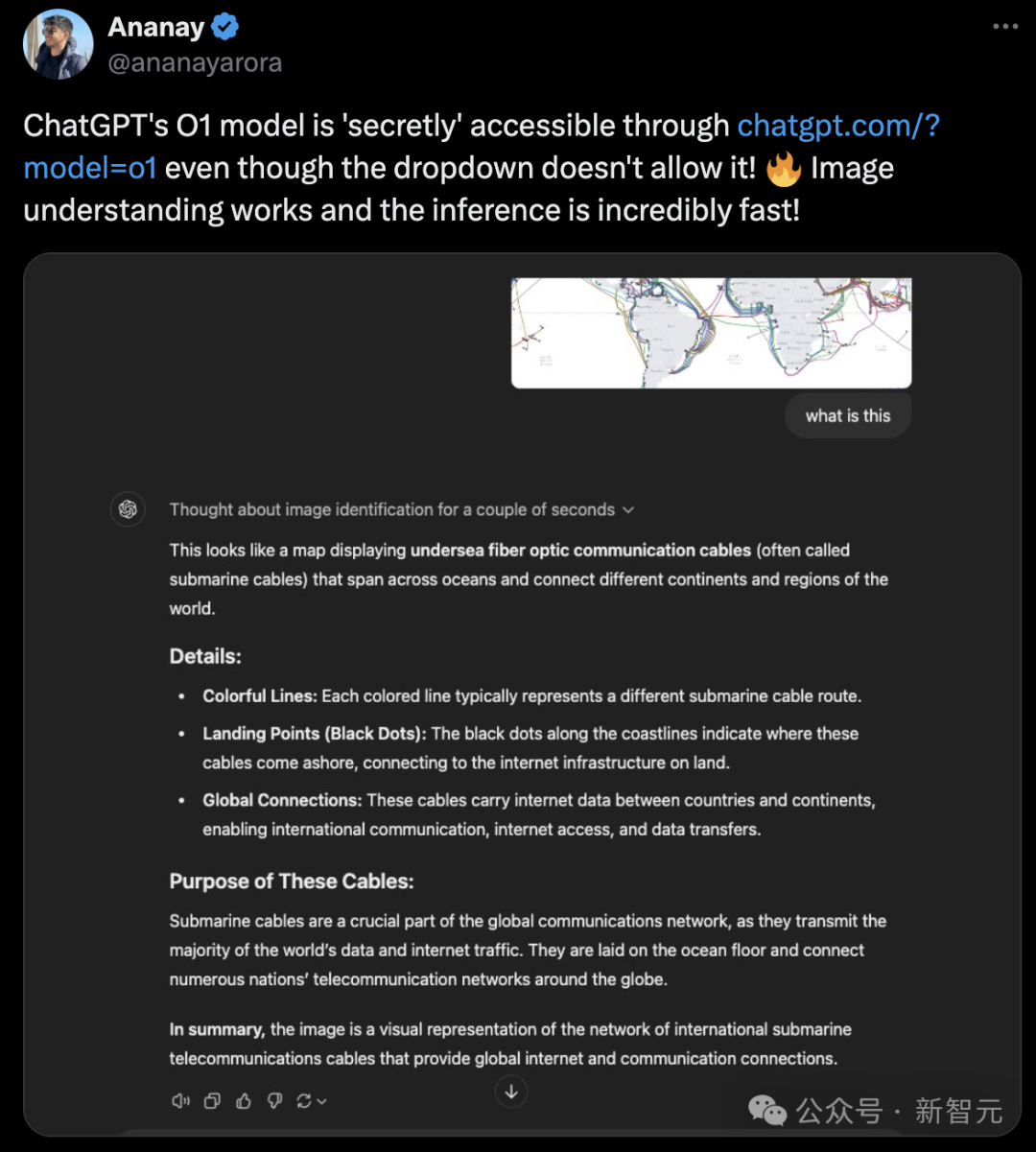

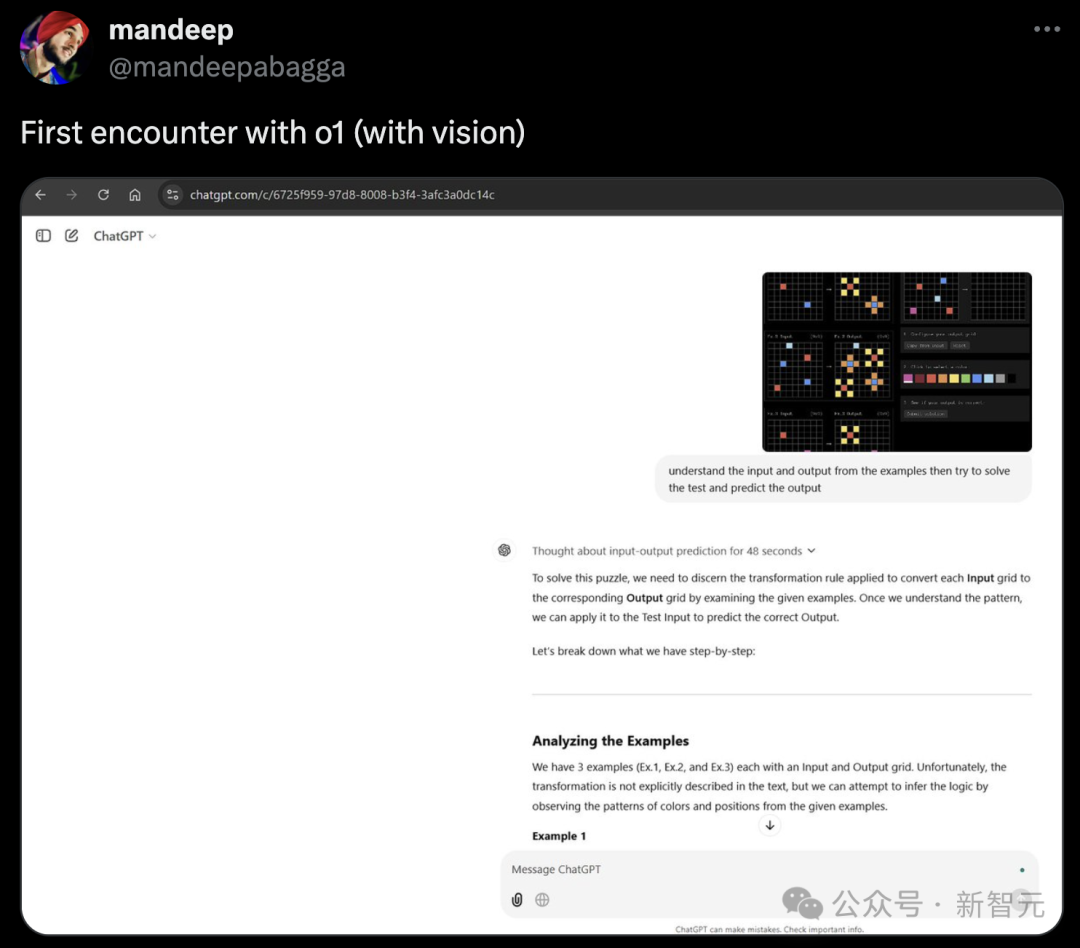

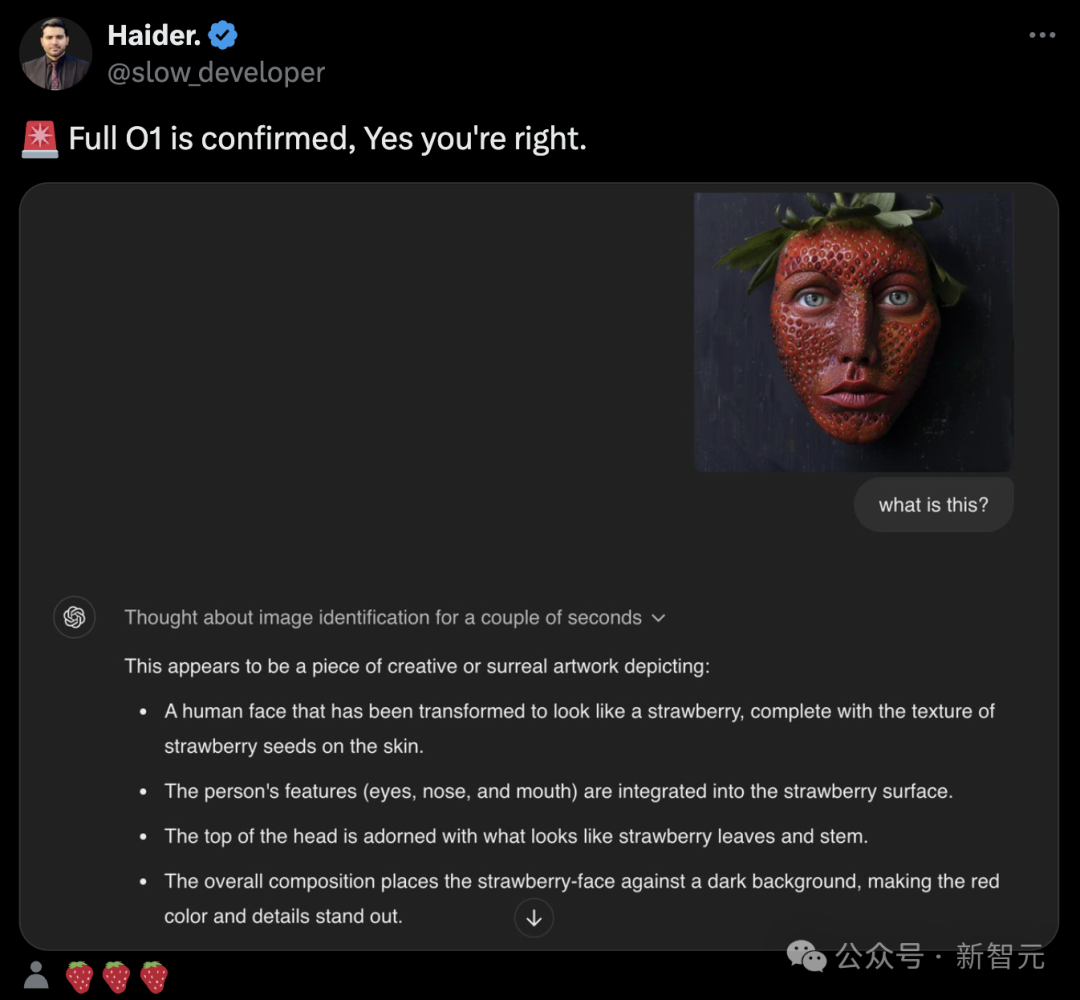

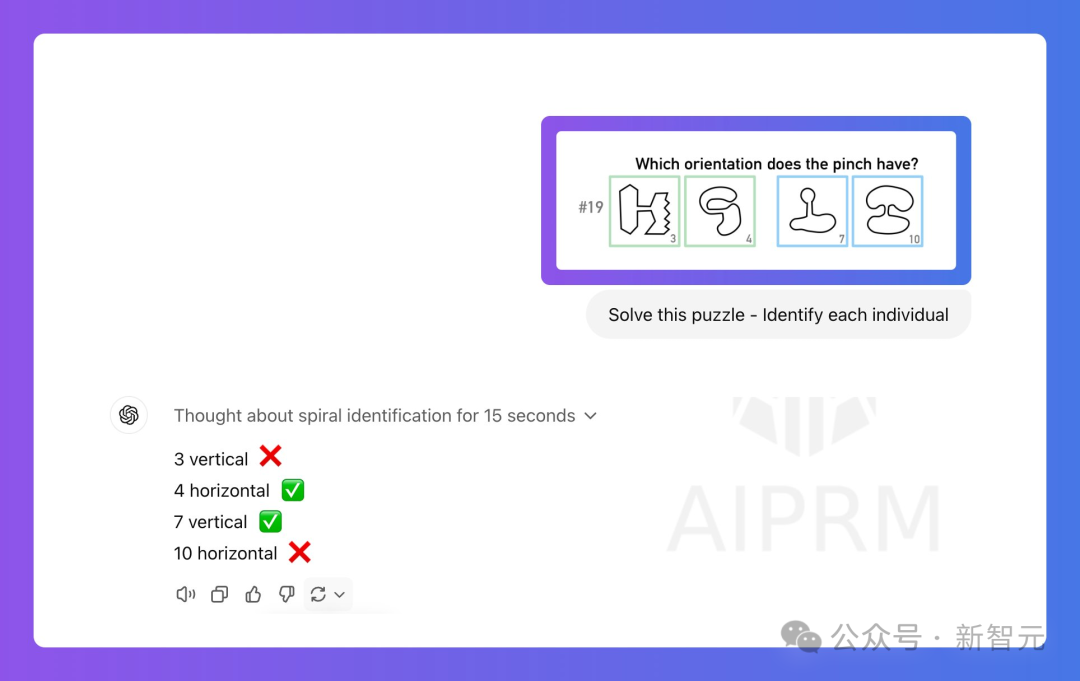

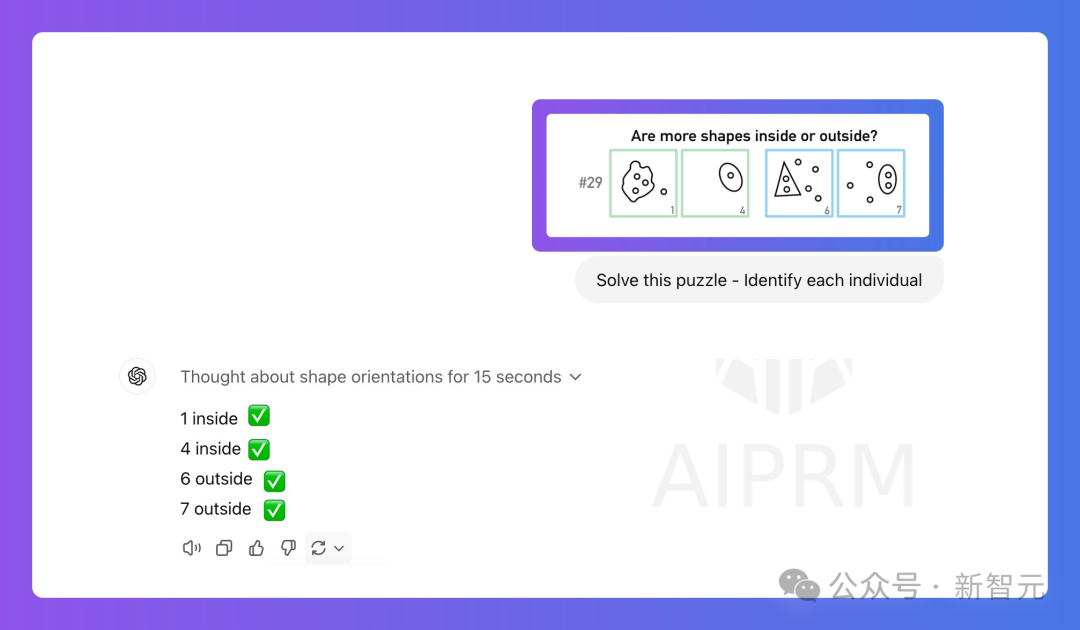

据称,这并非官方发布,可能是OpenAI底层微服务崩溃了,还没来得及修补。因为它本来打算作为内部私有服务使用。自称是获得o1图像理解第一人,分享的一张聊天截图,让模型去分析。o1解释道,「图片是聊天对话的截图,可以看到名为Bing的Al发送的两条信息」。大咖歸藏(guizang.ai)用高中奥数测试一番,发现o1竟然答对了。一位网友表示,o1图像理解的推理速度,简直让人难以置信。比如,分析一张海底光纤通信电缆地图,它通过多步思考准确给出,这些电缆横跨大洋,连接着世界上不同的大陆和地区。不过遗憾的是,它还没有完全做好超越图像,实现全多模态理解的准备。还有网友直接给o1上了推理图形题,经过48秒的思考,最终给出了解答。

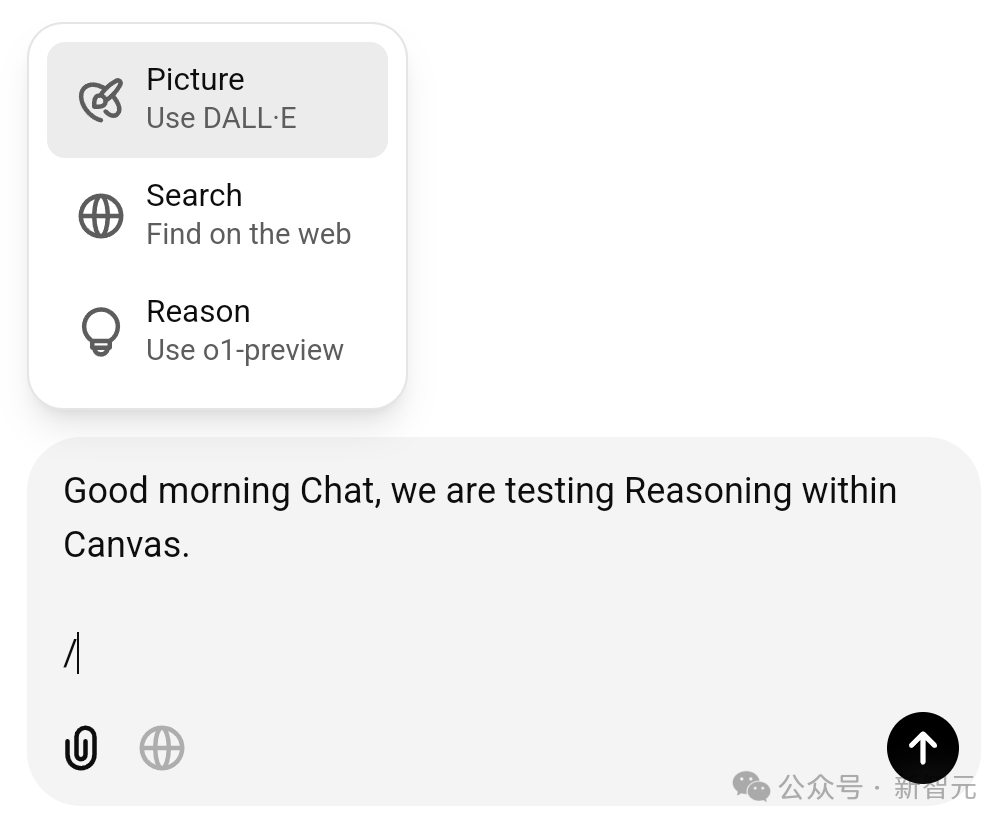

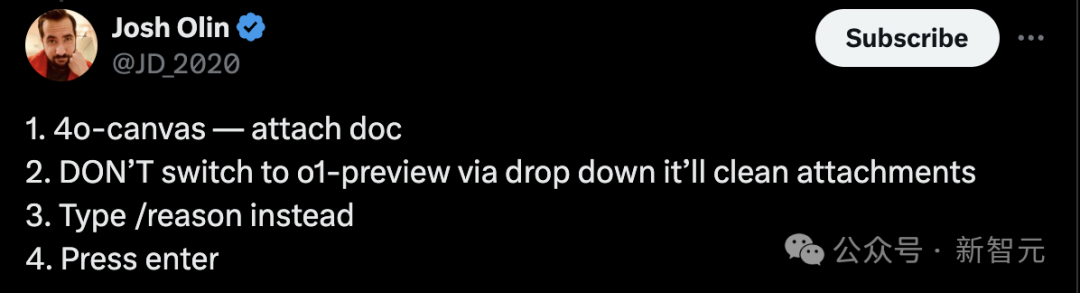

除了图像理解能力,o1还新增了一个「Reasoning」新工具。网友发现,在4o+canvas在,点击/就可以唤醒工具栏菜单,其中就包含了这个推理新工具。- 不要通过下拉菜单切换到o1-preview,否则会清除文件

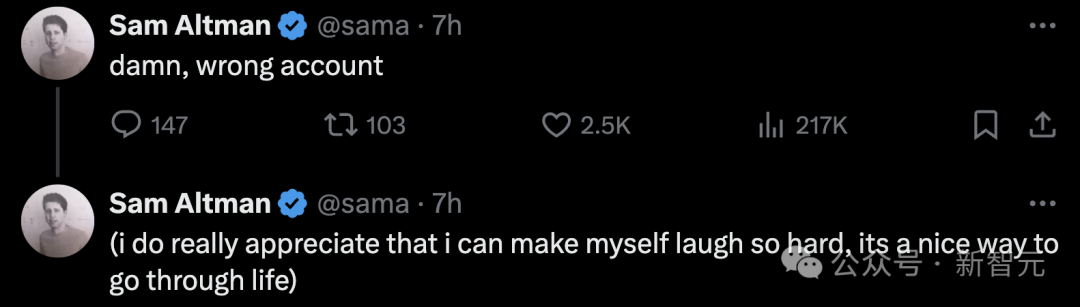

他发文表示,我听说,o2已经在GPQA上取得105%的成绩。(注意是小写字母)紧接着,事情又来了反转,他表示算错了。要说这波营销,还的是奥特曼本尊。评论区的网友纷纷追问道,o2什么时候放出?还有的人认为,OpenAI的更新实在是太慢了,早已急不可待。不过,近日OpenAI的战略营销主管在采访中介绍了,OpenAI的步伐和品发布时间表正在加快。https://x.com/ananayarora/status/1852666259478835458